”集成学习“ 的搜索结果

本文提出了一种基于集成学习的最小二乘算法 LSSVM-Adaboost,用于瓦斯数据回归预测。该算法将 LSSVM 回归器与 Adaboost 集成学习算法相结合,通过迭代训练多个 LSSVM 回归器,并根据每个回预测结果的误差进行加权,...

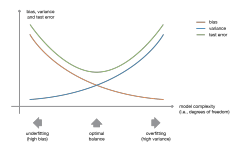

集成学习模型是将多种同质或者异质的模型集成组合在一起,来形成更优的模型。而在这个过程的目标就是,减少机器学习模型的方差和偏差,找到机器学习模型在欠拟合和过拟合之间的最佳平衡点降低偏差我们可以用 ...

目录 1.线性加权融合方法 2.交叉融合法 3.瀑布融合法 4.多而不同之融合 5.预测融合法 ...本文包括常见的模型融合方法、代码链接、进阶的思路。...从算法的角度来看,则最常用的是采用加权型的混合推荐技术,即将来自...

集成学习算法 Ensemble learning algorithm 目的:让机器学习的效果更好,单个的分类器如果表现的好,那么能不能通过使用多个分类器使得分类效果更好呢?或者如果单个分类器分类效果不如人意,那么是否能够通过使用...

通过将多个模型的预测结果进行加权平均或投票,集成学习能够减少单个模型的偏差和方差,从而提高整体的泛化能力。集成学习在解决分类、回归和聚类问题等各个领域都有广泛的应用。2. 减少模型的偏差和方差:通过集成...

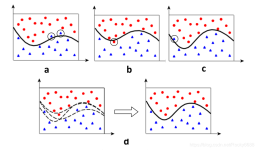

Bagging(Bootstrap Aggregating)是一种集成学习方法,旨在通过训练多个相互独立的分类器,并将它们的预测结果进行组合来改善分类的准确性。Boosting算法的工作方式是按顺序训练一系列的弱分类器,每个弱分类器都...

集成学习就是组合这里的多个弱监督模型以期得到一个更好更全面的强监督模型,集成学习潜在的思想是即便某一个弱分类器得到了错误的预测,其他的弱分类器也可以将错误纠正回来。 Baggging 和Boosting都是模型融合的...

组合不同模型的集成学习MajorityVoteClassifier和AdaBoostClassifier

在机器学习中,集成学习是一种通过结合多个学习器(即个体学习器)来构建更强大模型的技术。个体学习器是指基本的、弱的学习算法,而集成学习通过组合这些个体学习器的预测结果,从而获得更准确、更稳定的预测结果。...

返回集成学习目录 上一章:机器篇——决策树(六)细说 评估指标的交叉验证 下一章:机器篇——集成学习(二)细说随机森林(Rondoom Forest)算法 目录内容 机器篇——集成学习(一)细说 Bagging 算法 机器篇——...

解决样本不均衡问题的第三种策略

集成学习是一种机器学习方法,它通过构建并组合多个学习器来完成学习任务,旨在提高预测的准确性。集成学习背后的基本思想是多个模型的组合通常会比单个模型表现得更好。这些模型可以是同种类型的,也可以是不同类型...

什么是集成学习?它的出现是为了解决什么问题?集成学习的定义、集成学习中的三种集成策略、集成学习的两大分类。

集成学习集成学习思想集成学习方法 集成学习思想 集成学习方法

前段时间参加了一家量化投资公司的面试,其中用了集成学习算法,发现效果很好,现在将代码公布出来,以便小白学习,大神请绕道!!! 原问题:请结合附件Excel表中的数据完成下列问题: 模型 1)以投资金额为目标...

机器学习_机器学习算法实现之集成学习.zip

机器学习算法初识——集成学习算法(Ensemble Methods)

集成学习的目标是结合一组基学习器的预测构建学习算法来提高单个学习器的普遍性和健壮性。通常有两种方法: averaging:构建一组相互独立的学习器求预测的均值。由于方差的减小,组合学习器的性能比任何单个学习器都...

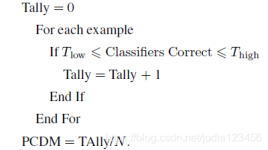

集成学习多样性度量总结

标签: 集成学习多样性度量

强化学习是智能体(Agent)以“试错”的方式进行学习,通过与环境进行交互获得的奖赏指导行为,目标是使智能体获得最大的奖赏,强化学习不同于连接主义学习中的监督学习,主要表现在强化信号上,强化学习中由环境...

原文链接:http://www.wangxianfeng.name/2011/08/ensemble-method-to-improve-the-accuracy-of-the-classifier/ ...传统的分类方法是在一个由各种可能的函数构成的空间中寻找一个最接近实际分类函数的分类器...

为什么要进行集成学习 集成学习的思想是将若干个学习器(分类器、回归器)组合之后产生一个新的学习器。 弱分类器(weak learner):指那些分类准确率值只稍好于随机猜测的分类器(error<0.5); 集成算法的成功在于...

集成学习 一、集成学习算法简介 1.什么是集成学习 2.复习:机器学习的两个核心任务 3.集成学习中boosting和Bagging 4.小结 二、Bagging和随机森林 1.Bagging集成原理 2.随机森林构造过程 三、包外估计 ...

一、集成学习简介 集成学习的思想就是将多个弱学习器组合成一个强学习器。集成学习的优点在于保证了弱分类器的多样性,使得其得到的结果往往比单个学习器的效果好(可以理解为真理往往掌握在大多数人手中)。 常见...

推荐文章

- SMT的基本知识介绍_smt行业基础知识-程序员宅基地

- 43.基于SSM的口腔护理网站|基于SSM框架+ Mysql+Java设计与实现(可运行源码+数据库+lw)-程序员宅基地

- HTML中Table表格的使用与漂亮的表格模板_html table 样式-程序员宅基地

- Linkage Mapper中的局部和全局地图比较实践指南(含实例分析)-程序员宅基地

- 线性筛求欧拉函数-程序员宅基地

- 初中几何题_初中几何题解-程序员宅基地

- jQuery 放大镜效果_jquery放大效果-程序员宅基地

- Python构建快速高效的中文文字识别OCR_中文ocr python-程序员宅基地

- SQL语句用case when实现if-else条件逻辑_case when里面可以加if else吗-程序员宅基地

- 数据结构实验课程设计报告求工程的最短完成时间_(1)用字符文件提供数据建立aoe网络邻接表存储结构; (2)编写程序,实现图中顶点的-程序员宅基地