集成学习算法 Ensemble learning algorithm 目的:让机器学习的效果更好,单个的分类器如果表现的好,那么能不能通过使用多个分类器使得...通过集成学习提高整体泛化能力的前提条件: 分类器之间是有差异的 每个...

”通过集成学习提高整体泛化能力的前提条件“ 的搜索结果

通过合成实例生成来提高极限学习机的泛化能力

我们通过一个例子来理解集成学习的概念。假设你是一名电影导演,你依据一个非常重要且有趣的话题创作了一部短片。现在,你想在公开发布前获得影片的初步反馈(评级)。有哪些可行的方法呢?A:可以请一位朋友为电影...

1. 偏差与方差 - 机器学习算法泛化性能分析 在一个项目中,我们通过设计和训练得到...”偏差-方差分解(bias-variance decomposition)“是解释学习算法泛化能力性能的一种重要工具。偏差-方差分解试图对学习算法的...

用于训练神经网络的样本点集不可避免地会受到噪声污染。...究K—L 信息距离和神经网络泛化能力的关系, 构造一个新的神经网络学习误差函数。泛化能力分析和 仿真结果表明了该学习误差函数的合理性。</p>

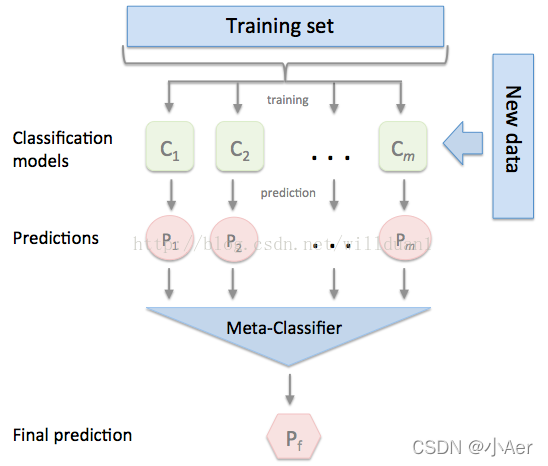

然后开始介绍具体的集成学习算法:串行的Boosting和并行的Bagging,前者通过对错判训练样本重新赋权来重复训练,以提高基学习器准确性,降低偏差;后者通过采样方法,训练出多样性的基学习器,降低方差。之后又讲了...

机器学习4-集成学习

标签: 机器学习

目录1. 个体与集成2. BoostingAdaboost(二分类)Adaboost...集成学习通过构建并结合多个学习器来完成学习任务。一般结构:先产生一组个体学习器,再用某种策略将它们结合起来。 集成学习可以用于分类问题集成,回归

本文的目的便是讲述如何得到泛化能力好的模型。 一、处理数据集 目的:合理的处理数据集,使测试数据得出的结论尽可能的等于实际的值。没有免费的午餐定理对试验评估方法同样适用。 首先,一份数据集大体上是三...

**虽然单个弱学习器的预测能力有限,但可以通过组合多个弱学习器来提高整体预测准确率**训练速度较快:**弱学习器通常具有较简单的结构和较少的参数,因此训练速度较快强学习器(Strong Learner)是指在机器学习中,...

集成学习理论知识 《使用sklearn进行集成学习——理论》 《使用sklearn进行集成学习——实践》 目录 1 前言2 集成学习是什么?3 偏差和方差 3.1 模型的偏差和方差是什么? 3.2 bagging的偏差和方差 3.3 boosting的...

1. 关于集成学习的概念 集成学习是机器学习中一...已经有学者理论上证明了集成学习的思想是可以提高分类器的性能的,比如说统计上的原因,计算上的原因以及表示上的原因。1.1 为什么要集成1)模型选择 假设各弱分类

在机器学习中也有一类算法,将这两种思想融合起来,它就是集成学习,算法将不同的学习器融合在一起。 在集成学习中,算法不要求每个学习器性能最好,但是期望它们对问题具有不同的看法,Good But Different (好...

假设你创建了一个包含1000个分类器的集成,每个分类器都只有51%的概率是正确的(几乎不比随机猜测强多少)。如果你以大多数投票的类别作为预测结果,可以期待的准确率高达75%。但是,这基于的前提是所有的分类器都是...

集成学习需要理解的一些内容

标签: 机器学习

另外,欢迎大家关注我的个人bolg,知乎,更多代码内容欢迎follow我的个人Github,如果有任何算法、代码疑问都欢迎通过邮箱发消息给我。 介绍一下Boosting的思想? 初始化训练一个弱学习器,初始化下的各条样本的...

2 集成学习是什么? 3 偏差和方差 3.1 模型的偏差和方差是什么? 3.2 bagging的偏差和方差 3.3 boosting的偏差和方差 3.4 模型的独立性 3.5 小结 4 Gradient Boosting 4.1 拟合残差 4.2 拟合反向梯度 ...

集成学习(ensemble learning),又被叫做多分类器系统(multi-classifer system,注意停顿,多,分类器,也即多个分类器的意思)或者基于委员会的学习(committee-based learning)。 个体学习器可以是同种类型的学习...

随机森林详解1. 随机森林的简介2. 随机森林算法2.1. Bagging算法2.2. 随机森林算法原理2.3 随机森林的OOB估计2.4 随机森林的特征选取2.4.1. 随机输入变量选取2.4.2. 随机组合输入变量2.4.3 随机特征数的确定2.5. ...

XGBoost全名叫(eXtreme Gradient Boosting)极端梯度提升,经常被用在一些项目中,其效果显著。它是大规模并行boosted tree的工具,它是目前最快最好的开源boosted tree工具包。XGBoost 所应用的算法就是GBDT...

一、关于集成学习的概念 ...已经有学者理论上证明了集成学习的思想是可以提高分类器的性能的,比如说统计上的原因,计算上的原因以及表示上的原因。 2. 为什么要集成 1)模型选择 假设各弱分类

机器学习最近那么火,博主自学习以来,也看过不少有关机器学习的资料,首先对于机器学习的定义就又五花八门,什么让机器像人一样去学习,说的总感觉有些浮夸而不现实,把机器学习搞的也太神秘了,有幸看了吴恩达的...

集成学习这篇博客是在学习集成学习时总结多篇博客和文章,再加上自己一些看法和补充的结果。具体参考的博客和文章见文末参考文献。集成学习概述集成学习(Ensemble learing)是使用一系列学习器进行学习,并使用某种...

一、关于集成学习的概念 1.集成学习概念 集成学习是机器学习中一个非常重要且热门的分支,是用多个弱分类器构成一个强分类器,其哲学思想是...

推荐文章

- YOLO V8车辆行人识别_yolov8 无法识别路边行人-程序员宅基地

- jpa mysql分页_Spring Boot之JPA分页-程序员宅基地

- win10打印图片中间空白以及选择打印机预览重启_win10更新后打印图片中间空白-程序员宅基地

- 【加密】SHA256加盐加密_sha256随机盐加密-程序员宅基地

- cordys 启动流程_cordys服务重启-程序员宅基地

- net中 DLL、GAC-程序员宅基地

- (一看就会)Visual Studio设置字体大小_visual studio怎么调整字体大小-程序员宅基地

- Linux中如何读写硬盘(或Virtual Disk)上指定物理扇区_dd写入确定扇区-程序员宅基地

- python【力扣LeetCode算法题库】面试题 17.16- 按摩师(DP)_一个有名的讲师,预约一小时为单位,每次预约服务之间要有休息时间,给定一个预约请-程序员宅基地

- 进制的转换技巧_10111100b转换为十进制-程序员宅基地