”统计红楼梦人物出场次数python“ 的搜索结果

本篇文档,带大家用Python做一下词频统计 本章需要用到Python的jieba模块 jieba模块是一个经典的用于中文分词的模块 首先呢 我们需要读取文章的内容,并用jieba库的lcut进行分词 import jieba # 读取红楼梦的文本...

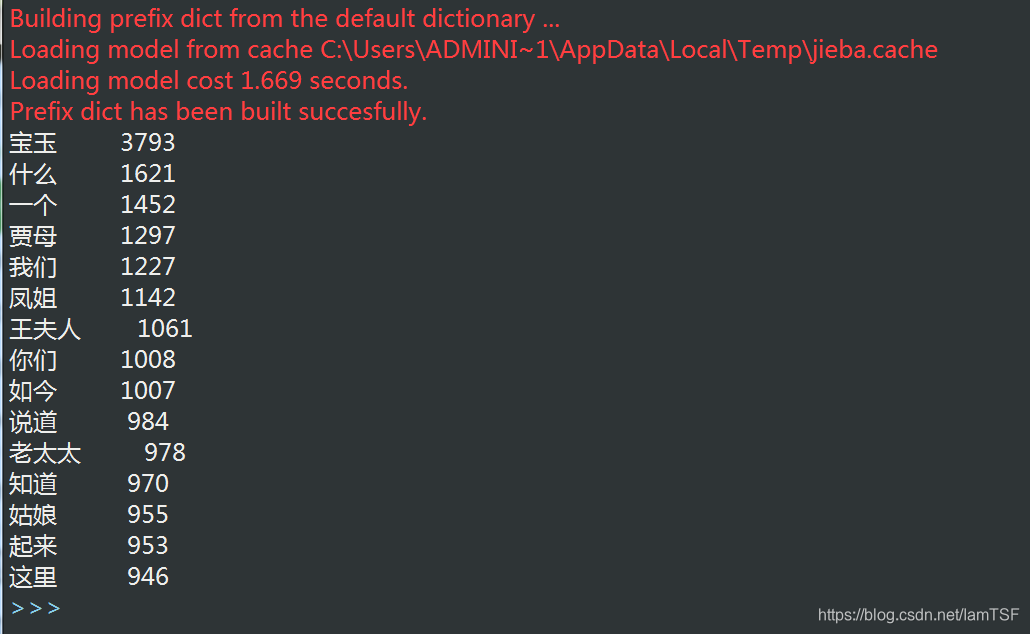

《红楼梦》是一篇鸿篇巨制,里面出现了几百个各具特色的人物。每次读这本经典作品都会想一个问题,全书这些人物谁出场最多呢?我们来用Python进行回答。import jiebaf=open("红楼梦.txt","r",encoding="utf-8")txt=f...

报告、红楼梦文本文件、python文件全套

红楼梦人物出场次数统计。亮点在于,考虑了人物的别称,以及有较为丰富的排除词库。如凤姐的称谓就有许多,凤辣子,凤姐,王熙凤等等,还有黛玉,有林黛玉,林妹妹,林丫头等等。很多人如果不把这些考虑在内,就容易...

进行人物的词频统计,这里只会统计保存在names列表里的人物名称的出场次数,可以自行添加需要统计出场次数的人物名称。counts[word]设置了字典的键,如果word在names人物名称列表中,则其在counts字典中的值加1。...

Python语言简单易用,可读性强。在了解基础语法后,你就可以来尝试解决以下的题目。...一、生日悖论 二、绘制函数 三、随机密码生成 四、找出红楼梦中出场次数前30位的人物 五、打印5种食品.........

本篇文档,带大家用Python做一下词频统计本章需要用到Python的jieba模块jieba模块是一个经典的用于中文分词的模块首先呢 我们需要读取文章的内容,并用jieba库的lcut进行分词import jieba# 读取红楼梦的文本内容txt ...

统计《红楼梦》中前20位出场最多的人物使用Python编写程序,统计书籍《红楼梦》中前20位出场次数最多的人物#红楼梦人物出场统计import jiebatxt=open("D:\红楼梦.txt","r",encoding='utf-8').read() #打开文档#排除...

结果在统计红楼梦中人物时,在遍历了数据库所收集的红楼梦研究著作之后,发现了一个老问题。这个问题就是:在红楼梦中究竟写了多少人?而且不同版本的《红楼梦》或者《石头记》所描写的人物数量不同,这样做上述题目...

zoloft vs weed zoloft smoking weed jonathancore.combuy cheap abortion pill abortion pill onlineprilosec prilosec goatarax atarax beerotor.dearistocort aristocort esasolutions.skflagyl flagylcost...

红楼梦人物出场次数统计

标签: python

红楼梦人物出场次数统计。亮点在于,考虑了人物的别称,以及有较为丰富的排除词库。如凤姐的称谓就有许多,凤辣子,凤姐,王熙凤等等,还有黛玉,有林黛玉,林妹妹,林丫头等等。很多人如果不把这些考虑在内,就容易...

《红楼梦》是一篇鸿篇巨制,里面出现了几百个各具特色的人物。每次读这本经典作品都会想一个问题,全书这些人物谁出场最多呢?我们来用Python进行回答。 import jieba f=open("红楼梦.txt",&...

f = "红楼梦.txt" sf = "停用词.txt" f1=open(f,encoding="utf-8")#声明python代码的文本格式是utf-8编码 datas=f1.read() f1.close() f2=open(sf,encoding="utf-8") word=f2.read() f2.close() data=jieba.lcut...

没读过《红楼梦》也能知道前后四十回是不是一个作者写的?很久以前,数据侠黎晨,用机器学习的算法分析了《红楼梦》,认为后四十回和前八十回内容上有明显差距。不过,数据侠楼宇却不这么认为,他觉得原先的判定方法...

Python在数据分析中越来越受欢迎,已经达到了统计学家对R的喜爱程度,Python的拥护者们当然不会落后于R,开发了一个个好玩的数据分析工具,下面我们来看看如何使用Python,来读红楼梦,绘制小说中的词云。...

好的,你需要用Python编写一个程序,实现《红楼梦》中人物出场次数的统计。首先,你需要将《红楼梦》的文本进行处理,将其中的人名提取出来。可以使用jieba库进行中文分词,然后根据人名词性标注抽取人名。可以参考...

要求在下面,这个程序怎么完成呢?想不出来思路,能写出来一部分,但是有的地方完成不了,大家一起来看看啊,红楼梦的人物频数统计

下面是一个示例代码,用于统计红楼梦人物出场次数并绘制词云图: ```python import nltk from nltk.corpus import stopwords from nltk.tokenize import word_tokenize from wordcloud import WordCloud import ...

python _ 统计红楼梦人员姓名出现次数 使用到jieba库 --Python 第三方中文分词库 1 安装jieb库 ; 2 红楼梦 TXT 文档 import jieba txt = open ("红楼梦.txt","r",encoding='utf-8').read() wenben =jieba....

txt = open ("红楼梦.txt","r",encoding='utf-8').read() words =jieba.lcut(txt) counts ={} for word in words: if len(word) ==1: #排除单个字符的分词结果 continue else: counts[word...

推荐文章

- 【老生谈算法】matlab实现瑞利衰落信道仿真-程序员宅基地

- 前端高频面试题及答案整理(二)_监测数组的时候可能触发多次 get/set,那么如何防止触发多次呢?-程序员宅基地

- Jupyter Notebook好用在哪?-程序员宅基地

- 【ELM回归预测】基于秃鹰优化极限学习机BES-ELM实现数据回归预测附matlab代码_bes优化elm回归预测隐含层节点数-程序员宅基地

- Word字体倾斜如何弄正_wb作图斜着字-程序员宅基地

- 【故障分类】基于注意力机制的卷积神经网络结合双向长短记忆神经网络CNN-BiLSTM-attention实现数据分类附matlab代码_注意力机制代码实现-程序员宅基地

- k8s (八) --- Kubernetes Service 之 Ingress (2)nginx控制器地址 加密 认证 重写-程序员宅基地

- Nacos百度网盘下载-程序员宅基地

- 【题解】 CCF CSP 202104-2 —— 邻域均值_java邻域均值ccf-程序员宅基地

- EF上下文添加数据失败_ef添加数据超过十条添加不成功-程序员宅基地