”元学习“ 的搜索结果

前言:写本篇是为了记录一下之前阅读过的一些关于联邦学习的文章(主要是两篇联邦学习综述),然后对其中的一些关键点进行了总结,并加入了个人对于联邦学习这一研究领域的理解以及思考(侵删)。 可供参考链接:...

迁移学习的核心就是通过减少源域和目标域之间的分布差异,进而利用源域信息完成目标域的学习。与领域自适应问题强调适配源域与目标域之间的数据分布相比,领域泛化更强调有源域学习到的模型可以泛化到任意新出现的...

基于判别性特征学习的极化SAR图像分类 基于卷积神经学习表征框架的高光谱图像分类 基于卷积神经网络与邻域相关性的SAR图像分类算法研究 基于卷积神经网络的图像分类研究 基于卷积神经网络的图像分类研究 ...

好多人都在问如何学习有限元分析,下来我们就针对这个问题做一下简单的梳理:也是我总结的学习有限元分析心得,感谢大家的阅读。 如果我不得不说出人们在学习有限元分析时遇到的第一个问题,那肯定是缺乏时间。 当...

(1)首先,我先强调一下蒸馏学习其实本质是模型压缩!模型压缩!模型压缩!S模型有的精度高于T模型,有的低于T模型,但是可以很好地压缩网络体积。 (2)知识蒸馏是由Hiton的Distilling the Knowledge in a Neural ...

1943:形式神经元模型(M-P模型),并在物理网络得以实现——开启了神经网络研究的序幕。 (1)机器学习的目的 特征表示 (2)深度学习的任务/优势 浅层学习——深度学习 (3)深度学习的改进/方向 参数少 模型...

在神经网络的参数更新过程中,学习率不能太大也不能太小,太大可能会导致参数在最优值两侧来回移动,太小会大大降低优化速度,为了解决学习率的问题,TensorFlow 提供了一种灵活的学习率设置方法,即指数衰减法。...

深入探究深度学习、神经网络与卷积神经网络以及它们在多个领域中的应用

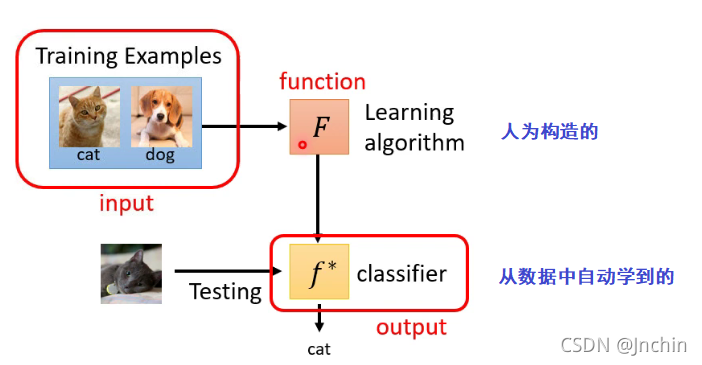

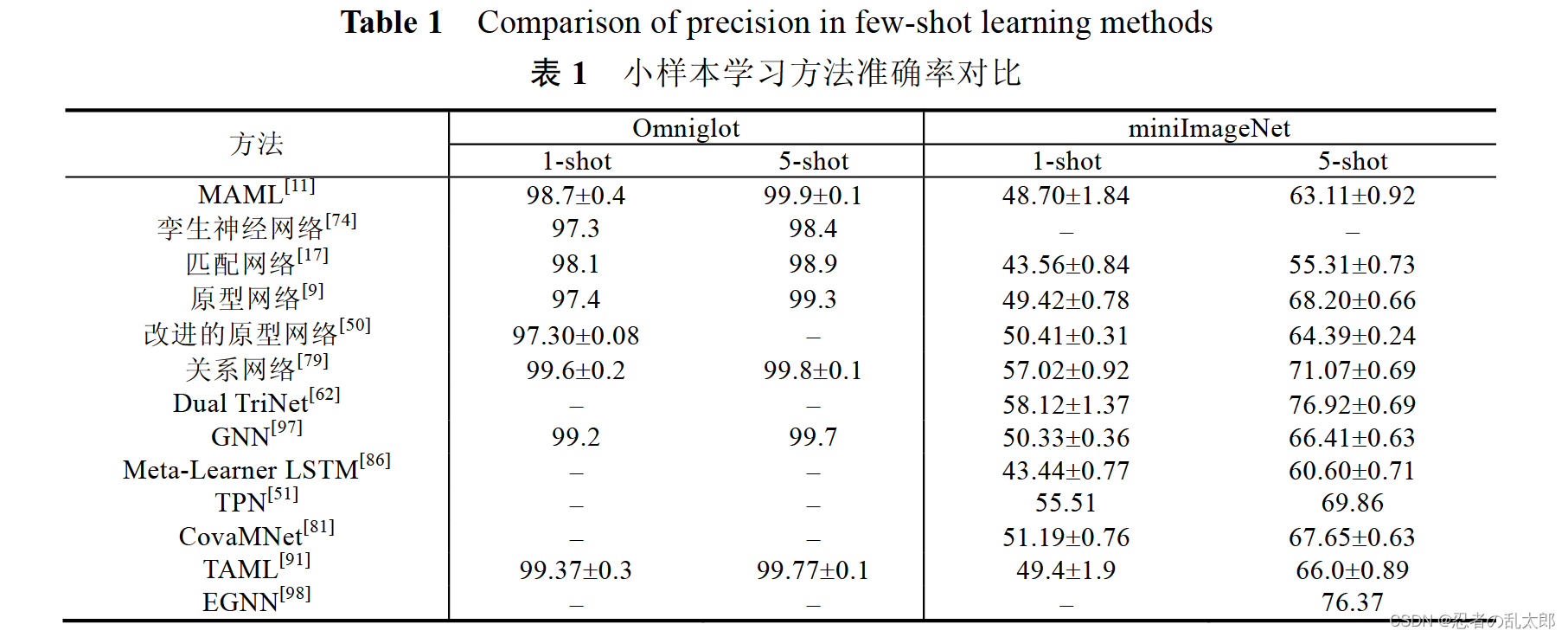

小样本学习(few-shot learning,FSL)旨在从有限的标记实例(通常只有几个)中学习,并对新的、未见过的实例进行识别。首先,在FSL设置中,通常有三组数据集,包括支持集S、查询集Q和辅助集A。S中的实例类别已知,Q...

Aligning Domain-Specific Distribution and Classifier for Cross-Domain Classification from Multiple Sources 文章链接:https://aimagazine.org/ojs/index.php/AAAI/article/view/4551 Code:...

神经元的工作原理 大脑神经系统无论从构造和功能来讲,都称得上是一个非常复杂的巨系统。 2019年8月,谷歌与霍华德休斯医学研究所(HHMI)和剑桥大学合作,发布了一项最新深入研究果蝇大脑的研究成果——自动重建...

学习的对象通常是样本特征向量的距离,度量学习的目的是通过训练和学习,减小或限制同类样本之间的距离,同时增大不同类别样本之间的距离。常用度量学习损失方法(1)对比损失用于训练Siamese(孪生)网络,,输入为...

在本节中,我们将了解传统机器学习与人工神经网络间的差异,并了解如何在实现前向传播之前连接网络的各个层,以计算与网络当前权重对应的损失值;实现反向传播以优化权重达到最小化损失值的目标。并将实现网络的所有...

推荐文章

- 大数据和云计算哪个更简单,易学,前景比较好?_大数据和云计算哪个好-程序员宅基地

- python操作剪贴板错误提示:pywintypes.error: (1418, 'GetClipboardData',线程没有打开的剪贴板)...-程序员宅基地

- IOS知识点大集合_ios /xmlib.framework/headers/xmmanager.h:66:32: ex-程序员宅基地

- Android Studio —— 界面切换_android studio 左右滑动切换页面-程序员宅基地

- 数据结构(3):java使用数组模拟堆栈-程序员宅基地

- Understand_6.5.1175::New Project Wizard_understand 6.5.1176-程序员宅基地

- 从零开始带你成为MySQL实战优化高手学习笔记(二) Innodb中Buffer Pool的相关知识_mysql_global_status_innodb_buffer_pool_reads-程序员宅基地

- 美化上传文件框(上传图片框)_文件上传框很丑-程序员宅基地

- js简单表格操作_"var str = '<table border=\"5px\"><tr><td>序号</td><-程序员宅基地

- Power BI销售数据分析_powerbi汇总销售人员业绩包括无销售记录的人-程序员宅基地