Transformer3. Self-Attention 机制详解4. Positional Encoding5. Layer Normalization6. Transformer Encoder 与 Decoder7. 总结Others 最近在家听贪心学院的NLP直播课。放到博客上作为NLP 课程的简单的梳理。 ...

”transformer“ 的搜索结果

模型自行下载

ocr-transformer

204k令牌(演示目的)安装$ pip install sinkhorn_transformer用基于Sinkhorn变压器的语言模型import torchfrom sinkhorn_transformer import SinkhornTransformerLMmodel = SinkhornTransformerLM ( num_tokens = ...

speech-transformer 语音识别 可以跑得起来训练还用aishell 即可 只要按照readme操作 后期还没测试效果只是 训练了几轮,其中的.rar 是模型文件和.pth 是一样的

Transformer是一种主要基于自注意力机制的深度神经网络,最初应用于自然语言处理领域。受Transformer强大的表征能力的启发,研究人员提出将Transformer扩展到计算机视觉任务中。与卷积网络和循环网络等其他网络类型...

Transformer和计算机视觉的跨界组合——DetectionTransformer.pdf

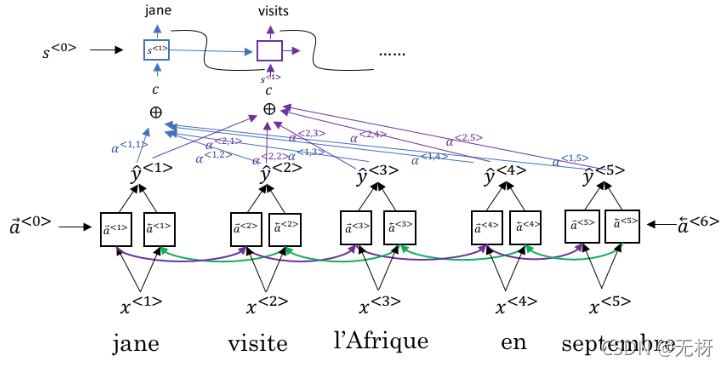

介绍从RNN到Attention到Transformer系列中Decode-Encode(Seq2Seq) https://blog.csdn.net/qq_39707285/article/details/124726403

给大家分享一套深度学习-Transformer实战系列视频课程,希望对大家学习有帮助,记得给五星好评哦

本文详细讲解了从卷积神经网络到Transformer的深度学习发展趋势,介绍了Transformer的背景、核心算法原理以及具体代码实例和解释。同时,本文还对Transformer的未来发展趋势和挑战进行了深入分析。最后,本文总结了...

tensorflow2.0版本 Transformer模型 中英翻译

变形金刚 一个用于对变压器进行排名实验的库。设置以下内容将克隆存储库,安装虚拟环境并根据要求安装库。 # Clone the repogit clone ... 我们可以按以下方式下载数据: from

list-transformer 这个库提供了一个遵守Monad法则的“ ListT done right implementation”。 以下是如何构建和使用ListT值的示例: import List.Transformer import qualified System.IO stdin :: ListT IO ...

本文首先介绍了Transformer模型的背景、思想和核心机制,然后重点介绍了Transformer的两个关键组件:自注意力机制和多头注意力机制,给出了具体的示例代码。最后讨论了Transformer模型在自然语言处理中的两个典型应用:...

资源分类:Python库 所属语言:Python 使用前提:需要解压 资源全名:transformer_embedder-1.6.6-py3-none-any.whl 资源来源:官方 安装方法:https://lanzao.blog.csdn.net/article/details/101784059

PyTorch实现基于Transformer的神经机器翻译

GalleryViewPager7 行 ViewPager.Transformer 代码让 ViewPager 有 3D Gallery 效果效果代码public class GalleryTransformer implements ViewPager.PageTransformer { @Override public void transformPage(View ...

张量流转换器

如何使用 transformer ( U , theta , out_size )参量U : float The output of a convolutional net should have the shape [num_batch, height, width, num_channels]. theta: float The output of the ...

From Attention to Transformer.pptx

复现成功且有重写readme复现成功且有重写readme复现成功且有重写readme复现成功且有重写readme复现成功且有重写readme复现成功且有重写readme复现成功且有重写readme

原因是:如果让“习”看到了后面的字,那么“习”字的编码就会发生变化。,也就是说在预测时无法看到之后的输入输出,但是在注意力机制当中,可以看到完整的输入(每一个词都要和其他词做点积,计算相关性),为了避免...

npm install workerloader-jest-transformer --save-dev 或者 yarn add workerloader-jest-transformer --dev 设置Jest配置文件 必须在您的Jest配置文件中使用workerloader-jest-transformer ,如下所示: { ...

3-1+Swin+Transformer和拥抱Transformer的5个理由

作者:禅与计算机程序设计艺术 《深度学习中的 Transformer 应用》 1. 引言 随着深度学习技术的快速发展,Transformer 模型的出现

推荐文章

- Pytorch Dataloader 模块源码分析(二):Sampler / Fetcher 组件及 Dataloader 核心代码-程序员宅基地

- Asp类型判断及数组打印-程序员宅基地

- Adroid Studio 2022.3.1 版本配置greendao提示无法找到_plugin with id 'org.greenrobot.greendao' not found-程序员宅基地

- esxi查看许可过期_解决Vsphere Client 60天过期问题-程序员宅基地

- CMake_cmake_module_path-程序员宅基地

- 生产者消费者模型-程序员宅基地

- Adaptive AUTOSAR 解决方案 INTEWORK-EAS-AP_autosar的eas-程序员宅基地

- 穿山甲SDK错误码40025_穿山甲sdk错误码4025-程序员宅基地

- css firefox下的兼容问题_css 只用于firefox-程序员宅基地

- 【Python】对大数质因数分解的算法问题_python分解多个质因数代码-程序员宅基地