”torch“ 的搜索结果

在 Torch 中,可以通过继承类来定义自己的深度学习模型。以上代码中,Net类继承自,并定义了两个全连接层(self.fc1和self.fc2在forward()方法中,先将输入数据展开成一维向量(),然后依次经过两个全连接层和一个 ...

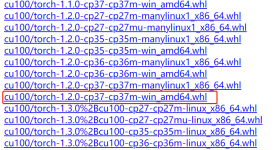

torch安装 torch-1.9.0-cp36-cp36m-win_amd64.whl

1、torch.no_grad上一个上下文管理器,在你确定不需要调用Tensor.backward()时可以用torch.no_grad来屏蔽梯度计算;2、在被torch.no_grad管控下计算得到的tensor,它的requires_grad就是False;

torch常见用法

torch1.2.0+torchvision0.4.0.rar_pip镜像下载torch

1 torch.save()[source] 保存一个序列化(serialized)的目标到磁盘。函数使用了Python的pickle程序用于序列化。模型(models),张量(tensors)和文件夹(dictionaries)都是可以用这个函数保存的目标类型。 ...

PyTorch中通过torch.save保存模型和torch.load加载模型介绍

一、tensor的创建 ...- `torch.tensor`会复制data,不想复制可以使用`torch.Tensor.detach()`。 - 如果是获得numpy数组数据,可以使用`torch.from_numpy()`,共享内存 ```python # 1. tensor torch.tensor(data, d

位置乘数乘torch.mv()矩阵向量乘法torch.mm()矩阵乘法torch.dot()点乘积@操作。

PyTorch中torch、torchvision、torchaudio版 torch torchaudio python main / nightly main / nightly >=3.7, <=3.9 1.10.0 0.10.0 >=3.6, <=3.9 1.9.1 0.9.1 >=3.6, <=3.9 1.9.0 ...

torch 本笔记引用自PyTorch中文文档 包torch包含了多维疑是的数据结构及基于其上的多种数学操作。 1. 张量Tensors torch.is_tensor(obj): 如果obj是一个pytorch张量,则返回True torch.is_storage(obj): ...

torch中tensor的一些创建方式

PyTorch中的torch.nn.Parameter() 详解 今天来聊一下PyTorch中的torch.nn.Parameter()这个函数,笔者第一次见的时候也是大概能理解函数的用途,但是具体实现原理细节也是云里雾里,在参考了几篇博文,做过几个实验...

在pytorch写的网络中,with torch.no_grad():非常常见。 首先,关于python中的with: with 语句适用于对资源进行访问的场合,确保不管使用过程中是否发生异常都会执行必要的“清理”操作,释放资源,比如文件使用后...

详解 torch.unsqueeze 和 torch.squeeze1. 入门测试2. 深入研究2.1 torch.unsqueeze 详解2.2 unsqueeze_和 unsqueeze 的区别2.3 torch.squeeze 详解 1. 入门测试 torch.squeeze(input, dim = None, out = None): ...

将Softmax函数应用于沿dim的所有切片,并将重新缩放它们,使元素位于01的范围内并和为1。

*,@是两个运算符,他们分别映射到函数torch.mul和torch.matmul() 运算符映射函数表https://docs.python.org/3/library/operator.html#mapping-operators-to-functions 广播机制(摘自...

推荐文章

- 【解决报错】java.sql.SQLException: Access denied for user 'root'@'localhost' (using password: YES)-程序员宅基地

- echart y轴显示小数或整数_echarts y轴显示16位小数-程序员宅基地

- Android客户端和Internet的交互_android与internet-程序员宅基地

- linux新建分区步骤_linux创建基本分区的步骤-程序员宅基地

- 信号处理-小波变换4-DWT离散小波变换概念及离散小波变换实现滤波_dwt离散小波变换进行滤波-程序员宅基地

- Ubuntu 10.10中成功安装ns-allinone-2.34_进入/home/ubuntu1/ns-allinone-2.34目录cd /home/ubuntu1-程序员宅基地

- 使用AES算法对字符串进行加解密_java 判断aes加密 与否-程序员宅基地

- DFS深度优先搜索(前序、中序、后序遍历)非递归标准模板_深度优先搜索 无递归-程序员宅基地

- 程序员面试字节跳动,被怼了~_字节跳动java什么技术站-程序员宅基地

- 嵌入式软考备考(五)安全性基础知识-程序员宅基地