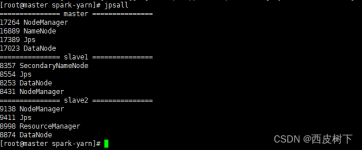

安装前准备 spark下载 由于我们的hadoop的版本是2.7.6.所以在选中spark版本的时候,要注意. 要选中pre-built for apache hadoop2.7 and later的版本 #下载spark [root@spark-master local]# wget ...

”spark安装“ 的搜索结果

Spark集群安装部署

标签: spark

Spark安装部署

1. 解压Spark安装包 2. 配置Hadoop生态组件相关环境变量 2. 在 master 节点上,关闭HDFS的安全模式: 3. 在 master 节点上

环境:CentOS 6.3, Hadoop 1.1.2, JDK 1.7, Spark 0.9.0, Scala 2.10.3 1. 安装 JDK 1.7 yum search openjdk-devel sudo yum install java-1.7.0-openjdk-devel.x86_64 /usr/sbin/alternatives --config java /usr/...

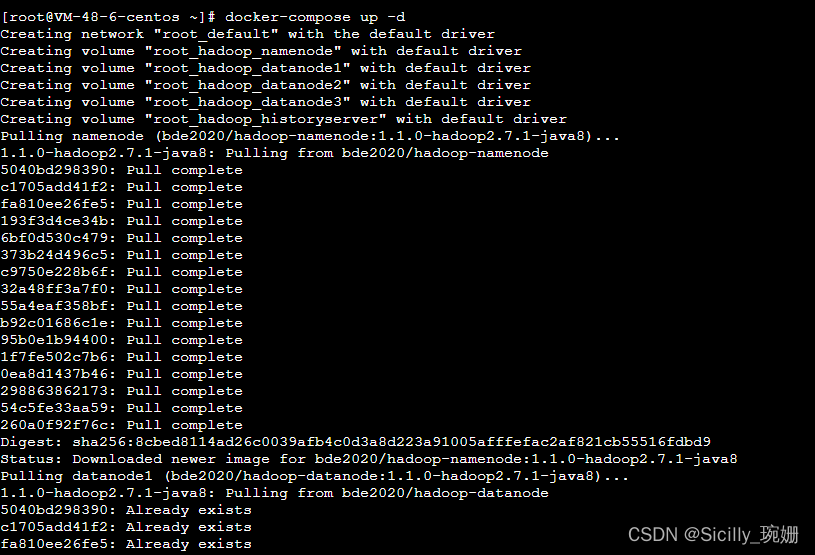

今天我们了解下Spark的安装. Spark的安装模式有很多模式, 主要包括 Spark Standalone、Running Spark on YARN、Running Spark on Kubernetes、Running Spark on Mesos. 其中YARN/Mesos/Kubernetes都是资源的调度器. ...

第一关 Scala语言开发环境的部署 1.下载解压 在Scala官网根据平台选择下载Scala的安装包scala-2.17.7.tgz 解压到/app目录下: mkdir /app //创建 app 目录 ...tar -zxvf scala-2.12.7.tgz -C /app ...

一、下载spark的压缩包 解压 tar -zxvf 压缩名 给解压缩后的文件名重新命名为spark mv spark-2.3.2-bin-hadoop spark 二、修改配置文件 进入spark/conf目录 把spark-env.sh.template文件复制一份并创建文件spark-...

spark3.x的安装与配置,超详细

本文仅记录在MacBook Pro M1型号上安装 JDK8、Hadoop-2.6.5、spark-2.3.2

安装容易产生的错误: spark不需要设置环境变量,因为spark在/home/hadoop/spark/spark-2.3.1-bin-hadoop2.7目录下启动sbin/start-all.sh 如果设置spark环境变量,直接启动start-all.sh 会启动hadoop的集群 spark...

一、 Spark安装 环境要求 Spark可以在Windows和类Unix系统(例如Linux, Mac OS)上运行。运行Spark需要系统中先安装Java环境,并设置JAVA_HOME环境变量为Java的安装目录。 Spark运行在Java8+,Python2.7+/...

目录 1.节点访问logs目录时 有 Permission ...2.failed to launch: nice -n 0 /soft/spark/bin/spark-class org.apache.spark.deploy.worker.Worker... 3.ERROR Worker: Failed to create work directory /soft/sp...

Spark是UC Berkeley AMPLab开发的类MapRed计算框架。MapRed框架适用于batch job,但是由于它自身的框架限制,第一,pull-based heartbeat作业调度。第二,shuffle中间结果全部落地disk,导致了高延迟,启动开销很大...

首先来聊聊什么是Spark?为什么现在那么多人都用Spark? Spark简介: Spark是一种通用的大数据计算框架,是基于**RDD(弹性分布式数据集)**的一种计算模型。那到底是什么呢?可能很多人还不是太理解,通俗讲就是可以...

简介之前有写过hive on spark的一个文档,hive版本为2.0,spark版本为1.5。spark升级到2.0后,性能有所提升,程序文件的编排也和之前不一样,这里再更新一个最新的部署方式。...安装步骤可参考官网ht

http://blog.csdn.net/pipisorry/article/details/50924395安装HadoopSpark默认使用HDFS充当...spark单机环境安装{linux下的安装,windows上也类似}安装jdk依赖[java环境配置:安装jdk]下载spark相应hadoop2.*版本选择

安装Scala版本选择Spark官方对配套的Scala版本有规定,所以要根据自己的实际情况来选择Scala版本。因此首先去Spark官网下载Spark,再根据要求下载对应版本的Scala。在http://spark.apache.org/docs/1.6.2/中有一句...

推荐文章

- Python Django 版本对应表以及Mysql对应版本_django版本和mysql对应关系-程序员宅基地

- Maven的pom.xml文件结构之基本配置packaging和多模块聚合结构_pom <packaging>-程序员宅基地

- Composer 原理(二) -- 小丑_composer repositories-程序员宅基地

- W5500+F4官网TCPClient代码出现IP读取有问题,乱码问题_w5500 ping 网络助手 乱码 send(sock_tcps,tcp_server_buff,-程序员宅基地

- Python 攻克移动开发失败!_beeware-程序员宅基地

- Swift4.0_Timer 的基本使用_swift timer 暂停-程序员宅基地

- 元素三大等待-程序员宅基地

- Java软件工程师职位分析_java岗位分析-程序员宅基地

- Java:Unreachable code的解决方法_java unreachable code-程序员宅基地

- 标签data-*自定义属性值和根据data属性值查找对应标签_如何根据data-*属性获取对应的标签对象-程序员宅基地