”numpy实现mlp“ 的搜索结果

这是在python下,用Numpy手写的多层感知机神经网络,包括前向传播过程,后向...本代码所用的测试数据集为mnist,当使用MSE损失函数,Sigmoid激活函数时,我用numpy实现的神经网络和用pytorch实现的神经网络完全相同。

摘要: 纯NumPy代码从头实现简单的神经网络。 Keras、TensorFlow以及PyTorch都是高级别的深度学习框架,可用于快速构建复杂模型。前不久,我曾写过一篇文章,对神经网络是如何工作的进行了简单的讲解。该文章侧重...

这几天又在玩树莓派,先是搞了个物联网,又在尝试在树莓派上搞一些简单的神经网络,这次搞得是mlp识别mnist手写数字识别 训练代码在电脑上,cpu就能训练,很快的: 1 import torch 2 import torch.nn as nn 3 ...

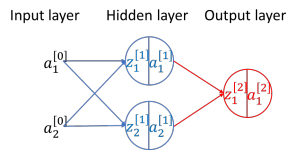

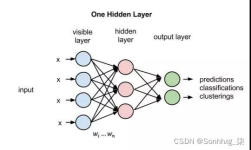

②隐藏层:可以有一层或多层,每层节点数量可自由设置,每层的激活函数也可以不一样(甚至可以为每个节点分配不同的激活函数,但这样做并无太大意义,且代码会变得很复杂),本文代码默认所有隐藏层使用相同的激活...

Network,竞争性学习和SOM),并使用Numpy库在MATLAB / Python中从头开始实现它们。 请注意,某些代码需要进一步清除。 每个文件夹的内容 MLP_one_layer 实施,训练和测试具有多个输出的一层网络,以对CIFAR-10数据...

在这个例子中,MLP模型有两个全连接层。数据加载器用于将数据分成小批次进行训练和测试。是输入图像的大小(28x28=784),,然后通过ReLU激活函数,再传递给。是输出的类别数(这里是10个数字),中,我们定义了两个...

以下是一个简单的MLP实现的代码示例: ```python import numpy as np class MLP: def __init__(self, input_size, hidden_size, output_size): self.input_size = input_size self.hidden_size = hidden_size ...

下面是一个简单的numpy实现多层感知器(MLP)的反向传播: ```python import numpy as np class MLP: def __init__(self, input_size, hidden_size, output_size): self.input_size = input_size self.hidden_...

直接提供代码 一共分四个文件 ...mlp用于读取mnist数据集并进行训练 记得把trainer,layer,net这三个文件拷到同一个文件夹下,方便mlp文件调用这三个文件的类 DogeTrainer.py from dogel...

文章目录基于Numpy的反向传播a) Logitstic regression对标签进行one-hot编码(类似keras中的to_categorical)Softmax实现交叉熵,也就是negative log likelihootb)多层感知机c) 更多操作查找预测结果最差的样本超参数...

直接先用前面设定的网络进行识别,即进行推理的过程,而先忽视学习的过程。 推理的过程其实就是前向传播的过程。 深度学习也是分成两步:学习 + 推理。学习就是训练模型,更新参数;推理就是用学习到的参数来处理新...

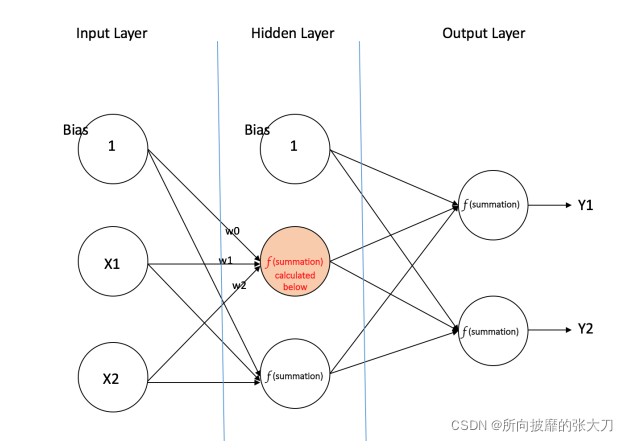

可以使用numpy编写多层感知机(MLP)。首先需要定义模型的结构,包括输入层、隐藏层和输出层的神经元数量。然后需要初始化权重和偏置,可以使用numpy的随机函数来实现。接下来,可以使用numpy的dot函数来计算每一层的...

from tensorflow.keras.datasets import mnist import numpy as np import random import tensorflow def sigmoid(inX): from numpy import exp return 1.0 / (1 + exp(-inX)) ...class MLP(): def __

学习笔记–numpy包 expand_dims()函数 np.expand_dims(array,axis)#维度扩充 一维数组 a=np.array([1,2,3]) b=np.expand_dims(a,axis=0) >>>b [[1,2,3]] c=np.expand_dims(a,axis=1) >>>c [[1]...

手写数字识别

使用numpy实现神经网络的前向传播,以及反向传播,使用矩阵计算加快运算速度,理论推导则在以前的博客中。

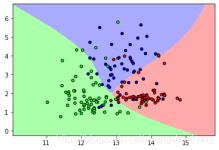

# 全连接神经网络(MLP)实现图像分类 Iris数据集 Python代码 代码包含以下内容: 1. 使用numpy搭建简单的全连接网络(MLP); 2. 使用scikit-learn调用Iris花卉分类数据集; 3. 前向计算和反向传播; 4. 使用计算图代替...

1、背景 多层神经网络的学习能力相当强大,在数据量相当充足的情况下,这种强大自然没有什么问题,但是对于一些问题来说,比如计算机视觉,数据通常是不足的,在这种情况下训练时就容易发生数据过拟合,通俗来讲,过...

#!/usr/bin/env python # -*- coding: utf-8 -*- """ @Time : 2022/3/11 14:33 @Author : @File : tf_ml_label.py @ desc: """ import platform ...import numpy as np import pandas as pd from.

1、原理简述 dropout简单来讲,就是在迭代的过程中,随机的丢弃掉某些神经元,使得其训练只包含部分神经元的网络,因为任何神经元都有可能消失,所以模型会变得对神经元不那么敏感,表现就是对参数W的压缩,起到与L2...

import numpy as np import matplotlib.pyplot as plt class MLP: " Multi-layer perceptron " def __init__(self, sizes, beta=1, momentum=0.9): """ sizes is a list of length four. The first ...

推荐文章

- 【Java进阶】线程池之无限队列 - 使用工厂类Executors.newFixedThreadPool(n) ,创建无限队列线程池_线程池无限队列-程序员宅基地

- python 之路,致那些年,我们依然没搞明白的编码-程序员宅基地

- 国二报C语言,国二C语言.doc-程序员宅基地

- FTP快速搭建-程序员宅基地

- [原创]我的WCF之旅(7):面向服务架构(SOA)和面向对象编程(OOP)的结合——如何实现Service Contract的继承_servicecontract using-程序员宅基地

- openmediavault(OMV) (18)云相册(2)photoprism-程序员宅基地

- VS2017使用protobuf动态链接库的编译错误问题_vs2017运行不了protobuf项目-程序员宅基地

- idea右键项目没有出现git选项、idea工具栏没有Git快捷图标_idea 右键没有git-程序员宅基地

- m3u8索引文件介绍_69嗉媂x.m3u8-程序员宅基地

- 2021 泰迪杯 A 题_第十二届泰迪杯数据挖掘竞赛a题论文-程序员宅基地