”dropout“ 的搜索结果

深度学习模型常常使用丢弃法(dropout)来应对过拟合问题。 3.13.1 方法 单隐藏层的多层感知机:其中输入个数为4,隐藏单元个数为5,且隐藏单元hih_ihi(i=1,…,5i=1, \ldots, 5i=1,…,5)的计算表达式为 hi=ϕ(x1...

引入的“ BPE-Dropout”算法的正式实现 介绍 该存储库包含原始论文中使用的BPE-Dropout算法的参考实现。 该存储库不包含用于构建BPE合并表的代码,为简单起见,它依赖于外部BPE合并表。 请注意,在执行子词分段的几...

Transformer模型-Dropout的简明介绍:丢掉一些元素,防止过度拟合_transformer dropout-程序员宅基地过程可以参考简单理解就是将mask为1的元素置零。

网格搜索神经网络超参数:丢弃率dropout(案例+源码)

1. Dropout简介1.1 Dropout出现的原因在机器学习的模型中,如果模型的参数太多,而训练样本又太少,训练出来的模型很容易产生过拟合的现象。在训练神经网络的时候经常会遇到过拟合的问题,过拟合具体表现在:模型在...

Dropout动态图

标签: Dropout正则化

利用动态图更好的理解Dropout动态图

深度学习-Dropout详解

标签: python

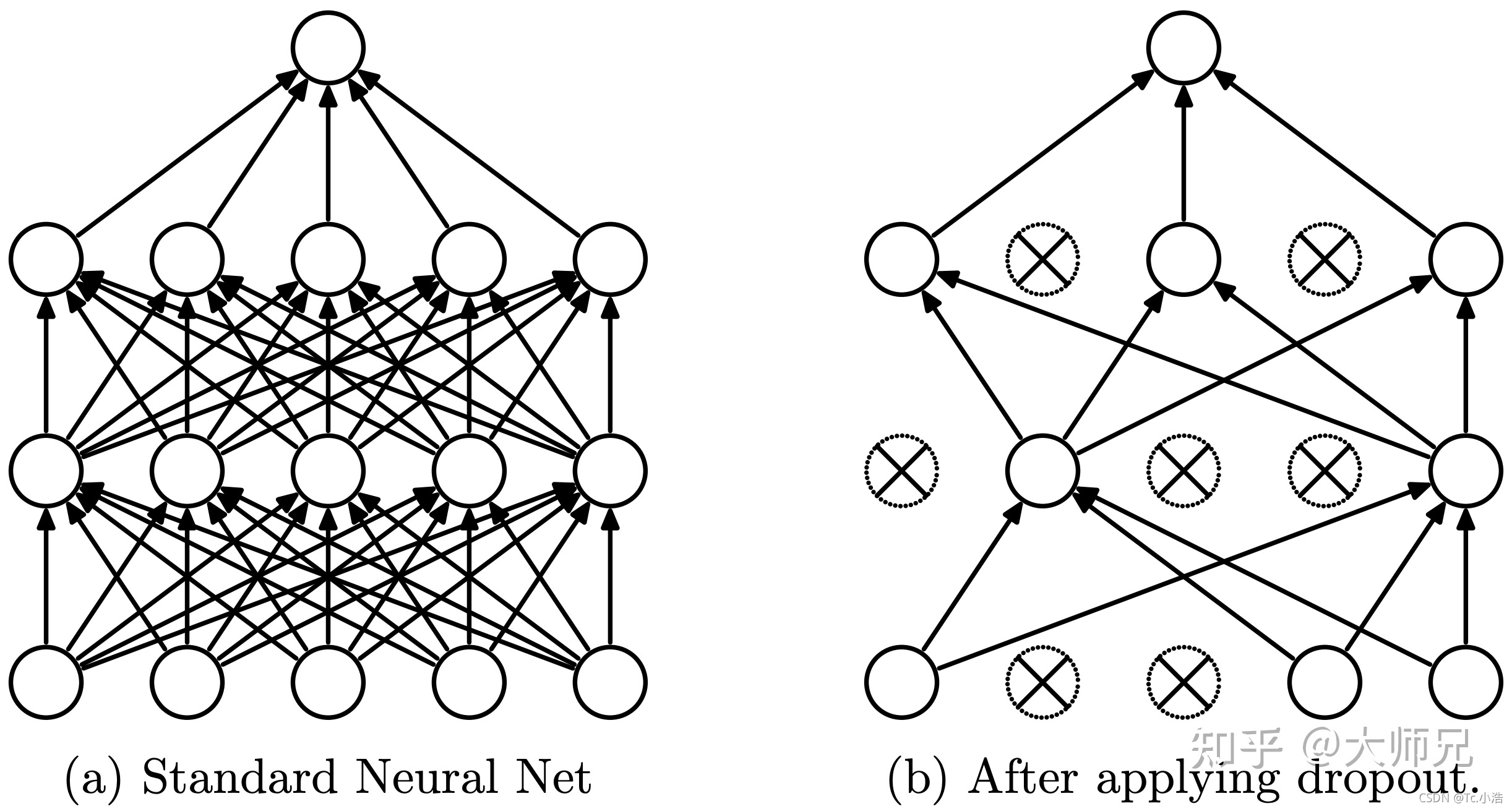

Dropout层的作用是在训练过程中,随机地将神经元的输出设置为0,从而强制模型学习更加鲁棒的特征,并且减少了神经元之间的相互依赖关系,使得模型的泛化能力更强。Dropout通过随机的将一部分神经元的输出设为0,从而...

解决过拟合之early stop和dropout

1. 背景介绍 1.1 机器学习模型的过拟合问题 在机器学习领域,我们经常会遇到一个棘手的问题——过拟合。过拟合指的是模型在训练数据上表现良好,但在测试数据上表现较差的现象。这通常是由于模型过于复杂,学习到了...

Dropout是2012年深度学习视觉领域的开山之作paper:《ImageNet Classification with Deep Convolutional》所提到的算法,用于防止过拟合。在我刚入门深度学习,搞视觉的时候,就有所耳闻,当时只知道它是为了防止过...

Dropout是一种在学习的过程中随机删除神经元的方法。训练时,随机选出隐藏层的神经元,然后将其删除。被删除的神经元不再进行信号的传递,如下图所示。训练时,每传递一次数据,就会随机选择要删除的神经元。然后,...

其中Dropout这个坑,我记忆犹新。 一开始,我以为预测时要保持和训练时完全一样的网络结构,也就是预测时用的网络也是有丢弃的网络节点,但是这样想就掉进了一个大坑!因为无法通过已经训练好的模型,来获取其训练时...

MLlib - 带有 Dropout 的逻辑回归这是 Spark MLlib 的扩展,使用 dropout 正则化实现逻辑回归。 Dropout 正则化通常比 L2 正则化效果更好,因为它强调在分类过程中很少出现但具有判别力的特征的贡献 [2]。 这使得它...

深度神经网络( Deep Neural Networks,DNNs )已经开始在生物学和医疗保健领域崭露头角,包括基因组学( Xiong et al . , 2015)、医学影像( Esteva et al , 2017)、EEG ( Rajpurkar et al , 2017)和EHR ( Futoma et al...

我觉得你也可以尝试其它方法,虽然我们并没有关于这些方法性能的数据统计,但你可以把它们与dropout方法一起使用。直观上理解不要依赖于任何一个特征,因为该单元的输入可能随时被清除,因此该单元通过这种方式传播...

总的来说,将 Transformer 描述为“kernel machine”是一种类比的说法,用来强调 Transformer 模型中注意力机制与核方法之间的一些数学和功能上的相似性,以及 Transformer 在处理序列数据时的性能和灵活性。...

Dropout是一种在训练神经网络时常用的正则化方法,由Hinton等人于2012年提出。其核心思想是在训练过程中随机“丢弃”(即暂时移除)神经网络中的部分神经元,这样做可以防止模型对训练数据过拟合。具体来说,每个...

三种类型的层: - C:卷积层(矩阵图) - MP:最大池化层(矩阵图) - F:全连接层(向量图) - O:输出层 卷积层: - 比例:比例(补丁大小) - 输出地图数量:outputMap - 共享权重:k - 偏差:b ...

Dropout是一种用于深度学习模型的正则化技术,旨在减少模型的过拟合。它的基本思想是在训练过程中,随机地将一部分神经元的输出置为零,从而减少神经元之间的相互依赖关系,降低模型对特定神经元的依赖性,提高模型...

Dropout的rescale

标签: 深度学习

dropout 有两种实现方式,Vanilla Dropout 和inverted Dropout。前者是 原始论文 中的朴素版后者在 Andrew Ng 的 cs231 课程中(https://cs231n.github.io/neural-networks-2/#init)有介绍。部分转述自: ...

Dropout:A Simple Way to Prevent Neural Networks from Overfitting.zip

针对机器学习中训练样本和测试样本概率分布不一致的问题,提出了一种基于dropout正则化的半监督域自适应方法来实现将神经网络的特征表示从标签丰富的源域转移到无标签的目标域。此方法从半监督学习的角度出发,在源...

./dropout.py 行为 辍学定期向指定主机发出HEAD请求,以检查互联网连接。 根据结果连接状态,Dropout可以将结果输出或记录到指定的csv文件中。 对于日志记录和输出,我们可以选择记录故障,更改或所有内容。 ...

python main.py --lr=.1 --lr_dropout_rate=0.5 原始代码来自回购。 它使用记录指标。 此实现不添加标准辍学。 初步结果 香草方法来自pytorch-cifar :SGD的lr=.1, momentum=.9, weight_decay=5e-4, batch_size=128...

有针对性的辍学 艾丹·戈麦斯(Eidan N. 目录 要求 Python 3 Tensorflow 1.8 快速开始 训练模型: python -m TD.train --hparams=resnet_default 修剪模型: python -m TD.scripts.prune.eval --hparams=resnet_...

在训练深度神经网络时,DropOut是一个非常成功且功能强大的技巧。 可以将其视为模型平均的一种方法-一种伪集成方法-以及一种随机正则化器。 在这项工作中,我们试图通过一系列实验确定性地丢弃网络中的一些权重,以...

Hinton在论文《Improving neural networks by preventing co-adaptation of feature detectors》中提出了Dropout。Dropout用来防止神经网络的过拟合。Tensorflow中可以通过如下3中方式实现dropout。 tf.nn.dropout ...

推荐文章

- confluence搭建部署_ata confluence-程序员宅基地

- SpringCloud与SpringBoot版本对应关系_springboot 2.1.1 对于的cloud-程序员宅基地

- 如何恢复硬盘数据?简单解决问题_磁盘恢复 csdn-程序员宅基地

- 苹果手机测试网络速度的软件,App Store 上的“网速测试大师-测网速首选”-程序员宅基地

- 教了一年少儿编程,说说感想和体验-程序员宅基地

- 22东华大学计算机专硕854考研上岸实录-程序员宅基地

- 如何用《玉树芝兰》入门数据科学?-程序员宅基地

- macOS使用brew包管理器_brew清理缓存-程序员宅基地

- 【echarts没有刷新】用按钮切换echarts图表的时候,该消失的图表还在,加个key属性就解决了_echarts 怎么加key值-程序员宅基地

- 常用机器学习的模型和算法_常见机器学习模型算法整理和对应超参数表格整理-程序员宅基地