非关系型型数据库redis(nosql表示不仅仅是sql)_非关系型数据库nosql表示的是no sql。()-程序员宅基地

文章目录

一、redis的简介

redis是一个key-value存储系统。和Memcached类似,它支持存储的value类型相对更多,包括string(字符串)、list(链表)、set(集合)、zset(sorted set --有序集合)和hash(哈希类型)。这些数据类型都支持push/pop、add/remove及取交集并集和差集及更丰富的操作,而且这些操作都是原子性的。在此基础上,redis支持各种不同方式的排序。与memcached一样,为了保证效率,数据都是缓存在内存中。区别的是redis会周期性的把更新的数据写入磁盘或者把修改操作写入追加的记录文件,并且在此基础上实现了master-slave(主从)同步。

二、redis的使用

1.redis的安装和主从复制的部署

环境准备:

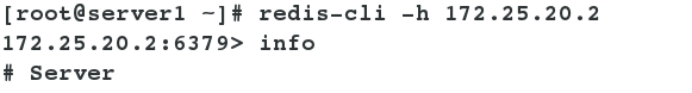

server1: 172.25.20.1 (主)

server2: 172.25.20.2 (从)

server3: 172.25.20.3 (从)

安装包可以直接在官网https://redis.io/上下载,本机使用的是最新的redis-5.0.3

tar zxf redis-5.0.3.tar.gz ##解压

cd redis-5.0.3/

yum install gcc ##安装编译所需环境

make && make install ##直接编译安装即可

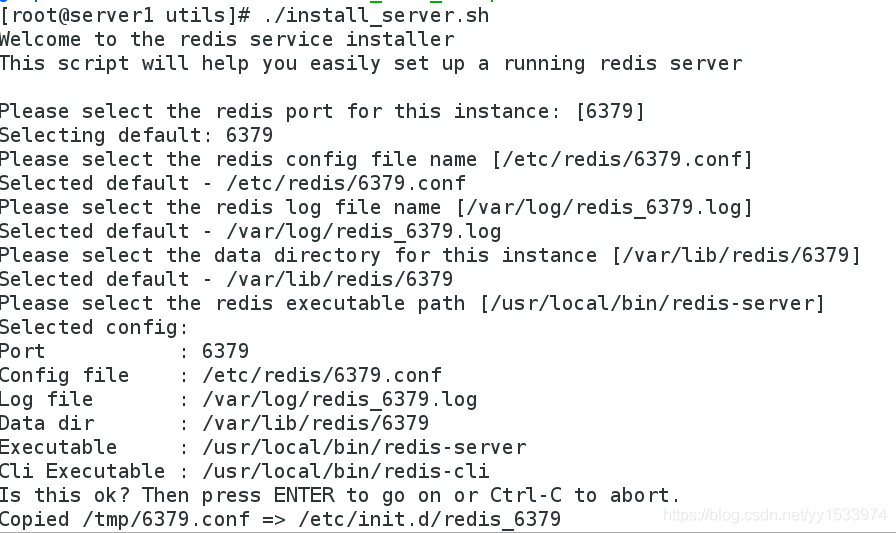

cd utils/

./install_server.sh ##使用默认配置即可,可以自动生成配置文件还有命令等

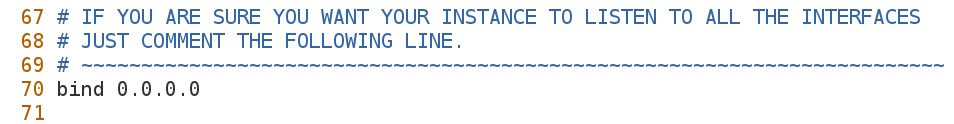

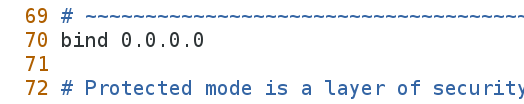

允许全网段访问并设置主从复制

server1的主设置:

vim /etc/redis/6379.conf ##修改配置文件

/etc/init.d/redis_6379 stop ##重启服务

/etc/init.d/redis_6379 start

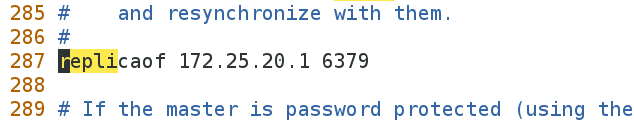

server2的从设置:

vim /etc/redis/6379.conf ##修改配置文件

/etc/init.d/redis_6379 stop ##重启服务

/etc/init.d/redis_6379 start

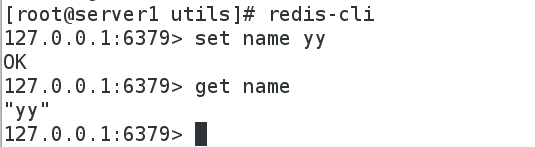

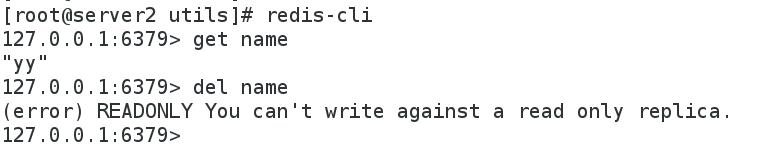

测试主从复制,在server1上写入数据,在server2上查看

redis-cli ##进入数据库

可以发现:

redis的主从复制中只有mater是可写的,其他的普通节点默认都是只读的

2.redis的高可用

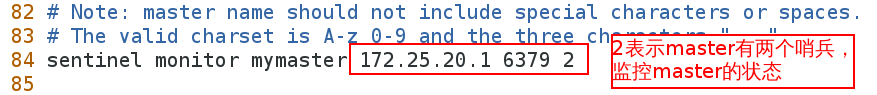

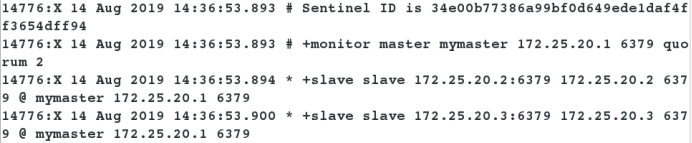

通过自带组件sentinel服务来实现主节点的自动切换,并且数据不会在切换中丢失

再开启一个server3,按照server2配置

sentinel是安装redis时自带的命令

cd redis-5.0.3

cp sentinel.conf /etc/redis/ ##把sentinel的配置文件模板复制过去即可

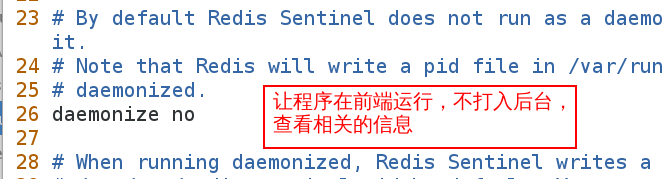

vim /etc/redis/sentinel.conf ##修改配置文件

scp /etc/redis/sentinel.conf server2:/etc/redis/ ##server1直接把修改后的文件发给server2和server3

scp /etc/redis/sentinel.conf server3:/etc/redis/

/etc/init.d/redis_6379 stop ##重启服务

/etc/init.d/redis_6379 start

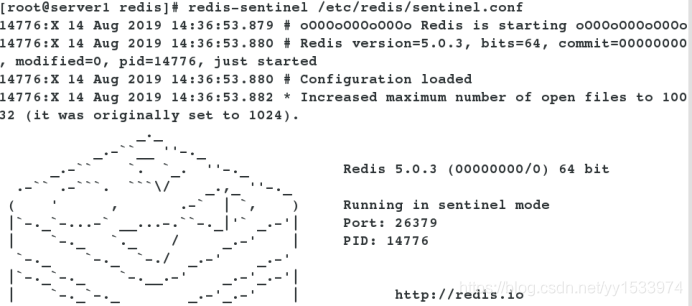

启动sentinel服务的两种方法:

redis-sentinel /etc/redis/sentinel.conf ##写上配置文件的位置

redis-server /etc/redis/sentinel.conf --sentinel

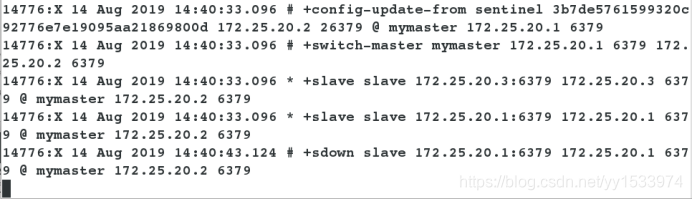

关闭server1的redis后

redis-cli

shoutdown ##进入数据库后关闭redis

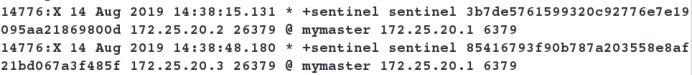

查看master的变化

连上新的master查看信息

再次启用server1后再看

3.redis的持久化

参考文档:http://www.redis.cn/topics/persistence.html

(1).Redis 提供了不同级别的持久化方式:

RDB持久化方式能够在指定的时间间隔能对你的数据进行快照存储.

AOF持久化方式记录每次对服务器写的操作,当服务器重启的时候会重新执行这些命令来恢复原始的数据,AOF命令以redis协议追加保存

每次写的操作到文件末尾.Redis还能对AOF文件进行后台重写,使得AOF文件的体积不至于过大.

如果你只希望你的数据在服务器运行的时候存在,你也可以不使用任何持久化方式.

你也可以同时开启两种持久化方式, 在这种情况下, 当redis重启的时候会优先载入AOF文件来恢复原始的数据,因为在通常情况下AOF

文件保存的数据集要比RDB文件保存的数据集要完整.

(2).如何选择使用哪种持久化方式?

一般来说, 如果想达到足以媲美 PostgreSQL 的数据安全性, 你应该同时使用两种持久化功能。

如果你非常关心你的数据, 但仍然可以承受数分钟以内的数据丢失, 那么你可以只使用 RDB 持久化。

有很多用户都只使用 AOF 持久化, 但我们并不推荐这种方式: 因为定时生成 RDB 快照(snapshot)非常便于进行数据库备份, 并且

RDB 恢复数据集的速度也要比 AOF 恢复的速度要快, 除此之外, 使用 RDB 还可以避免之前提到的 AOF 程序的 bug 。

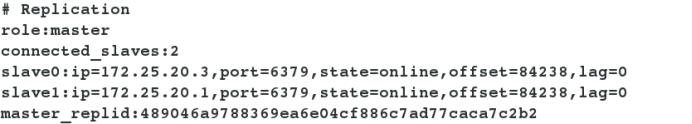

4.redis的单机版集群搭建

参考文档:http://www.redis.cn/topics/cluster-tutorial.html

在一台主机上模拟6个节点来创建一个集群

在redis 5.0以上可以直接通过内置安装脚本创建集群,方便快捷,集群创建的脚本位于/redis-5.0.3/utils/create-cluster/下

redis的集群是无中心化的,写入数据时随机往哈希槽里写,超过一半的主master被连续关闭时(slave来不及接管master),即使它们有slave节点,整个集群也会被down掉,master数据的迁移实际上就是那一段哈希槽的迁移

本次主要演示的是通过手动的方法来创建集群:

cd /proc/sys/vm/

echo 1 > overcommit_memory ##当内存不够时不kill进程,放进swap交换分区里

cd 7001/

vim redis.conf ##编辑一个配置文件

port 7001

cluster-enabled yes

cluster-config-file nodes.conf

cluster-node-timeout 5000

appendonly yes ##以追加的方式把命令保存在日志里

daemonize yes ##打入后台运行

每个目录以这个为模板,只修改端口号即可

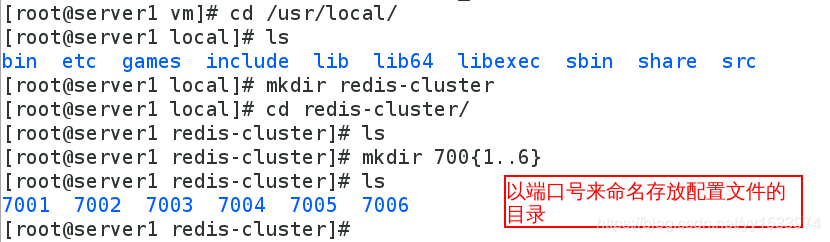

redis-server ./redis.conf ##启动服务

ps -ef ##查看进程是否启动

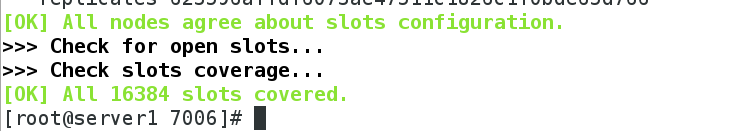

redis-cli --cluster create 127.0.0.1:7001 127.0.0.1:7002 127.0.0.1:7003 127.0.0.1:7004 127.0.0.1:7005 \

127.0.0.1:7006 --cluster-replicas 1

##创建集群,1表示一个master有一个从节点

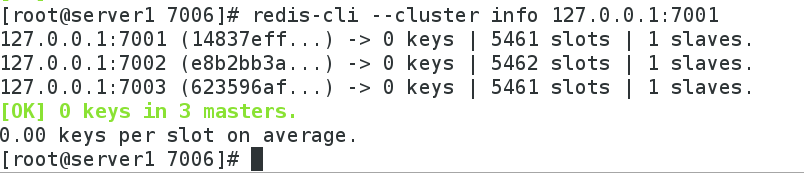

redis-cli --cluster info 127.0.0.1:7001 ##随便查看一个节点节可以看到所有节点的信息

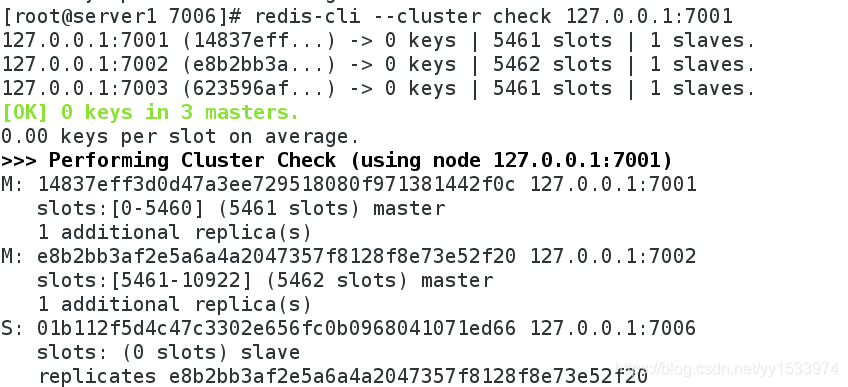

redis-cli --cluster check 127.0.0.1:7001 ##比info显示的信息更多,更完整,可以看到哈希槽的分布

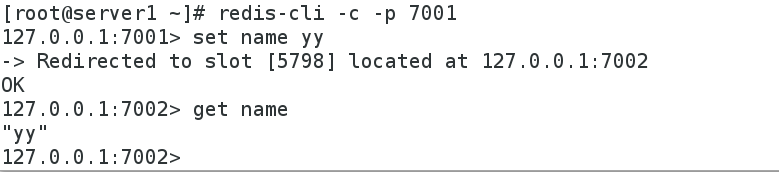

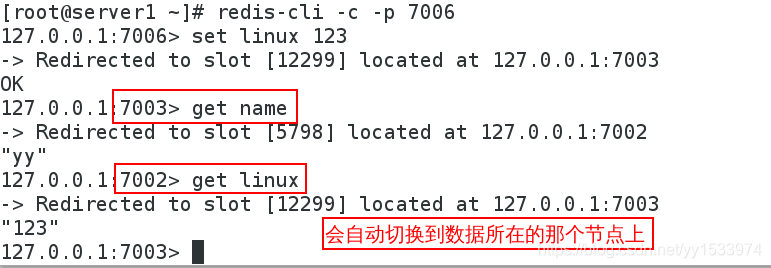

在集群中存入数据测试:

redis-cli -c -p 7001 ##-c开启集群模式,-p指定端口,虽然我们在7001上,但是存入的数据在7002,当我们查看数据时会自动切换到7002

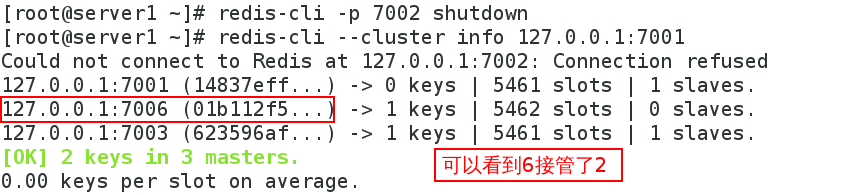

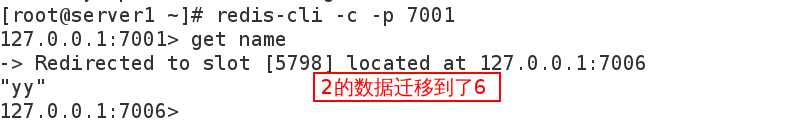

关掉存入数据的7002来查看数据的迁移

注意:如果一个集群中连续宕掉半数以上的master,即使他们有slave节点,也会因为时间太短slave来不及接管数据,使整个集群都宕掉

redis-server /usr/local/redis-cluster/7002/redis.conf ##重新启动server2

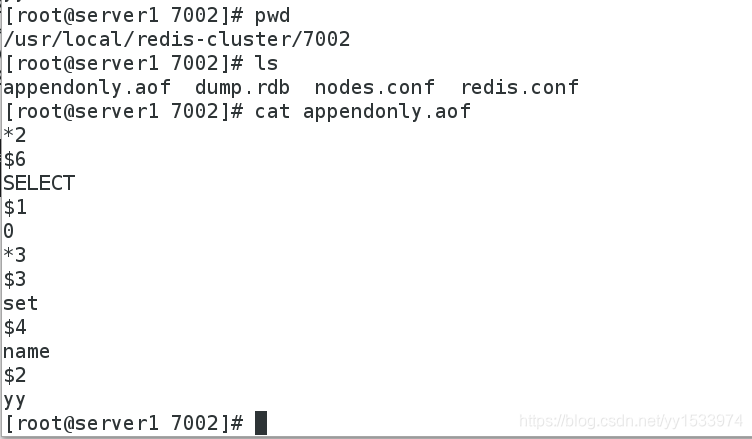

在appendonly.aof中,通过aof持久化,把命令都追加在文件里

三、redis与mysql搭配使用的读写分离

在本次实验中,客户端写入的数据都存储在mariadb数据库中,但是客户端读数据是通过redis来实现的

1.环境准备

server1: 安装php来访问

server2:redis读缓存

server3:mysql写入数据

2.服务的实现

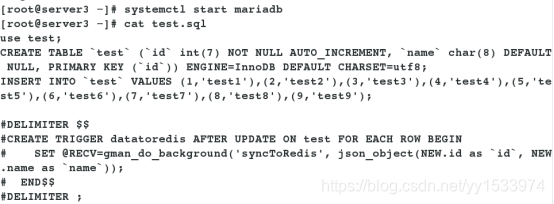

server3的配置:

yum install mariadb ##首先安装数据库服务

systemctl start mariadb ##开启数据库服务

注意:因为我们要用test库来测试,所以我们不做安全初始化

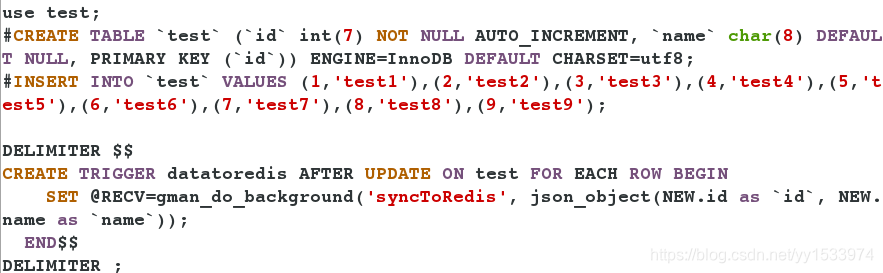

将测试库里导入文件来查看,文件内容如下

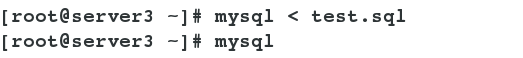

mysql < test.sql

mysql ##进入数据库查看我们导入的文件

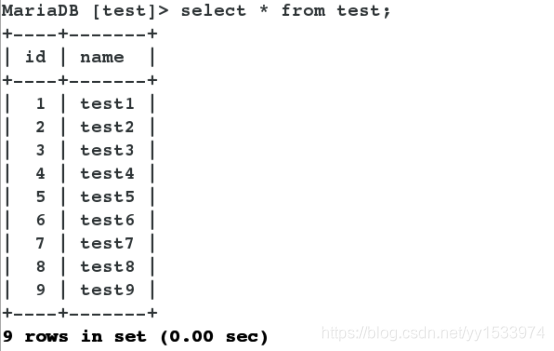

> use test;

> select * from test;

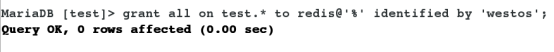

> grant all on test.* to redis@'%' identified by 'westos'; ##给redis用户赋予对test库的操作哦权限

server1的配置:

yum install httpd php php-mysql -y

systemctl start httpd

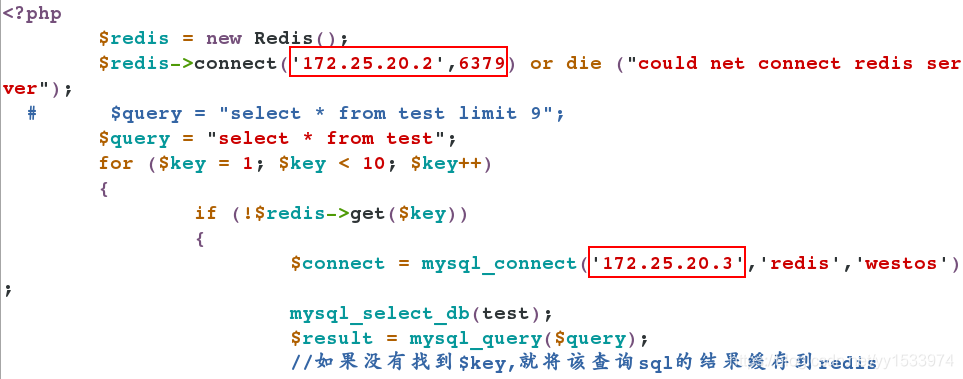

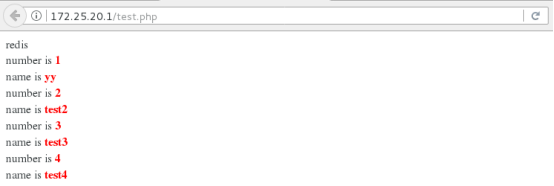

找一个php文件的模板放到默认发布目录下测试,注意自己mysql服务器的ip和redis服务器的ip

vim /var/www/html/test.php

<?php

$redis = new Redis();

$redis->connect('172.25.20.2',6379) or die ("could net connect redis server");

# $query = "select * from test limit 9";

$query = "select * from test";

for ($key = 1; $key < 10; $key++)

{

if (!$redis->get($key))

{

$connect = mysql_connect('172.25.20.3','redis','westos');

mysql_select_db(test);

$result = mysql_query($query);

//如果没有找到$key,就将该查询sql的结果缓存到redis

while ($row = mysql_fetch_assoc($result))

{

$redis->set($row['id'],$row['name']);

}

$myserver = 'mysql';

break;

}

else

{

$myserver = "redis";

$data[$key] = $redis->get($key);

}

}

echo $myserver;

echo "<br>";

for ($key = 1; $key < 10; $key++)

{

echo "number is <b><font color=#FF0000>$key</font></b>";

echo "<br>";

echo "name is <b><font color=#FF0000>$data[$key]</font></b>";

echo "<br>";

}

?>

加载php模块

php -m #查看所有

php -m | grep mysql #与mysql相关的,有3个

php -m | grep redis #与redis相关的,不存在,所以我们需要下载redis的php模块

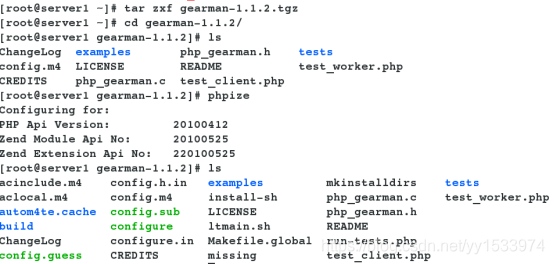

获取一个phpredis-master.zip

unzip phpredis-master.zip

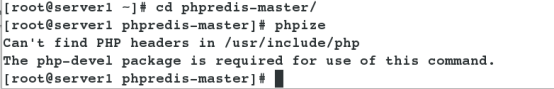

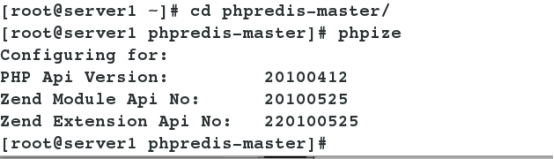

cd phpredis-master

phpize ##这个时候会报错,因为我们缺少依赖

yum install php-devel -y ##安转所需依赖后再试

注意:phpize是一个可运行脚本,主要作用是检测php的环境还有就是在特定的目录生成相应的configure文件,这样make install之后,生成的.so文件才会自动加载到php扩展目录下面。

./configure --enable-redis ##生成makefile时添加允许redis参数

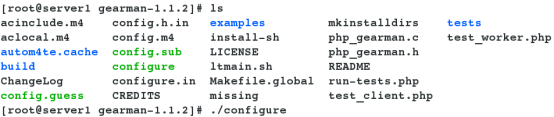

make && make install ##编译安装

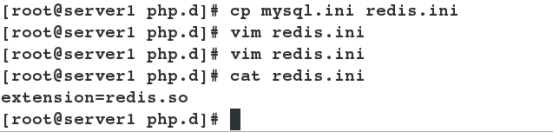

cd /etc/php.d/

cp mysql.ini redis.ini ##生成redis的文件,并写入redis的.so

vim redis.ini

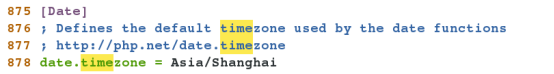

vim /etc/php.ini ##修改时区

在浏览器上访问测试:

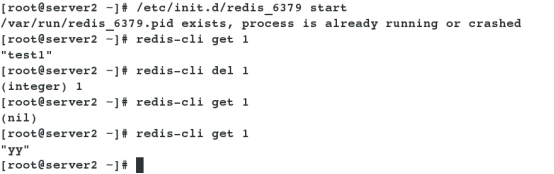

但是现在数据是不同步的,比如我们在mysql上修改一个数据,通过redis读取数据时它读的还是本地的缓存,把缓存删除掉才会看到修改后的信息

在server3上修改数据:

mysql

> use test;

> update test set name='yy' where id='1';

在server2上查看redis的数据测试

3.redis与mysql数据不同步的解决方法

我们这里利用Gearman这个工具,让mysql中数据有更新时,主动触发redis进行同步。

redis只有在他的数据过期或没有缓存的时侯才会去找mysql拿数据,所以我们希望在mysql有update操作后,会自动的触发redisserver。

数据流向:job(mysql trigger) mysql-gearman ----> gearman server ----> worker(php-gearman、php-redis、 set)

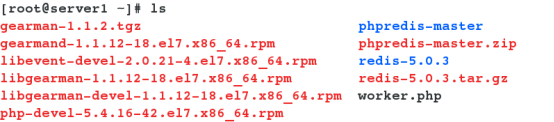

首先获取gearman软件包,同时它还有相应的依赖

本次实验所用软件版本如下,下载到同一个目录后,直接yum install *.rpm 即可

开启gearman服务,查看所用端口为4730

systemctl start gearmand

netstat -antlp

编写gearman的worker端。修改worker.php文件,将redis的ip改为我们redis服务器的ip

vim worker.php

<?php

$worker = new GearmanWorker();

$worker->addServer();

$worker->addFunction('syncToRedis', 'syncToRedis');

$redis = new Redis();

$redis->connect('172.25.20.2', 6379);

while($worker->work());

function syncToRedis($job)

{

global $redis;

$workString = $job->workload();

$work = json_decode($workString);

if(!isset($work->id)){

return false;

}

$redis->set($work->id, $work->name);

##这条语句就是将 id 作 KEY 和name 作 VALUE 分开存储,需要和前面写的 php 测试代码的存取一致。

}

?>

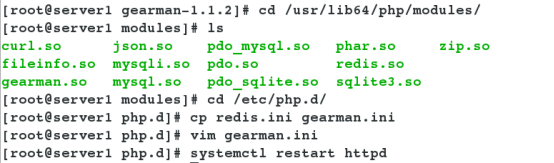

php -m | grep gearman ##查看gearman的php组件是否生效

下载php的gearman扩展,解压,并进行phpize。

直接./configure即可,不用添加参数

cd /etc/php.d/

cp redis.ini gearman.ini ##把gearman.so写入gearman.ini

systemctl restart httpd ##重启服务,因为gearman

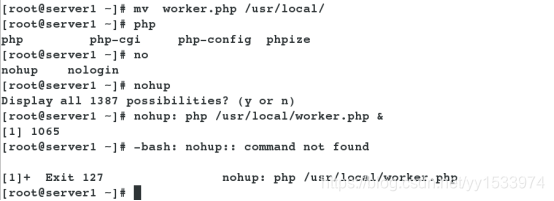

将修改后的php文件移至/usr/local下,用php以静默的模式运行

mv worker.php /usr/local/

nohup php /usr/local/worker.php & #后台运行worker

ps ax

注意:我们这里把gearman server和处理job的gearman worker放在同一台主机了,实际生产环境中是分离的。

(2)server3的数据库配置

首先修改之前的test.sql文件,然后再次把文件导入mysql

mysql < test.sql

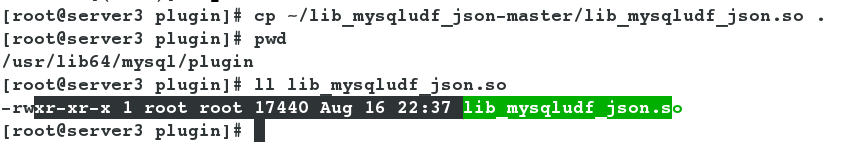

可以发现我们导入失败了,因为我们缺少了lib_mysqludf_json。lib_mysqludf_json UDF库函数将关系数据映射成json格式,通常,数据库中的数据映射成json格式是通过程序来转换的。(因为mysql与redis的数据类型不同所以必须转换为json标准数据类型。)

yum install gcc -y

yum install mysql-devel -y #安装所需依赖

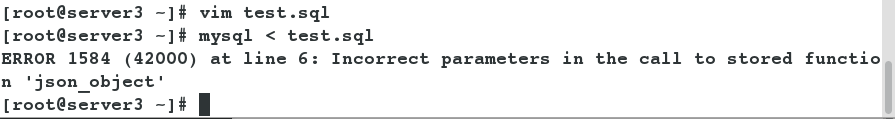

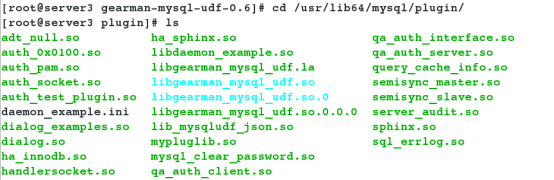

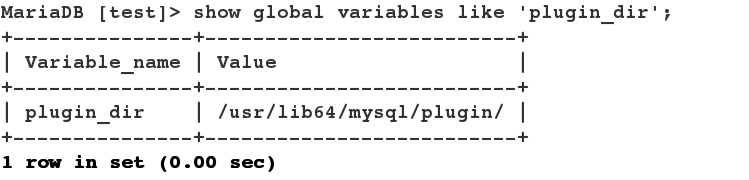

此时,我们查看mysql的模块目录

MariaDB [(none)]> show global variables like 'plugin_dir';

##这个路径我们可以在mysql中查询得知

cp ~/lib_mysqludf_json-master/lib_mysqludf_json.so /usr/lib64/mysql/plugin/

ll lib_mysqludf_json.so

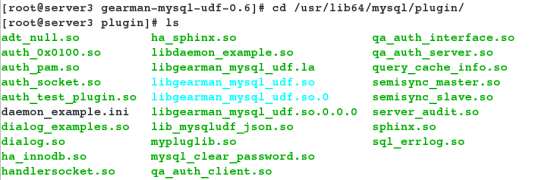

安装gearman-mysql-udf,这个插件用来管理调用gearman的分布式的队列。

本机使用的版本是gearman-mysql-udf-0.6.tar.gz

tar zxf gearman-mysql-udf-0.6.tar.gz

cd gearman-mysql-udf-0.6

yum install -y gearmand-1.1.12-18.el7.x86_64.rpm libgearman-1.1.12-18.el7.x86_64.rpm \

libgearman-devel-1.1.12-18.el7.x86_64.rpm libevent-devel-2.0.21-4.el7.x86_64.rpm

##与server1安装时需要的依赖相同

./configure --with-mysql --libdir=/usr/lib64/mysql/plugin

make && make install ##编译安装

此时模块目录下出现了我们安装的gearman_mysql_udf的模块。

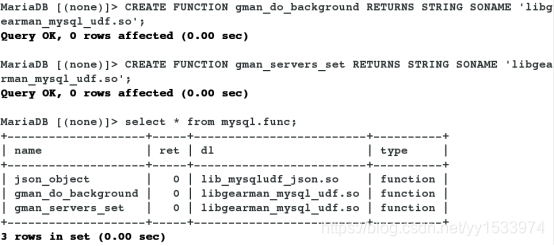

注册并查看UDF函数。

指定gearman服务的信息,这里gearman服务器为server1,端口为4730。

MariaDB [(none)]> SELECT gman_servers_set('172.25.20.1:4730');

再次导入数据库测试:

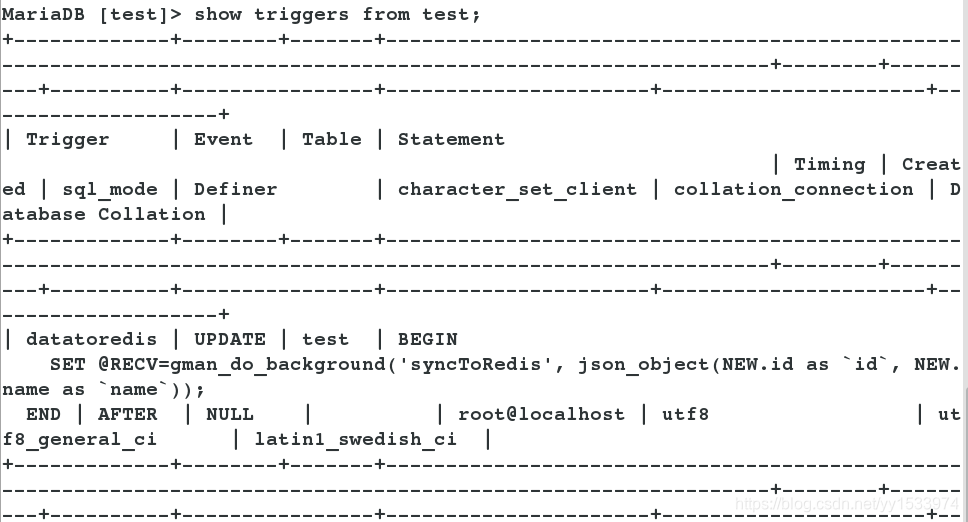

mysql < test.sql

MariaDB [(none)]> SHOW TRIGGERS FROM test; #查看触发器

(3)测试

更新server3中mysql的数据,在浏览器上查看

mysql

MariaDB [test]> update test set name='test1' where id='1'; ##把刚才修改的yy改回test1

智能推荐

达梦数据库的导出(备份)、导入_达梦数据库导入导出-程序员宅基地

文章浏览阅读2.9k次,点赞3次,收藏10次。偶尔会用到,记录、分享。1. 数据库导出1.1 切换到dmdba用户su - dmdba1.2 进入达梦数据库安装路径的bin目录,执行导库操作 导出语句:./dexp cwy_init/[email protected]:5236 file=cwy_init.dmp log=cwy_init_exp.log 注释: cwy_init/init_123..._达梦数据库导入导出

js引入kindeditor富文本编辑器的使用_kindeditor.js-程序员宅基地

文章浏览阅读1.9k次。1. 在官网上下载KindEditor文件,可以删掉不需要要到的jsp,asp,asp.net和php文件夹。接着把文件夹放到项目文件目录下。2. 修改html文件,在页面引入js文件:<script type="text/javascript" src="./kindeditor/kindeditor-all.js"></script><script type="text/javascript" src="./kindeditor/lang/zh-CN.js"_kindeditor.js

STM32学习过程记录11——基于STM32G431CBU6硬件SPI+DMA的高效WS2812B控制方法-程序员宅基地

文章浏览阅读2.3k次,点赞6次,收藏14次。SPI的详情简介不必赘述。假设我们通过SPI发送0xAA,我们的数据线就会变为10101010,通过修改不同的内容,即可修改SPI中0和1的持续时间。比如0xF0即为前半周期为高电平,后半周期为低电平的状态。在SPI的通信模式中,CPHA配置会影响该实验,下图展示了不同采样位置的SPI时序图[1]。CPOL = 0,CPHA = 1:CLK空闲状态 = 低电平,数据在下降沿采样,并在上升沿移出CPOL = 0,CPHA = 0:CLK空闲状态 = 低电平,数据在上升沿采样,并在下降沿移出。_stm32g431cbu6

计算机网络-数据链路层_接收方收到链路层数据后,使用crc检验后,余数为0,说明链路层的传输时可靠传输-程序员宅基地

文章浏览阅读1.2k次,点赞2次,收藏8次。数据链路层习题自测问题1.数据链路(即逻辑链路)与链路(即物理链路)有何区别?“电路接通了”与”数据链路接通了”的区别何在?2.数据链路层中的链路控制包括哪些功能?试讨论数据链路层做成可靠的链路层有哪些优点和缺点。3.网络适配器的作用是什么?网络适配器工作在哪一层?4.数据链路层的三个基本问题(帧定界、透明传输和差错检测)为什么都必须加以解决?5.如果在数据链路层不进行帧定界,会发生什么问题?6.PPP协议的主要特点是什么?为什么PPP不使用帧的编号?PPP适用于什么情况?为什么PPP协议不_接收方收到链路层数据后,使用crc检验后,余数为0,说明链路层的传输时可靠传输

软件测试工程师移民加拿大_无证移民,未受过软件工程师的教育(第1部分)-程序员宅基地

文章浏览阅读587次。软件测试工程师移民加拿大 无证移民,未受过软件工程师的教育(第1部分) (Undocumented Immigrant With No Education to Software Engineer(Part 1))Before I start, I want you to please bear with me on the way I write, I have very little gen...

深度神经网络在训练初期的“梯度消失”或“梯度爆炸”的问题解决:数据标准化(Data Standardization),权重初始化(Weight Initialization),Dropout正则化等_在人工神经网络研究的初始阶段,辛顿针对训练过程中常出现的梯度消失现象, 提供相-程序员宅基地

文章浏览阅读101次。1986年,深度学习(Deep Learning)火爆,它提出了一个名为“深层神经网络”(Deep Neural Networks)的新型机器学习模型。随后几年,神经网络在图像、文本等领域取得了惊艳成果。但是,随着深度学习的应用范围越来越广泛,神经网络在遇到新的任务时出现性能下降或退化的问题。这主要是由于深度神经网络在训练初期面临着“梯度消失”或“梯度爆炸”的问题。_在人工神经网络研究的初始阶段,辛顿针对训练过程中常出现的梯度消失现象, 提供相

随便推点

C++如何做字符串分割(5种方法)_c++ 字符串分割-程序员宅基地

文章浏览阅读10w+次,点赞93次,收藏352次。1、用strtok函数进行字符串分割原型: char *strtok(char *str, const char *delim);功能:分解字符串为一组字符串。参数说明:str为要分解的字符串,delim为分隔符字符串。返回值:从str开头开始的一个个被分割的串。当没有被分割的串时则返回NULL。其它:strtok函数线程不安全,可以使用strtok_r替代。示例://借助strtok实现split#include <string.h>#include <stdio.h&_c++ 字符串分割

2013第四届蓝桥杯 C/C++本科A组 真题答案解析_2013年第四届c a组蓝桥杯省赛真题解答-程序员宅基地

文章浏览阅读2.3k次。1 .高斯日记 大数学家高斯有个好习惯:无论如何都要记日记。他的日记有个与众不同的地方,他从不注明年月日,而是用一个整数代替,比如:4210后来人们知道,那个整数就是日期,它表示那一天是高斯出生后的第几天。这或许也是个好习惯,它时时刻刻提醒着主人:日子又过去一天,还有多少时光可以用于浪费呢?高斯出生于:1777年4月30日。在高斯发现的一个重要定理的日记_2013年第四届c a组蓝桥杯省赛真题解答

基于供需算法优化的核极限学习机(KELM)分类算法-程序员宅基地

文章浏览阅读851次,点赞17次,收藏22次。摘要:本文利用供需算法对核极限学习机(KELM)进行优化,并用于分类。

metasploitable2渗透测试_metasploitable2怎么进入-程序员宅基地

文章浏览阅读1.1k次。一、系统弱密码登录1、在kali上执行命令行telnet 192.168.26.1292、Login和password都输入msfadmin3、登录成功,进入系统4、测试如下:二、MySQL弱密码登录:1、在kali上执行mysql –h 192.168.26.129 –u root2、登录成功,进入MySQL系统3、测试效果:三、PostgreSQL弱密码登录1、在Kali上执行psql -h 192.168.26.129 –U post..._metasploitable2怎么进入

Python学习之路:从入门到精通的指南_python人工智能开发从入门到精通pdf-程序员宅基地

文章浏览阅读257次。本文将为初学者提供Python学习的详细指南,从Python的历史、基础语法和数据类型到面向对象编程、模块和库的使用。通过本文,您将能够掌握Python编程的核心概念,为今后的编程学习和实践打下坚实基础。_python人工智能开发从入门到精通pdf

vscode打开markdown文件 不显示图片 预览markdown文件_vscodemarkdown图片无法显示-程序员宅基地

文章浏览阅读3.2k次,点赞3次,收藏4次。vscode打开markdown文件 不显示图片 预览markdown文件_vscodemarkdown图片无法显示