hadoop mapreduce java 单词统计三个实现方法_hadoop数据分块单词被分开怎么统计-程序员宅基地

技术标签: mapreduce hadoop mapreduce 单词统计 大数据

hadoop MapReduce框架可以让你的应用在集群中:可靠地、容错地、并行、处理TB级别的数据。

本实例通过idea运行java本地代码,实现统计单词计数。

hadoop集群搭建见 hadoop基于zookeper自动高可用搭建。这里就不在重复赘述。

1 统计文件准备

1.1 创建需要统计单词的文件

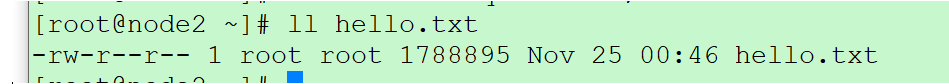

任意选择一条服务器,创建包含hello world number hello.txt文件

for i in `seq 100000`;do echo hello world $i >hello.txt ;done;

1.2 上传到hdfs文件系统上

创建目录 /home/root

hdfs dfs -mkdir /home

hdfs dfs -mkdir /home/root

查看是否创建成功

hdfs dfs -ls /home

上传文件到hdfs服务器上

设置块大小为1MB

hdfs dfs -D dfs.blocksize=1048576 -put hello.txt /home/root

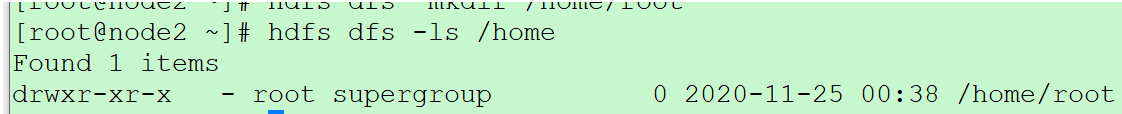

通过前台页面:node2:50070 可以看到上传文件被分为2个块 ,存放在node3和node4上

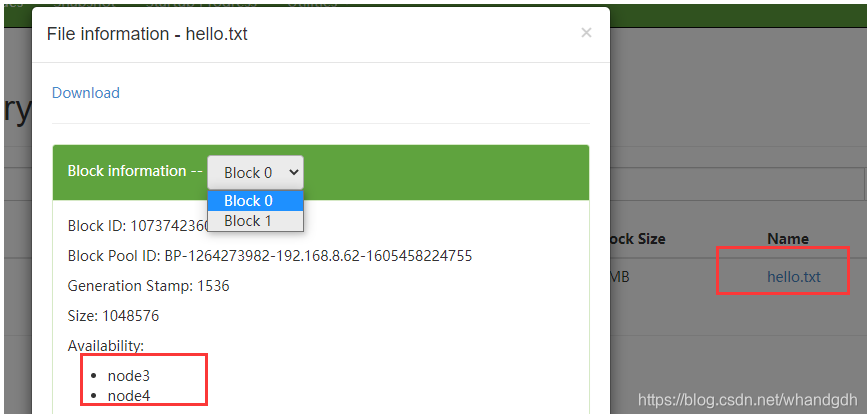

2 创建java项目

结构如下:

2.1 配置文件

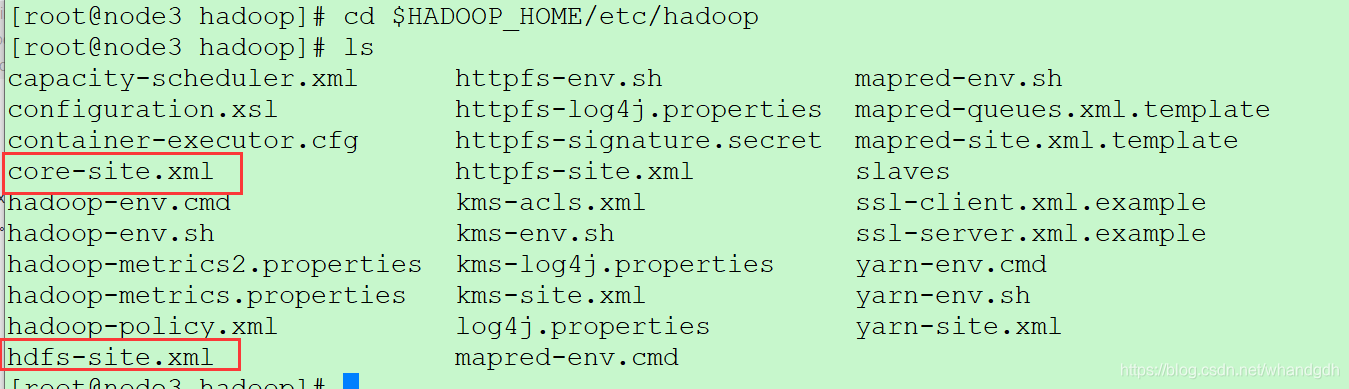

conf目录下配置文件core-site.xml和hdfs-site.xml文件来在hadoop集群服务器上,路径为HADOOP_HOME/etc/hadoop。将此文件拷贝到本地java工程即可

cd $HADOOP_HOME/etc/hadoop

2.2 java代码

2.2.1 WordCountMapper 类

WordCountMapper 类需要重写map方法,代码如下:

ublic class WordCountMapper extends Mapper<LongWritable,Text,Text,IntWritable> {

@Override

protected void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

// key value

// <0, "hello world 1">

// "hello bjsxt 1" 输出到reduce

String line=value.toString();

String [] words=line.split(" ");

for (int i = 0; i < words.length-1; i++) {

//排除最后一位数字

context.write(new Text(words[i]),new IntWritable(1));

}

}

}

2.2.2WordCountReducer 类

WordCountReducer 类需要重写reduce方法。代码如下

public class WordCountReducer extends Reducer<Text,IntWritable,Text,IntWritable> {

// <"hello", 1>

// <"hello", 1>

// key "hello", {

1,1,1,1,1,1,1,1,1,1,1,1} reducer 处理前结果

@Override

protected void reduce(Text key, Iterable<IntWritable> values, Context context) throws IOException, InterruptedException {

int sum=0;

for (IntWritable value : values) {

sum+=value.get();

}

// 输出结果为 <hello ,120>

context.write(key,new IntWritable(sum));

}

}

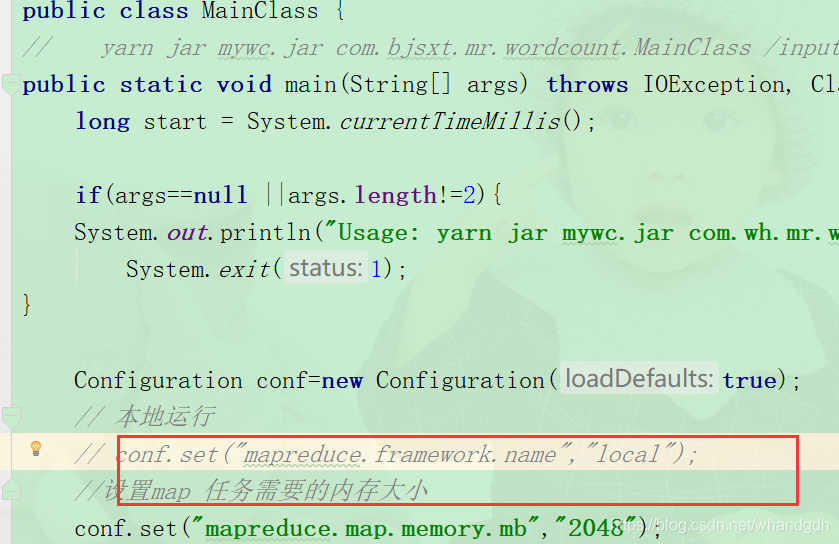

2.2.3 MainClass 类

MainClass类为本地运行类,代码如下:

//客户端运行

public class MainClass {

// yarn jar mywc.jar com.bjsxt.mr.wordcount.MainClass /input /output

public static void main(String[] args) throws IOException, ClassNotFoundException, InterruptedException {

long start = System.currentTimeMillis();

if(args==null ||args.length!=2){

System.out.println("Usage: yarn jar mywc.jar com.wh.mr.wordcount.MainClass <inpath> <outpath>");

System.exit(1);

}

Configuration conf=new Configuration(true);

// 本地运行

conf.set("mapreduce.framework.name","local");

// 创建mapreduce作业Job对象

Job job=Job.getInstance(conf);

// 设置作业的名称

job.setJobName("单次计数");

// 设置作业的主入口类

job.setJarByClass(MainClass.class);

// 设置输入文件路径,该方法可以调用多次,用于设置多个输入文件路径

FileInputFormat.addInputPath(job,new Path(args[0]));

// 设置输出文件路径

FileOutputFormat.setOutputPath(job,new Path(args[1]));

// 设置mapper类

job.setMapperClass(WordCountMapper.class);

// 设置reducer类

job.setReducerClass(WordCountReducer.class);

// 设置mapper输出key的类型,用于排序

job.setMapOutputKeyClass(Text.class);

// 设置mapper输出value的类型

job.setMapOutputValueClass(IntWritable.class);

// 提交作业到集群运行,并等待程序在集群中运行结束

job.waitForCompletion(true);

long end = System.currentTimeMillis();

long cost = end - start;

System.out.println("耗时:"+cost);

}

}

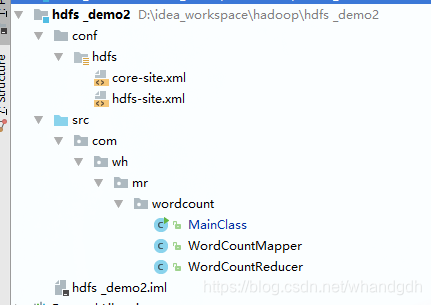

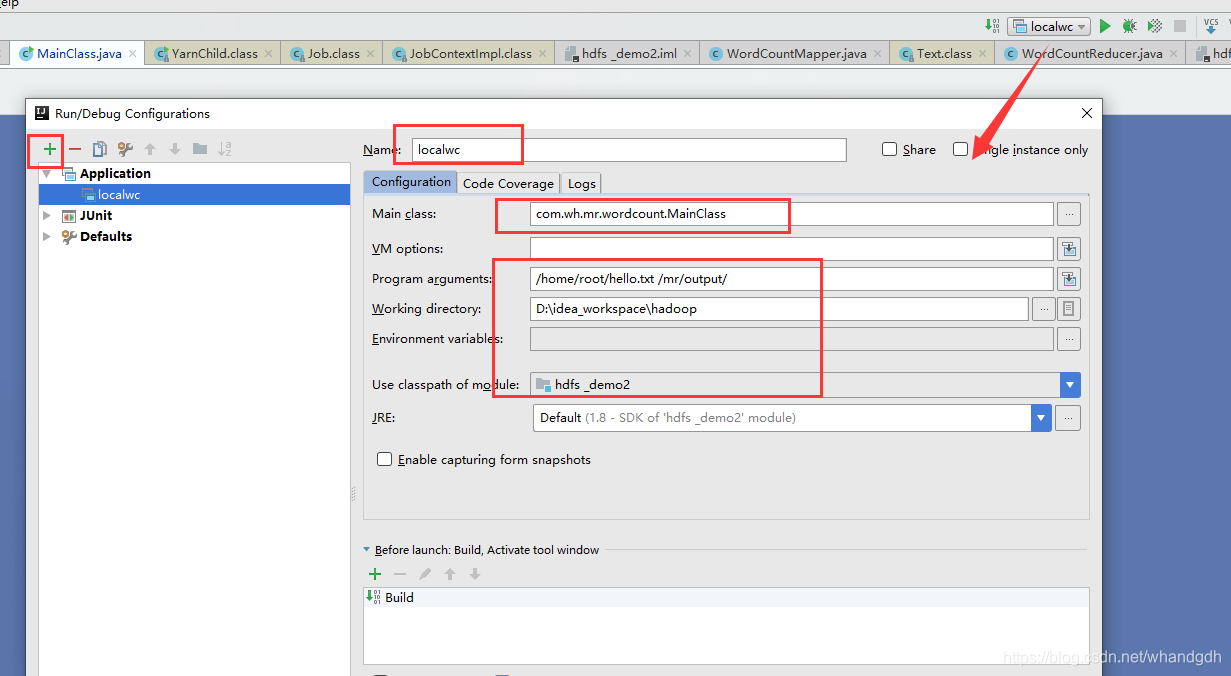

3 参数设置

需要从main方法传入需要处理的文件以及输出结果目录,设置如下图所示

需要注意的是 program arguments参数设置需要处理的文件以及处理结果路径。结果处理存放路径不能是存在的,不然程序会抛异常

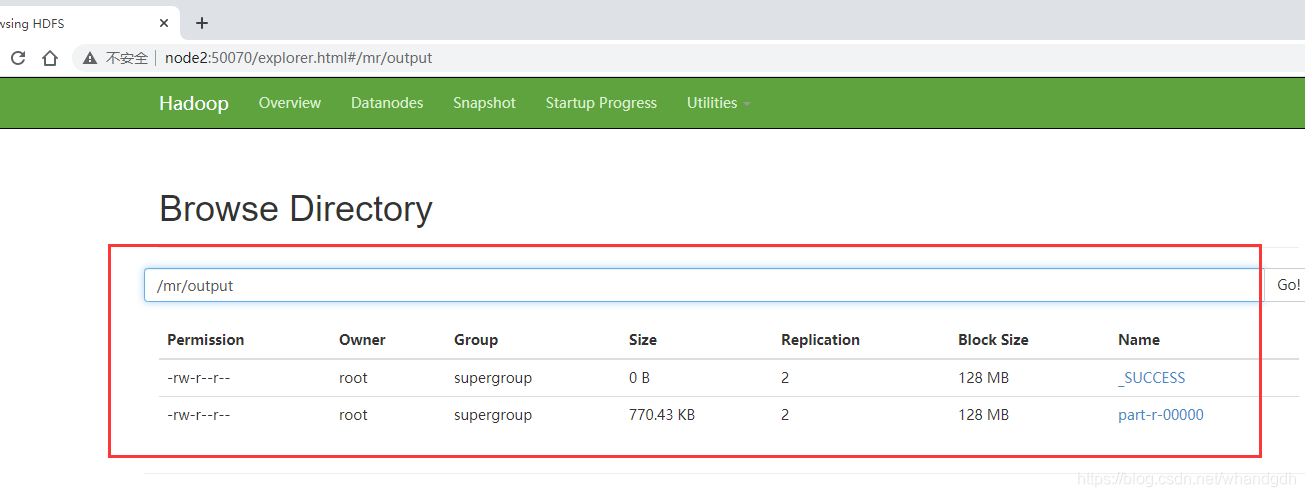

4 运行结果

运行程序以后,通过页面node2:50070进入文件管理可以看到执行结果

存放到/mr/output目录下

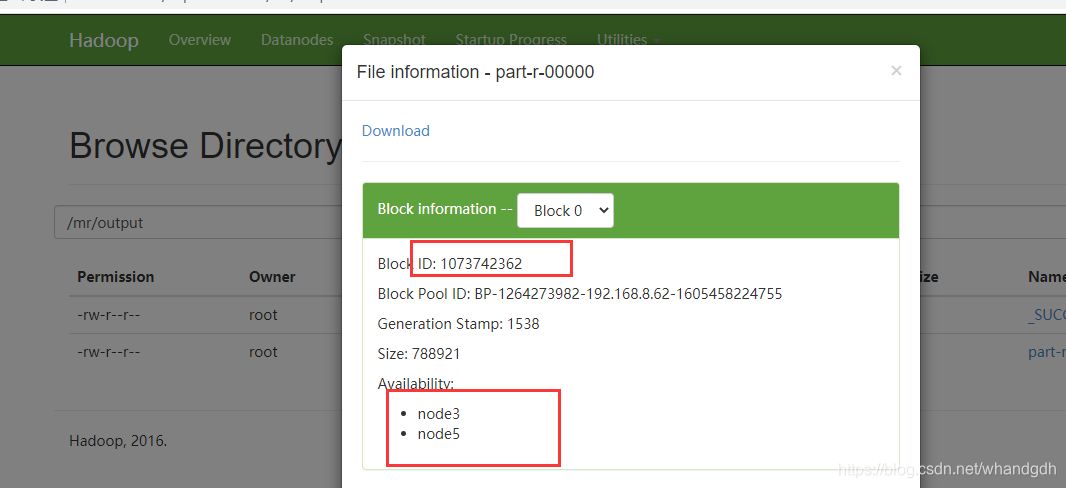

执行结果写入到 part-r-00000文件中,该文件块id为1073742362。

写入到node3和node5上

node3和node5任意选一台,本实例选择node5.

进入数据存放目录。

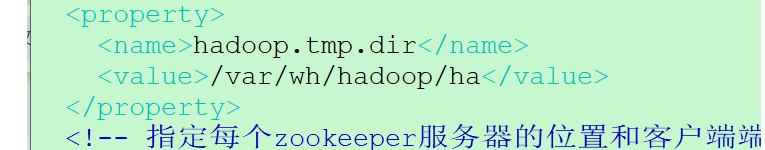

core-site.xml(cd $HADOOP_HOME/etc/hadoop)这个配置文件

/var/wh/hadoop/ha

进入如下路径

var/wh/hadoop/ha/dfs/data/current/BP-1264273982-192.168.8.62-1605458224755/current/finalized/subdir0

进入后有三个文件

查找执行结果文件存放目录

find . -name '*1073742362*'

看到 文件存放在 subdir2下

vim blk_1073742362

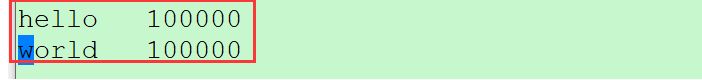

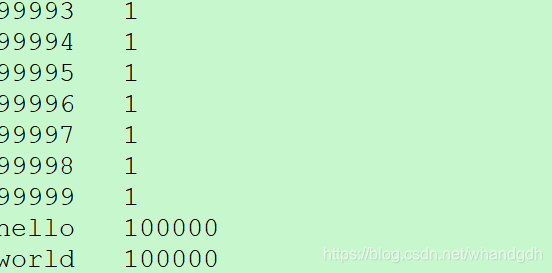

看到 统计hello 和world 个数都为10w个

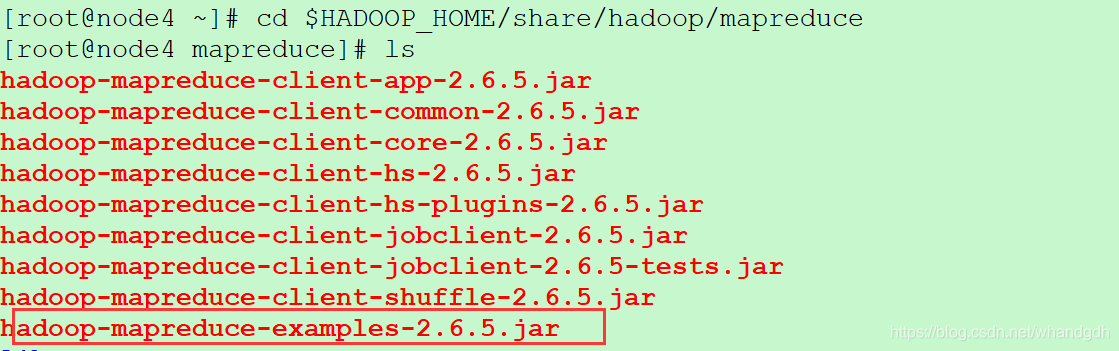

5 服务器运行本地单词计数程序

hadoop自带有单词统计程序,在 $HADOOP_HOME/share/hadoop/mapreduce目录下

cd $HADOOP_HOME/share/hadoop/mapreduce

ls

在这里插入图片描述

然后执行

hadoop jar hadoop-mapreduce-examples-2.6.5.jar wordcount /home/root/hello.txt /mr/wordcount/output

*ouput:是hdfs中不存在的目录,mr程序运行的结果会输出到该目录

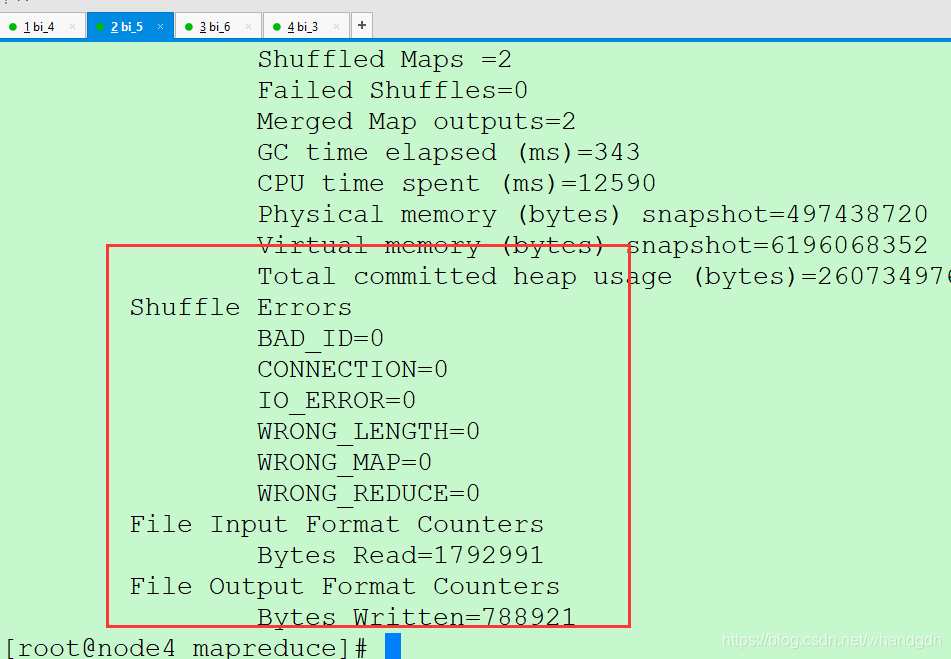

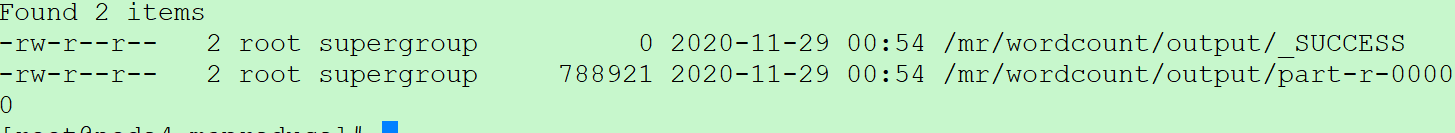

执行结果

hdfs dfs -ls /mr/wordcount/output

结果存放在part-r-00000文件上

再通过如下命令查看结果

hdfs dfs -cat /mr/wordcount/output/part-r-00000

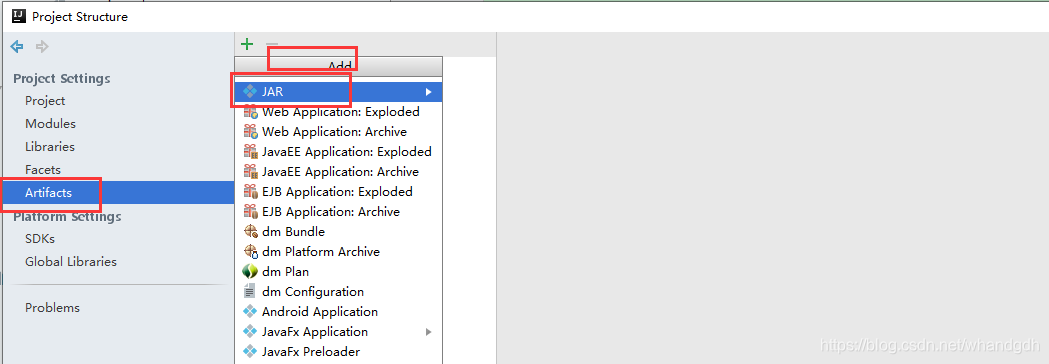

6 打包本地java代码到服务器执行

还可以将本地的java代码打包到服务器执行,只是需要将mainclass文件中设置本地运行代码注释掉

conf.set("mapreduce.framework.name","local");

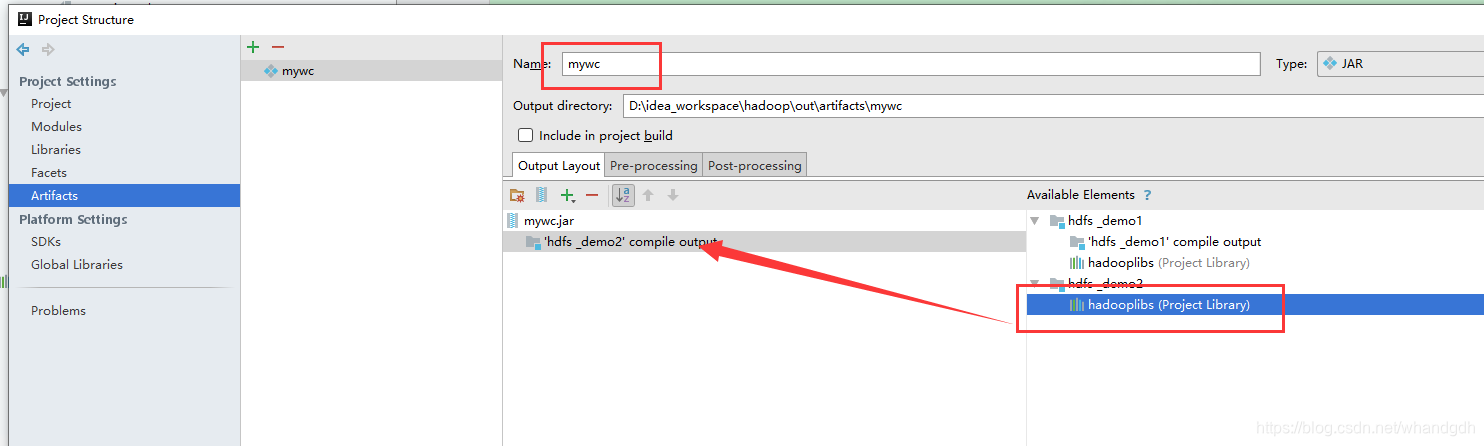

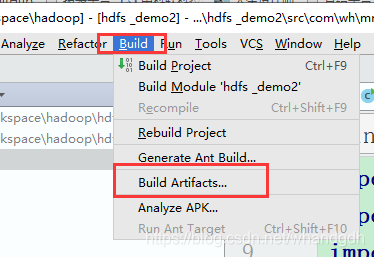

打包页面如下

进入到打包目录找到包文件

D:\idea_workspace\hadoop\out\artifacts\mywc

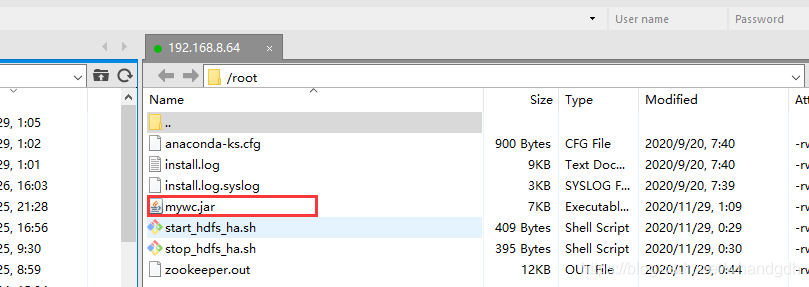

上传代码到服务器上,

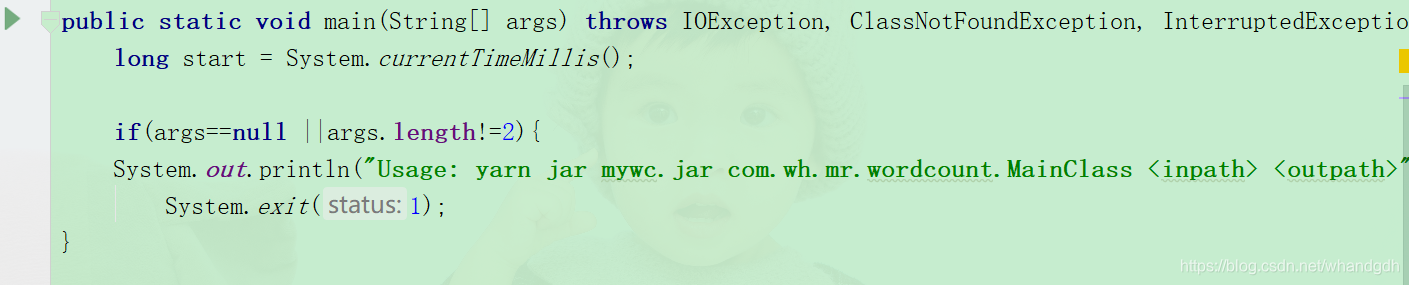

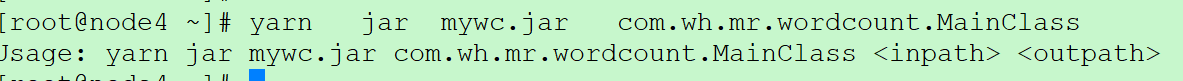

如果没有传参数运行

yarn jar mywc.jar com.wh.mr.wordcount.MainClass

可以看到这里运行结果按照java代码中进行退出。

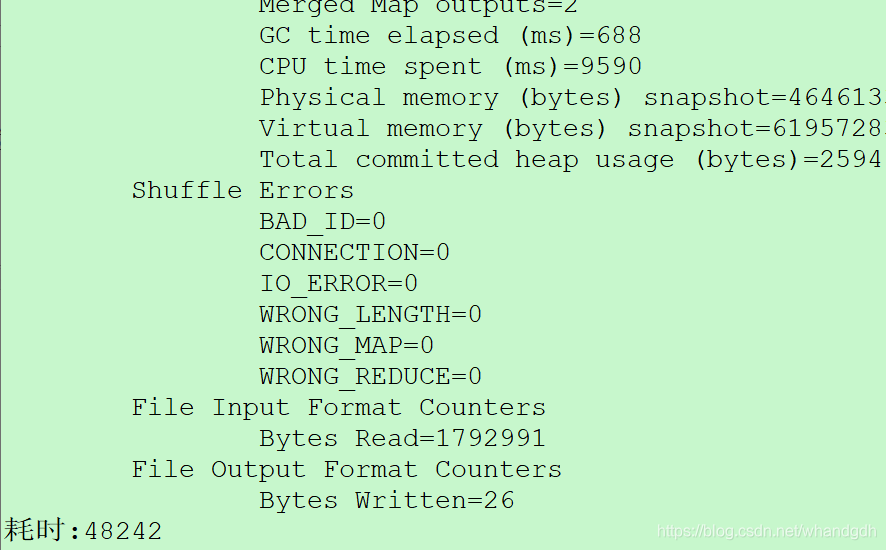

yarn jar mywc.jar com.wh.mr.wordcount.MainClass /home/root/hello.txt /mr/wordcount/output2

运行结果

智能推荐

51单片机的中断系统_51单片机中断篇-程序员宅基地

文章浏览阅读3.3k次,点赞7次,收藏39次。CPU 执行现行程序的过程中,出现某些急需处理的异常情况或特殊请求,CPU暂时中止现行程序,而转去对异常情况或特殊请求进行处理,处理完毕后再返回现行程序断点处,继续执行原程序。void 函数名(void) interrupt n using m {中断函数内容 //尽量精简 }编译器会把该函数转化为中断函数,表示中断源编号为n,中断源对应一个中断入口地址,而中断入口地址的内容为跳转指令,转入本函数。using m用于指定本函数内部使用的工作寄存器组,m取值为0~3。该修饰符可省略,由编译器自动分配。_51单片机中断篇

oracle项目经验求职,网络工程师简历中的项目经验怎么写-程序员宅基地

文章浏览阅读396次。项目经验(案例一)项目时间:2009-10 - 2009-12项目名称:中驰别克信息化管理整改完善项目描述:项目介绍一,建立中驰别克硬件档案(PC,服务器,网络设备,办公设备等)二,建立中驰别克软件档案(每台PC安装的软件,财务,HR,OA,专用系统等)三,能过建立的档案对中驰别克信息化办公环境优化(合理使用ADSL宽带资源,对域进行调整,对文件服务器进行优化,对共享打印机进行调整)四,优化完成后..._网络工程师项目经历

LVS四层负载均衡集群-程序员宅基地

文章浏览阅读1k次,点赞31次,收藏30次。LVS:Linux Virtual Server,负载调度器,内核集成, 阿里的四层SLB(Server Load Balance)是基于LVS+keepalived实现。NATTUNDR优点端口转换WAN性能最好缺点性能瓶颈服务器支持隧道模式不支持跨网段真实服务器要求anyTunneling支持网络private(私网)LAN/WAN(私网/公网)LAN(私网)真实服务器数量High (100)High (100)真实服务器网关lvs内网地址。

「技术综述」一文道尽传统图像降噪方法_噪声很大的图片可以降噪吗-程序员宅基地

文章浏览阅读899次。https://www.toutiao.com/a6713171323893318151/作者 | 黄小邪/言有三编辑 | 黄小邪/言有三图像预处理算法的好坏直接关系到后续图像处理的效果,如图像分割、目标识别、边缘提取等,为了获取高质量的数字图像,很多时候都需要对图像进行降噪处理,尽可能的保持原始信息完整性(即主要特征)的同时,又能够去除信号中无用的信息。并且,降噪还引出了一..._噪声很大的图片可以降噪吗

Effective Java 【对于所有对象都通用的方法】第13条 谨慎地覆盖clone_为继承设计类有两种选择,但无论选择其中的-程序员宅基地

文章浏览阅读152次。目录谨慎地覆盖cloneCloneable接口并没有包含任何方法,那么它到底有什么作用呢?Object类中的clone()方法如何重写好一个clone()方法1.对于数组类型我可以采用clone()方法的递归2.如果对象是非数组,建议提供拷贝构造器(copy constructor)或者拷贝工厂(copy factory)3.如果为线程安全的类重写clone()方法4.如果为需要被继承的类重写clone()方法总结谨慎地覆盖cloneCloneable接口地目的是作为对象的一个mixin接口(详见第20_为继承设计类有两种选择,但无论选择其中的

毕业设计 基于协同过滤的电影推荐系统-程序员宅基地

文章浏览阅读958次,点赞21次,收藏24次。今天学长向大家分享一个毕业设计项目基于协同过滤的电影推荐系统项目运行效果:项目获取:https://gitee.com/assistant-a/project-sharing21世纪是信息化时代,随着信息技术和网络技术的发展,信息化已经渗透到人们日常生活的各个方面,人们可以随时随地浏览到海量信息,但是这些大量信息千差万别,需要费事费力的筛选、甄别自己喜欢或者感兴趣的数据。对网络电影服务来说,需要用到优秀的协同过滤推荐功能去辅助整个系统。系统基于Python技术,使用UML建模,采用Django框架组合进行设

随便推点

你想要的10G SFP+光模块大全都在这里-程序员宅基地

文章浏览阅读614次。10G SFP+光模块被广泛应用于10G以太网中,在下一代移动网络、固定接入网、城域网、以及数据中心等领域非常常见。下面易天光通信(ETU-LINK)就为大家一一盘点下10G SFP+光模块都有哪些吧。一、10G SFP+双纤光模块10G SFP+双纤光模块是一种常规的光模块,有两个LC光纤接口,传输距离最远可达100公里,常用的10G SFP+双纤光模块有10G SFP+ SR、10G SFP+ LR,其中10G SFP+ SR的传输距离为300米,10G SFP+ LR的传输距离为10公里。_10g sfp+

计算机毕业设计Node.js+Vue基于Web美食网站设计(程序+源码+LW+部署)_基于vue美食网站源码-程序员宅基地

文章浏览阅读239次。该项目含有源码、文档、程序、数据库、配套开发软件、软件安装教程。欢迎交流项目运行环境配置:项目技术:Express框架 + Node.js+ Vue 等等组成,B/S模式 +Vscode管理+前后端分离等等。环境需要1.运行环境:最好是Nodejs最新版,我们在这个版本上开发的。其他版本理论上也可以。2.开发环境:Vscode或HbuilderX都可以。推荐HbuilderX;3.mysql环境:建议是用5.7版本均可4.硬件环境:windows 7/8/10 1G内存以上;_基于vue美食网站源码

oldwain随便写@hexun-程序员宅基地

文章浏览阅读62次。oldwain随便写@hexun链接:http://oldwain.blog.hexun.com/ ...

渗透测试-SQL注入-SQLMap工具_sqlmap拖库-程序员宅基地

文章浏览阅读843次,点赞16次,收藏22次。用这个工具扫描其它网站时,要注意法律问题,同时也比较慢,所以我们以之前写的登录页面为例子扫描。_sqlmap拖库

origin三图合一_神教程:Origin也能玩转图片拼接组合排版-程序员宅基地

文章浏览阅读1.5w次,点赞5次,收藏38次。Origin也能玩转图片的拼接组合排版谭编(华南师范大学学报编辑部,广州 510631)通常,我们利用Origin软件能非常快捷地绘制出一张单独的绘图。但是,我们在论文的撰写过程中,经常需要将多种科学实验图片(电镜图、示意图、曲线图等)组合在一张图片中。大多数人都是采用PPT、Adobe Illustrator、CorelDraw等软件对多种不同类型的图进行拼接的。那么,利用Origin软件能否实..._origin怎么把三个图做到一张图上

51单片机智能电风扇控制系统proteus仿真设计( 仿真+程序+原理图+报告+讲解视频)_电风扇模拟控制系统设计-程序员宅基地

文章浏览阅读4.2k次,点赞4次,收藏51次。51单片机智能电风扇控制系统仿真设计( proteus仿真+程序+原理图+报告+讲解视频)仿真图proteus7.8及以上 程序编译器:keil 4/keil 5 编程语言:C语言 设计编号:S0042。_电风扇模拟控制系统设计