基于社会群体算法优化的广义回归神经网络(GRNN)预测-程序员宅基地

技术标签: 算法 机器学习 # 广义回归神经网络(GRNN) 神经网络 智能优化算法应用 回归

基于社会群体算法优化的广义回归神经网络(GRNN)预测

文章目录

摘要:本文介绍基于社会群体算法优化的广义神经网络(GRNN)预测,并将其应用于货物量预测

1.GRNN 神经网络概述

广义回归神经网络 CGRNN, Generalized Regression Neural Network)是美国学者 Don-aid F. Specht 在 1991 年提出的,它是径向基神经网络的一种。 GRNN 具有很强的非线性映射能力和柔性网络结构以及高度的容错性和鲁棒性,适用于解决非线性问题。 GRNN在逼近 能力和学习速度上较 RBF 网络有更强的优势,网络最后收敛于样本量积聚较多的优化回归 面,并且在样本数据较少时,预测效果也好。此外,网络还可以处理不稳定的数据。因此, GRNN 在信号过程、结构分析、教育产业、能源、食品科学、控制决策系统、药物设计、金融领域、生物工程等各个领域得到了广泛的应用 。

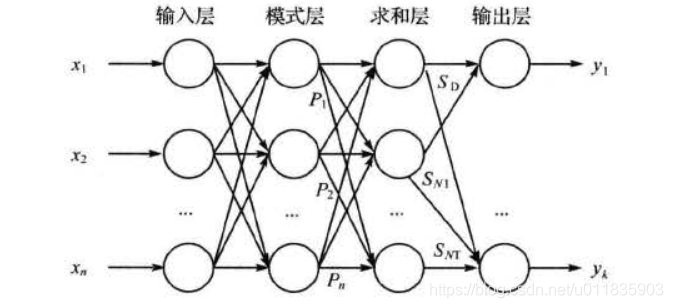

2.GRNN 的网络结构

GRNN 在结构上与 RBF 网络较为相似。它由四层构成,如图1所示,分别为输入层(input layer)、模式层( pattern layer)、求和层 ( summation layer)和输出层( output layer)。对 应网络输入 X = [ x 1 , x 2 , . . . , x n ] T X = [x_1,x_2,...,x_n]^T X=[x1,x2,...,xn]T,其输出为 Y = [ y 1 , y 2 , . . . , y n ] T Y = [y_1,y_2,...,y_n]^T Y=[y1,y2,...,yn]T 。

(1)输入层

输入层神经元的数目等于学习样本中输入向量的维数,各神经元是简单的分布单元,直接将输入变量传递给模式层。

(2)模式层

模式层神经元数目等于学习样本的数目 η ,各神经元对应不 同的样本,模式层神经元传递函数为:

p i = e x p [ − ( X − X i ) T ( X − X i ) 2 σ 2 ] i = 1 , 2 , . . . , n (1) p_i = exp[-\frac{(X-X_i)^T(X-X_i)}{2\sigma^2}] i =1,2,...,n \tag{1} pi=exp[−2σ2(X−Xi)T(X−Xi)]i=1,2,...,n(1)

神经元 i i i 的输出为输入变量与其对应的样本 X X X 之间 Euclid 距离平方的指数平方 D i 2 = ( X − X i ) T ( X − X i ) D_i^2= (X-X_i)^T(X-X_i ) Di2=(X−Xi)T(X−Xi) 的指数形式 。式中, X X X 为网络输入变量; X i X_i Xi 为第 i 个神经元对应的学习样本。

(3)求和层

求和层中使用两种类型神经元进行求和。

一类的计算公式为 ∑ i = 1 n e x p [ − ( X − X i ) T ( X − X i ) 2 σ 2 ] \sum_{i=1}^n exp[-\frac{(X-X_i)^T(X-X_i)}{2\sigma^2}] ∑i=1nexp[−2σ2(X−Xi)T(X−Xi)],它对所有模式层神经元的输出进行算术求和,其模式层与各神经元的连接权值为1 ,传递函数为:

S D = ∑ i = 1 n P i (2) S_D = \sum_{i=1}^nP_i\tag{2} SD=i=1∑nPi(2)

另 一类计算公式为 ∑ i = 1 n Y i e x p [ − ( X − X i ) T ( X − X i ) 2 σ 2 ] \sum_{i=1}^nY_i exp[-\frac{(X-X_i)^T(X-X_i)}{2\sigma^2}] ∑i=1nYiexp[−2σ2(X−Xi)T(X−Xi)],它对所有模式层的神经元进行加权求和,模式层中第 i 个神经元与求和层中第 j 个分子求和神经元之间的连接权值为第 i 个输 出样本 Y i Y_i Yi中的第 j 个元素,传递函数为:

S N j = ∑ i = 1 n y i j P i , j = 1 , 2 , . . . , k (3) S_{Nj} = \sum_{i=1}^n y_{ij}P_i ,j = 1,2,...,k\tag{3} SNj=i=1∑nyijPi,j=1,2,...,k(3)

(4)输出层

输出层中的神经元数目等于学习样本中输出向量的维数h ,各神经元将求和层的输出相除 , 神经元 j 的输出对应估计结果Y( X) 的第 j 个元素,即:

y j = S N j S D , j = 1 , 2 , . . . , k (4) y_j = \frac{S_{Nj}}{S_D},j=1,2,...,k \tag{4} yj=SDSNj,j=1,2,...,k(4)

3.GRNN的理论基础

广义回归神经网络的理论基础是非线性回归分析 , 非独立变量 Y 相对于独立变量x的回归分析实际上是计算具有最大概率值的 y. 设随机变量x和随机变量 y 的联合概率密度函数 为f(x,y),已知 x 的观测值为 X ,则 y 相对于 X 的回归,也即条件均值为:

KaTeX parse error: \tag works only in display equations

Y即为在输入为 X 的条件下,Y 的预测输出 。

应用 Parzen 非参数估计,可由样本数据集 x i , y i i = 1 n {x_i,y_i}_{i=1}^n xi,yii=1n估算密度函数 f ′ ( X , y ) f'(X,y) f′(X,y)

f ′ ( X , y ) = ∑ i = 1 n e x p [ − ( X − X i ) T ( X − X i ) 2 σ 2 ] e x p [ − ( X − Y i ) 2 2 σ 2 ] / ( n ( 2 π ) p + 1 2 σ p + 1 ) (6) f'(X,y) =\sum_{i=1}^n exp[-\frac{(X-X_i)^T(X-X_i)}{2\sigma^2}]exp[-\frac{(X-Y_i)^2}{2\sigma^2}]/(n(2\pi)^{\frac{p+1}{2}}\sigma^{p+1}) \tag{6} f′(X,y)=i=1∑nexp[−2σ2(X−Xi)T(X−Xi)]exp[−2σ2(X−Yi)2]/(n(2π)2p+1σp+1)(6)

式中, X i X_i Xi, Y i Y_i Yi, 为随机变量 x 和 y 的样本观测值; n n n为样本容量; p p p为随机变量 x x x的维数; σ σ σ为高斯函数的宽度系数,在此称为光滑因子。

用 f ( X , y ) f(X,y) f(X,y)代替 f ( X , y ) f(X,y) f(X,y)代人式,并交换积分与加和的顺序:

Y ( X ) = ∑ i = 1 n e x p [ − ( X − X i ) T ( X − X i ) 2 σ 2 ] ∫ − ∞ ∞ y e x p [ − ( Y − Y i ) 2 / ( 2 σ 2 ) ] d y ∑ i = 1 n e x p [ − ( X − X i ) T ( X − X i ) 2 σ 2 ] ∫ − ∞ ∞ e x p [ − ( Y − Y i ) 2 / ( 2 σ 2 ) ] d y (7) Y(X) = \frac{\sum_{i=1}^n exp[-\frac{(X-X_i)^T(X-X_i)}{2\sigma^2}]\int_{-\infty}^{\infty}yexp[-(Y-Y_i)^2/(2\sigma^2)]dy}{\sum_{i=1}^n exp[-\frac{(X-X_i)^T(X-X_i)}{2\sigma^2}]\int_{-\infty}^{\infty}exp[-(Y-Y_i)^2/(2\sigma^2)]dy}\tag{7} Y(X)=∑i=1nexp[−2σ2(X−Xi)T(X−Xi)]∫−∞∞exp[−(Y−Yi)2/(2σ2)]dy∑i=1nexp[−2σ2(X−Xi)T(X−Xi)]∫−∞∞yexp[−(Y−Yi)2/(2σ2)]dy(7)

由于 ∫ − ∞ ∞ z e − x 2 d z = 0 \int _{-\infty}^{\infty}ze^{-x^2}dz = 0 ∫−∞∞ze−x2dz=0,对两个积分进行计算后可得网络的输出Y(X)为:

Y ( X ) = ∑ i = 1 n Y i e x p [ − ( X − X i ) T ( X − X i ) 2 σ 2 ] ∑ i = 1 n e x p [ − ( X − X i ) T ( X − X i ) 2 σ 2 ] (8) Y(X) = \frac{\sum_{i=1}^nY_i exp[-\frac{(X-X_i)^T(X-X_i)}{2\sigma^2}]}{\sum_{i=1}^n exp[-\frac{(X-X_i)^T(X-X_i)}{2\sigma^2}]} \tag{8} Y(X)=∑i=1nexp[−2σ2(X−Xi)T(X−Xi)]∑i=1nYiexp[−2σ2(X−Xi)T(X−Xi)](8)

估计值 Y ( X ) Y(X) Y(X)为所有样本观测值 Y i Y_i Yi的加权平均,每个观测值 Y i Y_i Yi的权重因子为相应的样本 X i X_i Xi与 X X X之间 Euclid 距离平方的指数 . 当光滑因子 σ 非常大的时候 , Y ( X ) Y(X) Y(X)近似于所有样本因变量的均值 。 相反,当光滑因子σ 。趋向于0 的时候, Y ( X ) Y(X) Y(X)和训练样本非常接近,当需预测的点被包含在训练样本集中时,公式求出的因变量的预测值会和样本中对应的因变量非常接近, 而一旦碰到样本中未能包含进去的点,有可能预测效果会非常差 , 这种现象说明网络的泛化能力差。当σ取值适中,求预测值 Y ( X ) Y(X) Y(X)时,所有训练样本的因变量都被考虑了进去,与预测点距离近的样本点对应的因变量被加了更大的权。

4.数据集

数据信息如下:

data.mat 的中包含input数据和output数据

其中input数据维度为:2000*2

其中output数据维度为2000*1

所以RF模型的数据输入维度为2;输出维度为1。

5.社会群体算法优化GRNN

社会群体算法原理请参考:https://blog.csdn.net/u011835903/article/details/119677682

优化参数主要是GRNN的光滑因子 σ \sigma σ参数。是适应度函数设计为:

f i n t e n e s s = M S E [ p r e d i c t ( t r a i n ) ] + M S E [ p r e d i c t ( t e s t ) ] finteness = MSE[predict(train)] + MSE[predict(test)] finteness=MSE[predict(train)]+MSE[predict(test)]

适应度函数选取训练后的MSE误差。MSE误差越小表明预测的数据与原始数据重合度越高。最终优化的输出为,最佳的光滑因子。

6.实验结果

社会群体算法的参数设置如下:

%% 社会群体算法

pop = 20;%种群数量

Max_iteration = 20;%最大迭代次数

lb = 0.01;%下边界

ub = 2;%上边界

dim = 1;%维度

fobj = @(spread) fun(spread,Pn_train,Tn_train,Pn_test,Tn_test);

[Best_pos,Best_score,SSA_curve]=SSA(pop,Max_iteration,lb,ub,dim,fobj); %开始优化

经过社会群体算法优化的结果:

从MSE 误差曲线可以看出,社会群体优化的GRNN结果更好

7.Matlab代码

智能推荐

“码农”一词是怎么来的?为什么中国程序员会被码农?程序员和农民有什么关联?-程序员宅基地

文章浏览阅读1.7w次。原创: 思齐大神 来源:蚁开源社区很多同学会问,IT行业在中国并不是特别差的行业,而程序员的工资也并不低,但为什么中国的程序员总被称作码农或者说是苦逼的程序员?中国的程序员生活和欧美的有什么不一样?先说两个小段子街边,一对情侣在吵架。女孩对男孩说,“我们分手吧!”男孩沉默半天,开口问道,“我能再说最后一句话吗?”“说吧,婆婆妈妈的。”“我会编程……”“会编程有个屁用啊,现在到处都是会编程的人!”男孩涨红了脸,接着说道,“我会编程……我会变成…童话里,你爱的那个天使……”【程序._码农

Java初学者也能看的懂的AQS_aqs对接-程序员宅基地

文章浏览阅读259次。Java初学者也能看的懂的AQS学习AQS之前,你需要了解以下内容,如果不是很清楚,那么理解本文会有点吃力。(Java初学者得会一下内容)synchronizedCASLock前言synchronized首先我们知道synchronized是Java关键字,上锁释放锁等一切操作都是由JVM控制的。我们只能通过虚拟机的C++才能去研究其底层实现。我们除了判断synchronized是作为方法的修饰符,还是当做同步代码块使用以外,没什么需要我们程序员操作的。cas一种自旋的原子操作,也是J_aqs对接

【JZOJ5262】【GDOI2018模拟8.12】树(DP,性质题)_gdoi2018省选模拟树-程序员宅基地

文章浏览阅读460次。DescriptionSolution首先我们可以知道两个性质:1、路径u-v和路径v-w可以合并为路径u-w;2、路径u1-v1加路径u2-v2和路径u1-v2加路径u2-v1是等价的(就是起始点和终点可以互换) 那么知道这些性质之后就很好做了。我们只用知道每个点多少次做起点和多少次做终点。 我们设f[i]表示满足i子树的需求i上的值要是多少。 那么枚举i的所有儿子,判断a[i]-f[i],_gdoi2018省选模拟树

[PTA]7-65 字符串替换 (15 分)含思路_字符串替换pta-程序员宅基地

文章浏览阅读2.8k次,点赞4次,收藏28次。我们进行简单的运算即可实现倒序。_字符串替换pta

linux网络设置_linux如何开启网络连接-程序员宅基地

文章浏览阅读4k次,点赞5次,收藏22次。traceroute 180.101.50.188————————测试到180.101.50.188有多少个网关。vim /etc/sysconfig/static-routes——————————修改。netstat -antp | grep 22———————查看端口号22的相关信息。systemctl restart network————————————重启。systemctl restart network————————重新启动。_linux如何开启网络连接

pr中,视频导入后,视频画面大小显示不完整应该如何解决?_avi视频到pr里会放大-程序员宅基地

文章浏览阅读4w次,点赞23次,收藏6次。本人pr小白,今天编辑视频时候遇到了问题,也解决了,所以分享记录一下。问题一视频下面原来有字幕的,可是导入的视频变大了,现在看不到了怎么办?还有就是,频导入之后画质好像变糊了又是为什么?解决:将箭头放到要编辑的视频那里,右击,然后点击设为帧大小这样完整的视频就出来了。问题二如果视频模糊,就是序列设置的不对 要先新建序列一般的都是1920×1080本人博客:https://blog.csdn.net/weixin_46654114本人b站求关注:https://space.bi_avi视频到pr里会放大

随便推点

SeetaFace2 Android 平台编译_seetafacerecognizer2.0.ats-程序员宅基地

文章浏览阅读4.1k次。SeetaFace2 Android 平台编译项目地址:https://github.com/seetafaceengine/SeetaFace2SeetaFace2 人脸识别引擎包括了搭建一套全自动人脸识别系统所需的三个核心模块,即:人脸检测模块 FaceDetector、面部关键点定位模块 FaceLandmarker 以及人脸特征提取与比对模块 FaceRecognizer。面部关键点定位支持 5 点 和 81 点定位,两个辅助模块 FaceTracker 和 QualityAssessor 用_seetafacerecognizer2.0.ats

Oracle删除约束和主键的语句_oracle删除主键的sql语句-程序员宅基地

文章浏览阅读3.2w次,点赞4次,收藏34次。1.删除约束语句:alter table 表名 drop constraint 约束名;alter table mz_sf4 drop constraint pk_id1;2.删除主键语句:alter table 表名 drop primary key;alter table mz_sf3 drop primary key;如果出错:ORA-02273:此唯一主键已_oracle删除主键的sql语句

MySQL~InnoDB的备份和主从复制-程序员宅基地

文章浏览阅读989次,点赞9次,收藏13次。这份面试题几乎包含了他在一年内遇到的所有面试题以及答案,甚至包括面试中的细节对话以及语录,可谓是细节到极致,甚至简历优化和怎么投简历更容易得到面试机会也包括在内!也包括教你怎么去获得一些大厂,比如阿里,腾讯的内推名额!某位名人说过成功是靠99%的汗水和1%的机遇得到的,而你想获得那1%的机遇你首先就得付出99%的汗水!你只有朝着你的目标一步一步坚持不懈的走下去你才能有机会获得成功!成功只会留给那些有准备的人!《一线大厂Java面试题解析+核心总结学习笔记+最新讲解视频+实战项目源码》点击传送门即可获取。

大数据平台核心技术 学堂在线 雨课堂 第八讲作业答案 人文交流月_vertectorization-程序员宅基地

文章浏览阅读2k次。关于Vertectorization哪些是正确的( )相对于其他编程模型,sql在大数据领域有哪些好处( )哪些部分适合做codegen( )关于内存计算描述不正确的有( )_vertectorization

java汉字拼音简码_java生成首字母拼音简码的总结-程序员宅基地

文章浏览阅读306次。百度找到了某论坛高人写的java(具体论坛记不清了),直接用来调用,再次非常感谢,基本上实现了我的需求package MD5;import java.util.Scanner;public class ChineseToPinYin {/*** 汉字转拼音缩写** @param str* 要转换的汉字字符串* @return String 拼音缩写*/public Strin..._java生成拼音码

C++ 数据结构——堆排序_数据结构堆排序c++-程序员宅基地

文章浏览阅读93次。/* 堆排序 */#include <iostream>using namespace std;int *data;void Sift(int k,int last){ int i,j,temp; i=k;j=2*i+1; while (j<=last) { if(j<last&&data[j]<data[j+1]) j++; if(data[i]>data[j]) _数据结构堆排序c++