深度学习目标检测:YOLOv5实现车辆检测(含车辆检测数据集+训练代码)-程序员宅基地

技术标签: 车辆目标检测 机动车检测 深度学习 智能驾驶 车辆检测数据集 YOLOv5车辆检测 车辆检测

深度学习目标检测:YOLOv5实现车辆检测(含车辆检测数据集+训练代码)

目录

深度学习目标检测:YOLOv5实现车辆检测(含车辆检测数据集+训练代码)

1. 前言

本篇博客,我们将手把手教你搭建一个基于YOLOv5的车辆目标检测项目。目前,基于YOLOv5s的车辆平均精度平均值mAP_0.5=0.57192,mAP_0.5:0.95=0.41403,基本满足业务的性能需求。另外,为了能部署在手机Android平台上,本人对YOLOv5s进行了模型轻量化,开发了一个轻量级的版本yolov5s05_416和yolov5s05_320,在普通Android手机上可以达到实时的检测和识别效果,CPU(4线程)约30ms左右,GPU约25ms左右 ,基本满足业务的性能需求。

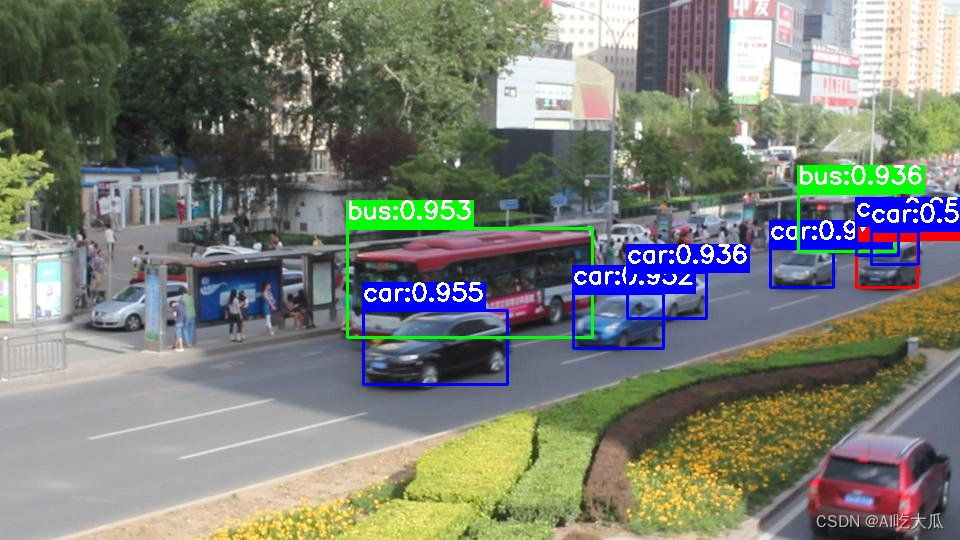

先展示一下Python版本车辆检测Demo效果:

|

|

【尊重原创,转载请注明出处】https://panjinquan.blog.csdn.net/article/details/128099672

更多项目《智能驾驶 车牌检测和识别》系列文章请参考:

- 智能驾驶 车牌检测和识别(一)《CCPD车牌数据集》:https://blog.csdn.net/guyuealian/article/details/128704181

- 智能驾驶 车牌检测和识别(二)《YOLOv5实现车牌检测(含车牌检测数据集和训练代码)》:https://blog.csdn.net/guyuealian/article/details/128704068

- 智能驾驶 车牌检测和识别(三)《CRNN和LPRNet实现车牌识别(含车牌识别数据集和训练代码)》:https://blog.csdn.net/guyuealian/article/details/128704209

- 智能驾驶 车牌检测和识别(四)《Android实现车牌检测和识别(可实时车牌识别)》:https://blog.csdn.net/guyuealian/article/details/128704242

- 智能驾驶 车牌检测和识别(五)《C++实现车牌检测和识别(可实时车牌识别)》:https://blog.csdn.net/guyuealian/article/details/128704276

- 智能驾驶 红绿灯检测(一)《红绿灯(交通信号灯)数据集》:https://blog.csdn.net/guyuealian/article/details/128222850

- 智能驾驶 红绿灯检测(二)《YOLOv5实现红绿灯检测(含红绿灯数据集+训练代码)》:https://blog.csdn.net/guyuealian/article/details/128240198

- 智能驾驶 红绿灯检测(三)《Android实现红绿灯检测(含Android源码 可实时运行)》:https://blog.csdn.net/guyuealian/article/details/128240334

-

智能驾驶 车辆检测(一)《UA-DETRAC BITVehicle车辆检测数据集》:https://blog.csdn.net/guyuealian/article/details/127907325

-

智能驾驶 车辆检测(二)《YOLOv5实现车辆检测(含车辆检测数据集+训练代码)》:https://blog.csdn.net/guyuealian/article/details/128099672

-

智能驾驶 车辆检测(三)《Android实现车辆检测(含Android源码 可实时运行)》:https://blog.csdn.net/guyuealian/article/details/128190532

2. 车辆检测数据集说明

(1)车辆检测数据集

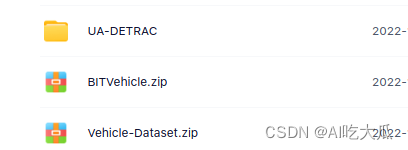

目前收集了约10W+的车辆检测数据集:UA-DETRAC车辆检测数据集+Vehicle-Dataset车辆检测数据集+BITVehicle车辆检测数据集:

关于车辆检测数据集使用说明和下载,详见另一篇博客说明:《UA-DETRAC BITVehicle车辆检测数据集(含下载地址)》

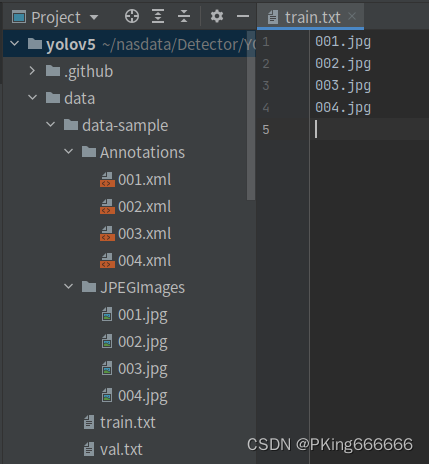

(2)自定义数据集

如果需要增/删类别数据进行训练,或者需要自定数据集进行训练,可参考如下步骤:

- 采集图片,建议不少于200张图片

- 使用Labelme等标注工具,对目标进行拉框标注:labelme工具:GitHub - wkentaro/labelme: Image Polygonal Annotation with Python (polygon, rectangle, circle, line, point and image-level flag annotation).

- 将标注格式转换为VOC数据格式,参考工具:labelme/labelme2voc.py at main · wkentaro/labelme · GitHub

- 生成训练集train.txt和验证集val.txt文件列表

- 修改engine/configs/voc_local.yaml的train和val的数据路径

- 重新开始训练

3. 基于YOLOv5的车辆检测模型训练

(1)YOLOv5安装

训练Pipeline采用YOLOv5: https://github.com/ultralytics/yolov5 , 原始代码训练需要转换为YOLO的格式,不支持VOC的数据格式。为了适配VOC数据,本人新增了LoadVOCImagesAndLabels用于解析VOC数据集,以便正常训练。另外,为了方便测试,还增加demo.py文件,可支持对图片,视频和摄像头的测试。

Python依赖环境,使用pip安装即可,项目代码都在Ubuntu系统和Windows系统验证正常运行,请放心使用;若出现异常,大概率是相关依赖包版本没有完全对应

matplotlib>=3.2.2

numpy>=1.18.5

opencv-python>=4.1.2

Pillow

PyYAML>=5.3.1

scipy>=1.4.1

torch>=1.7.0

torchvision>=0.8.1

tqdm>=4.41.0

tensorboard>=2.4.1

seaborn>=0.11.0

pandas

thop # FLOPs computation

pybaseutils==0.6.5项目安装教程请参考(初学者入门,麻烦先看完下面教程,配置好开发环境):

(2)准备Train和Test数据

下载车辆检测数据集,总共约10W+的图片:UA-DETRAC车辆检测数据集+Vehicle-Dataset车辆检测数据集+BITVehicle车辆检测数据集

考虑到UA-DETRAC车辆检测数据集比较大,其训练的模型的检测效果相对比较好,因此后续以UA-DETRAC车辆检测数据集为示例,说明训练过程。其他数据集训练,请根据自己环境,适当修改即可。

(3)配置数据文件

- 修改训练和测试数据的路径:engine/configs/voc_local.yaml

- 注意数据路径分隔符使用【/】,不是【\】

- 项目不要出现含有中文字符的目录文件或路径,否则会出现很多异常!!!!!!!!

# Train/val/test sets as 1) dir: path/to/imgs, 2) file: path/to/imgs.txt, or 3) list: [path/to/imgs1, path/to/imgs2, ..]

# 数据路径

path: "" # dataset root dir

# 注意数据路径分隔符使用【/】,不是【\】

# 项目不要出现含有中文字符的目录文件或路径,否则会出现很多异常!!!!!!!!

train:

- "D:/path/to/UA-DETRAC/DETRAC-VOC/DETRAC-train-voc/train.txt"

- "D:/path/to/UA-DETRAC/DETRAC-VOC/DETRAC-test-voc/test.txt" # 做模型性能测试时,测试集不要加入,避免指标有歧义

val:

- "D:/path/to/UA-DETRAC/DETRAC-VOC/DETRAC-test-voc/test.txt"

test: # test images (optional)

data_type: voc

# 1.设置类别个数,和要训练的类别名称,ID号从0开始递增

nc: 4 # number of classes

names: { 'car': 0, 'bus': 1, 'van': 2,'others': 3 }

# 2.如果你想合并几个类别进行训练,比如将'[car','bus','van']看作一类,others看作另一类,则

#nc: 2 # number of classes

#names: { 'car': 0, 'bus': 0, 'van': 0,'others': 1 }

# 3.如果你想合并所有类别为一个大类,进行训练: unique表示合并所有类为单独一个类别

#nc: 1 # number of classes

#names: { "unique": 0 }- 如果你想合并几个类别进行训练,比如将'[car','bus','van']看作一类,others看作另一类,则修改engine/configs/voc_local.yaml:

nc: 2 # number of classes

names: { 'car': 0, 'bus': 0, 'van': 0,'others': 1 }- 如果你想合并所有类别为一个大类,进行训练: unique表示合并所有类为单独一个类别

nc: 1 # number of classes

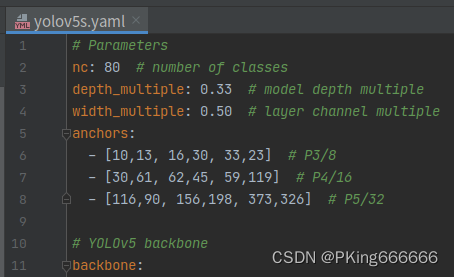

names: { "unique": 0 }(4)配置模型文件

官方YOLOv5给出了YOLOv5l,YOLOv5m,YOLOv5s等模型。考虑到手机端CPU/GPU性能比较弱鸡,直接部署yolov5s运行速度十分慢。所以本人在yolov5s基础上进行模型轻量化处理,即将yolov5s的模型的channels通道数全部都减少一半,并且模型输入由原来的640×640降低到416×416或者320×320,该轻量化的模型我称之为yolov5s05。从性能来看,yolov5s05比yolov5s快5多倍,而mAP下降了10%(0.57→0.47),对于手机端,这精度勉强可以接受。

下面是yolov5s05和yolov5s的参数量和计算量对比:

| 模型 | input-size | params(M) | GFLOPs | mAP0.5 |

| yolov5s | 640×640 | 7.2 | 16.5 | 0.57192 |

| yolov5s05 | 416×416 | 1.7 | 1.8 | 0.47022 |

| yolov5s05 | 320×320 | 1.7 | 1.1 | 0.44788 |

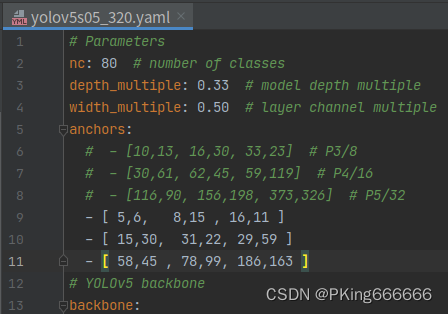

(5)重新聚类Anchor(可选)

官方yolov5s的Anchor是基于COCO数据集进行聚类获得(详见models/yolov5s.yaml文件)

对于yolov5s05的Anchor,由于输入大小640缩小到320,其对应的Anchor也应该缩小一倍:

一点建议:

- 官方yolov5s的Anchor是基于COCO数据集进行聚类获得,不同数据集需要做适当的调整,其最优Anchor建议重新进行聚类 。

- 当然你要是觉得麻烦就跳过,不需要重新聚类Anchor,这个影响不是特别大。如果你需要重新聚类,请参考engine/kmeans_anchor/demo.py文件

(6)开始训练

整套训练代码非常简单操作,用户只需要将相同类别的数据放在同一个目录下,并填写好对应的数据路径,即可开始训练了。

- 修改训练超参文件: data/hyps/hyp.scratch-v1.yaml (可以修改训练学习率,数据增强等方式,使用默认即可)

- Linux系统终端运行,训练yolov5s或轻量化版本yolov5s05_416或者yolov5s05_320 (选择其中一个训练即可)

#!/usr/bin/env bash

#--------------训练yolov5s--------------

# 输出项目名称路径

project="runs/yolov5s_640"

# 训练和测试数据的路径

data="engine/configs/voc_local.yaml"

# YOLOv5模型配置文件

cfg="yolov5s.yaml"

# 训练超参数文件

hyp="data/hyps/hyp.scratch-v1.yaml"

# 预训练文件

weights="engine/pretrained/yolov5s.pt"

python train.py --data $data --cfg $cfg --hyp $hyp --weights $weights --batch-size 16 --imgsz 640 --workers 4 --project $project

#--------------训练轻量化版本yolov5s05_416--------------

# 输出项目名称路径

project="runs/yolov5s05_416"

# 训练和测试数据的路径

data="engine/configs/voc_local.yaml"

# YOLOv5模型配置文件

cfg="yolov5s05_416.yaml"

# 训练超参数文件

hyp="data/hyps/hyp.scratch-v1.yaml"

# 预训练文件

weights="engine/pretrained/yolov5s.pt"

python train.py --data $data --cfg $cfg --hyp $hyp --weights $weights --batch-size 16 --imgsz 416 --workers 4 --project $project

#--------------训练轻量化版本yolov5s05_320--------------

# 输出项目名称路径

project="runs/yolov5s05_320"

# 训练和测试数据的路径

data="engine/configs/voc_local.yaml"

# YOLOv5模型配置文件

cfg="yolov5s05_320.yaml"

# 训练超参数文件

hyp="data/hyps/hyp.scratch-v1.yaml"

# 预训练文件

weights="engine/pretrained/yolov5s.pt"

python train.py --data $data --cfg $cfg --hyp $hyp --weights $weights --batch-size 16 --imgsz 320 --workers 4 --project $project

- Windows系统终端运行,yolov5s或轻量化版本yolov5s05_416或者yolov5s05_320 (选择其中一个训练即可)

#!/usr/bin/env bash

#--------------训练yolov5s--------------

python train.py --data engine/configs/voc_local.yaml --cfg yolov5s.yaml --hyp data/hyps/hyp.scratch-v1.yaml --weights engine/pretrained/yolov5s.pt --batch-size 16 --imgsz 640 --workers 4 --project runs/yolov5s_640

#--------------训练轻量化版本yolov5s05_416--------------

python train.py --data engine/configs/voc_local.yaml --cfg yolov5s05_416.yaml --hyp data/hyps/hyp.scratch-v1.yaml --weights engine/pretrained/yolov5s.pt --batch-size 16 --imgsz 416 --workers 4 --project runs/yolov5s05_416

#--------------训练轻量化版本yolov5s05_320--------------

python train.py --data engine/configs/voc_local.yaml --cfg yolov5s05_320.yaml --hyp data/hyps/hyp.scratch-v1.yaml --weights engine/pretrained/yolov5s.pt --batch-size 16 --imgsz 320 --workers 4 --project runs/yolov5s05_320

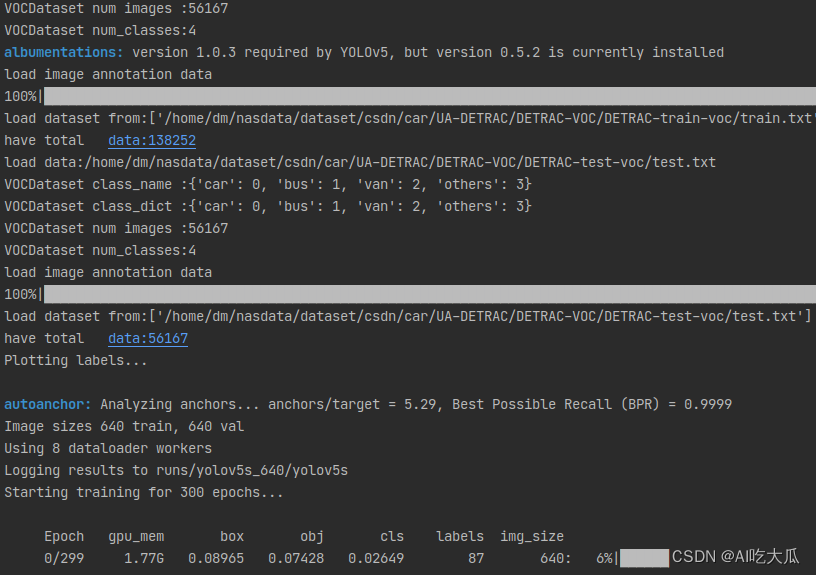

- 开始训练:

- 训练数据量比较大,训练时间比较长,请耐心等待哈

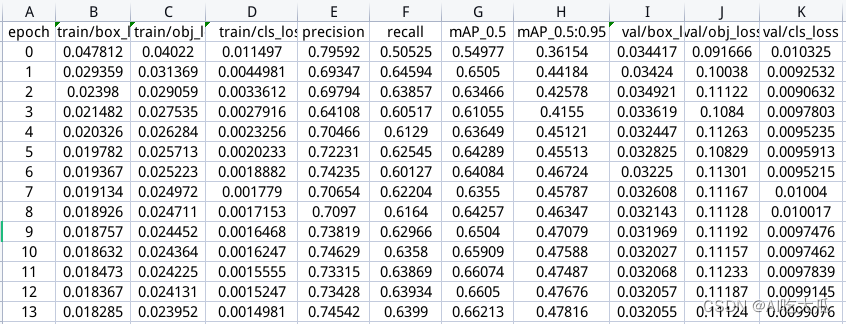

- 训练完成后,在模型输出目录中有个results.csv文件,记录每个epoch测试的结果,如loss,mAP等信息

训练模型收敛后,yolov5s车辆检测的mAP指标大约mAP_0.5=0.57192;而,yolov5s05_416 mAP_0.5=0.47022左右;yolov5s05_320 mAP_0.5=0.44788左右

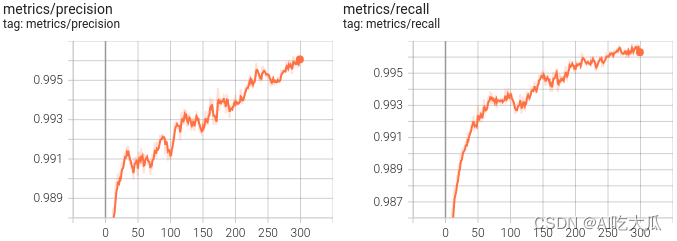

(7)可视化训练过程

训练过程可视化工具是使用Tensorboard,使用方法:

# 基本方法

tensorboard --logdir=path/to/log/

# 例如

tensorboard --logdir ./data/model/yolov5s_640 |

|

|

|

当然,在输出目录,也保存很多性能指标的图片

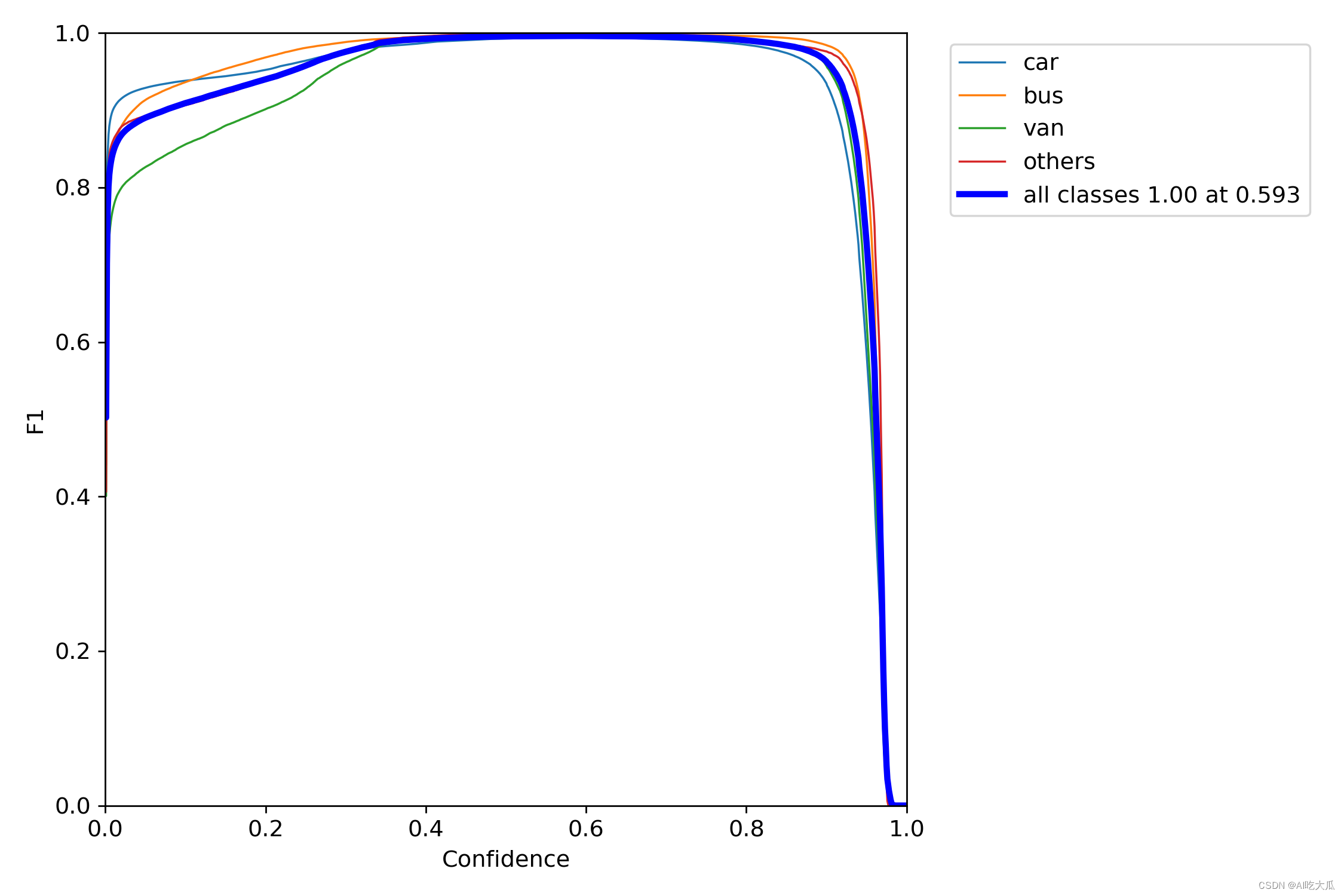

- 这是训练epoch的可视化图,可以看到mAP随着Epoch训练,逐渐提高

- 这是每个类别的F1-Score分数

- 这是模型的PR曲线

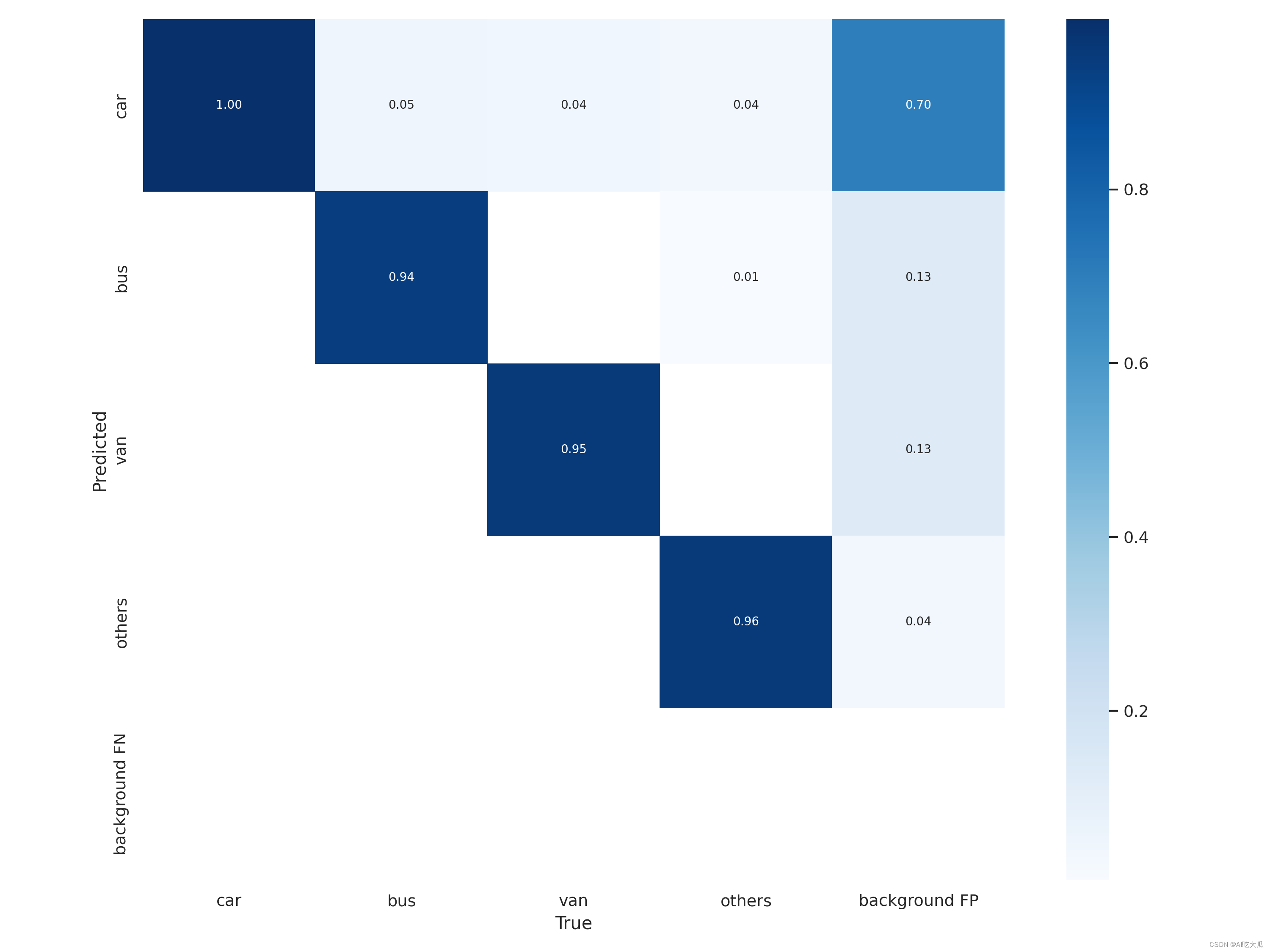

- 这是混淆矩阵:

(8)常见的错误

- YOLOv5 BUG修复记录

- 项目安装教程请参考:项目开发使用教程和常见问题和解决方法

- 项目不要出现含有中文字符的目录文件或路径,否则会出现很多异常!!!!!!!!

4. Python版本车辆检测效果

demo.py文件用于推理和测试模型的效果,填写好配置文件,模型文件以及测试图片即可运行测试了

- 测试图片

# 测试图片(Linux系统)

image_dir='data/car-test' # 测试图片的目录

weights="data/model/yolov5s_640/weights/best.pt" # 模型文件

out_dir="runs/car-result" # 保存检测结果

python demo.py --image_dir $image_dir --weights $weights --out_dir $out_dirWindows系统,请将$image_dir, $weights ,$out_dir等变量代替为对应的变量值即可,如

# 测试图片(Windows系统)

python demo.py --image_dir data/car-test --weights data/model/yolov5s_640/weights/best.pt --out_dir runs/car-result

- 测试视频文件

# 测试视频文件(Linux系统)

video_file="data/car-video.mp4" # path/to/video.mp4 测试视频文件,如*.mp4,*.avi等

weights="data/model/yolov5s_640/weights/best.pt" # 模型文件

out_dir="runs/car-result" # 保存检测结果

python demo.py --video_file $video_file --weights $weights --out_dir $out_dir# 测试视频文件(Windows系统)

python demo.py --video_file data/car-video.mp4 --weights data/model/yolov5s_640/weights/best.pt --out_dir runs/car-result

- 测试摄像头

# 测试摄像头(Linux系统)

video_file=0 # 测试摄像头ID

weights="data/model/yolov5s_640/weights/best.pt" # 模型文件

out_dir="runs/car-result" # 保存检测结果

python demo.py --video_file $video_file --weights $weights --out_dir $out_dir

# 测试摄像头(Windows系统)

python demo.py --video_file 0 --weights data/model/yolov5s_640/weights/best.pt --out_dir runs/car-result

|

|

|

|

如果想进一步提高模型的性能,可以尝试:

- 增加训练的样本数据: 目前只有10W+的数据量,建议根据自己的业务场景,采集相关数据,提高模型泛化能力

- 使用参数量更大的模型: 本教程使用的YOLOv5s,其参数量才7.2M,而YOLOv5x的参数量有86.7M,理论上其精度更高,但推理速度也较慢。

- 尝试不同数据增强的组合进行训练

5. Android版本车辆检测效果

已经完成Android版本车辆检测模型算法开发,APP在普通Android手机上可以达到实时的检测和识别效果,CPU(4线程)约30ms左右,GPU约20ms左右 ,基本满足业务的性能需求。详细说明请查看《Android实现车辆检测(含Android源码,可实时运行)》

Android Demo体验:

6.项目源码下载

整套项目源码内容包含:车辆检测数据集 + YOLOv5训练代码和测试代码

整套项目下载地址:深度学习目标检测:YOLOv5实现车辆检测(含车辆检测数据集+训练代码)

(1)车辆检测数据集:UA-DETRAC BITVehicle车辆检测数据集(含下载地址)

- UA-DETRAC车辆检测数据集

- Vehicle-Dataset车辆检测数据集

- BIT-Vehicle车辆检测数据集

(2)YOLOv5训练代码和测试代码(Pytorch)

- 整套YOLOv5项目工程的训练代码和测试代码

- 支持高精度版本yolov5s训练和测试

- 支持轻量化版本yolov5s05_320和yolov5s05_416训练和测试

- 项目源码自带训练好的模型文件,可直接运行测试Demo

- 根据本篇博文说明,简单配置即可开始训练

更多项目《智能驾驶 车牌检测和识别》系列文章请参考:

- 智能驾驶 车牌检测和识别(一)《CCPD车牌数据集》:https://blog.csdn.net/guyuealian/article/details/128704181

- 智能驾驶 车牌检测和识别(二)《YOLOv5实现车牌检测(含车牌检测数据集和训练代码)》:https://blog.csdn.net/guyuealian/article/details/128704068

- 智能驾驶 车牌检测和识别(三)《CRNN和LPRNet实现车牌识别(含车牌识别数据集和训练代码)》:https://blog.csdn.net/guyuealian/article/details/128704209

- 智能驾驶 车牌检测和识别(四)《Android实现车牌检测和识别(可实时车牌识别)》:https://blog.csdn.net/guyuealian/article/details/128704242

- 智能驾驶 车牌检测和识别(五)《C++实现车牌检测和识别(可实时车牌识别)》:https://blog.csdn.net/guyuealian/article/details/128704276

- 智能驾驶 红绿灯检测(一)《红绿灯(交通信号灯)数据集》:https://blog.csdn.net/guyuealian/article/details/128222850

- 智能驾驶 红绿灯检测(二)《YOLOv5实现红绿灯检测(含红绿灯数据集+训练代码)》:https://blog.csdn.net/guyuealian/article/details/128240198

- 智能驾驶 红绿灯检测(三)《Android实现红绿灯检测(含Android源码 可实时运行)》:https://blog.csdn.net/guyuealian/article/details/128240334

-

智能驾驶 车辆检测(一)《UA-DETRAC BITVehicle车辆检测数据集》:https://blog.csdn.net/guyuealian/article/details/127907325

-

智能驾驶 车辆检测(二)《YOLOv5实现车辆检测(含车辆检测数据集+训练代码)》:https://blog.csdn.net/guyuealian/article/details/128099672

-

智能驾驶 车辆检测(三)《Android实现车辆检测(含Android源码 可实时运行)》:https://blog.csdn.net/guyuealian/article/details/128190532

智能推荐

稀疏编码的数学基础与理论分析-程序员宅基地

文章浏览阅读290次,点赞8次,收藏10次。1.背景介绍稀疏编码是一种用于处理稀疏数据的编码技术,其主要应用于信息传输、存储和处理等领域。稀疏数据是指数据中大部分元素为零或近似于零的数据,例如文本、图像、音频、视频等。稀疏编码的核心思想是将稀疏数据表示为非零元素和它们对应的位置信息,从而减少存储空间和计算复杂度。稀疏编码的研究起源于1990年代,随着大数据时代的到来,稀疏编码技术的应用范围和影响力不断扩大。目前,稀疏编码已经成为计算...

EasyGBS国标流媒体服务器GB28181国标方案安装使用文档-程序员宅基地

文章浏览阅读217次。EasyGBS - GB28181 国标方案安装使用文档下载安装包下载,正式使用需商业授权, 功能一致在线演示在线API架构图EasySIPCMSSIP 中心信令服务, 单节点, 自带一个 Redis Server, 随 EasySIPCMS 自启动, 不需要手动运行EasySIPSMSSIP 流媒体服务, 根..._easygbs-windows-2.6.0-23042316使用文档

【Web】记录巅峰极客2023 BabyURL题目复现——Jackson原生链_原生jackson 反序列化链子-程序员宅基地

文章浏览阅读1.2k次,点赞27次,收藏7次。2023巅峰极客 BabyURL之前AliyunCTF Bypassit I这题考查了这样一条链子:其实就是Jackson的原生反序列化利用今天复现的这题也是大同小异,一起来整一下。_原生jackson 反序列化链子

一文搞懂SpringCloud,详解干货,做好笔记_spring cloud-程序员宅基地

文章浏览阅读734次,点赞9次,收藏7次。微服务架构简单的说就是将单体应用进一步拆分,拆分成更小的服务,每个服务都是一个可以独立运行的项目。这么多小服务,如何管理他们?(服务治理 注册中心[服务注册 发现 剔除])这么多小服务,他们之间如何通讯?这么多小服务,客户端怎么访问他们?(网关)这么多小服务,一旦出现问题了,应该如何自处理?(容错)这么多小服务,一旦出现问题了,应该如何排错?(链路追踪)对于上面的问题,是任何一个微服务设计者都不能绕过去的,因此大部分的微服务产品都针对每一个问题提供了相应的组件来解决它们。_spring cloud

Js实现图片点击切换与轮播-程序员宅基地

文章浏览阅读5.9k次,点赞6次,收藏20次。Js实现图片点击切换与轮播图片点击切换<!DOCTYPE html><html> <head> <meta charset="UTF-8"> <title></title> <script type="text/ja..._点击图片进行轮播图切换

tensorflow-gpu版本安装教程(过程详细)_tensorflow gpu版本安装-程序员宅基地

文章浏览阅读10w+次,点赞245次,收藏1.5k次。在开始安装前,如果你的电脑装过tensorflow,请先把他们卸载干净,包括依赖的包(tensorflow-estimator、tensorboard、tensorflow、keras-applications、keras-preprocessing),不然后续安装了tensorflow-gpu可能会出现找不到cuda的问题。cuda、cudnn。..._tensorflow gpu版本安装

随便推点

物联网时代 权限滥用漏洞的攻击及防御-程序员宅基地

文章浏览阅读243次。0x00 简介权限滥用漏洞一般归类于逻辑问题,是指服务端功能开放过多或权限限制不严格,导致攻击者可以通过直接或间接调用的方式达到攻击效果。随着物联网时代的到来,这种漏洞已经屡见不鲜,各种漏洞组合利用也是千奇百怪、五花八门,这里总结漏洞是为了更好地应对和预防,如有不妥之处还请业内人士多多指教。0x01 背景2014年4月,在比特币飞涨的时代某网站曾经..._使用物联网漏洞的使用者

Visual Odometry and Depth Calculation--Epipolar Geometry--Direct Method--PnP_normalized plane coordinates-程序员宅基地

文章浏览阅读786次。A. Epipolar geometry and triangulationThe epipolar geometry mainly adopts the feature point method, such as SIFT, SURF and ORB, etc. to obtain the feature points corresponding to two frames of images. As shown in Figure 1, let the first image be and th_normalized plane coordinates

开放信息抽取(OIE)系统(三)-- 第二代开放信息抽取系统(人工规则, rule-based, 先抽取关系)_语义角色增强的关系抽取-程序员宅基地

文章浏览阅读708次,点赞2次,收藏3次。开放信息抽取(OIE)系统(三)-- 第二代开放信息抽取系统(人工规则, rule-based, 先关系再实体)一.第二代开放信息抽取系统背景 第一代开放信息抽取系统(Open Information Extraction, OIE, learning-based, 自学习, 先抽取实体)通常抽取大量冗余信息,为了消除这些冗余信息,诞生了第二代开放信息抽取系统。二.第二代开放信息抽取系统历史第二代开放信息抽取系统着眼于解决第一代系统的三大问题: 大量非信息性提取(即省略关键信息的提取)、_语义角色增强的关系抽取

10个顶尖响应式HTML5网页_html欢迎页面-程序员宅基地

文章浏览阅读1.1w次,点赞6次,收藏51次。快速完成网页设计,10个顶尖响应式HTML5网页模板助你一臂之力为了寻找一个优质的网页模板,网页设计师和开发者往往可能会花上大半天的时间。不过幸运的是,现在的网页设计师和开发人员已经开始共享HTML5,Bootstrap和CSS3中的免费网页模板资源。鉴于网站模板的灵活性和强大的功能,现在广大设计师和开发者对html5网站的实际需求日益增长。为了造福大众,Mockplus的小伙伴整理了2018年最..._html欢迎页面

计算机二级 考试科目,2018全国计算机等级考试调整,一、二级都增加了考试科目...-程序员宅基地

文章浏览阅读282次。原标题:2018全国计算机等级考试调整,一、二级都增加了考试科目全国计算机等级考试将于9月15-17日举行。在备考的最后冲刺阶段,小编为大家整理了今年新公布的全国计算机等级考试调整方案,希望对备考的小伙伴有所帮助,快随小编往下看吧!从2018年3月开始,全国计算机等级考试实施2018版考试大纲,并按新体系开考各个考试级别。具体调整内容如下:一、考试级别及科目1.一级新增“网络安全素质教育”科目(代..._计算机二级增报科目什么意思

conan简单使用_apt install conan-程序员宅基地

文章浏览阅读240次。conan简单使用。_apt install conan