”召回率“ 的搜索结果

我们可以很明显的看出,精确率和召回率最大的不同就是分母的不同,一个是预测的正样本个数,一个是数据集里的正样本个数。【精确率】是指分类正确的正样本占分类器判定为正样本的样本个数的比例。【召回率】是指分类...

模型好坏只需要精确率不需要召回率?

3. F值 = 精确率 * 召回率 * 2 / (精确率 + 召回率) (F 值即为精确率和召回率的调和平均值)精确率、召回率和 F 值是在鱼龙混杂的环境中,选出目标的重要评价指标。召回率是指检索出的相关文档数和文档库中所有的...

比如:总共实际有60个男性,模型只找出了50个,那召回率=50/60=83.3%,用来衡量找出部分对实际真实部分的覆盖情况。比如:在所有样本中,模型预找出50人说他们都是男性,而找出的这波人里实际只有40人为男性,准确率...

准确率、精准率、召回率

标签: 深度学习

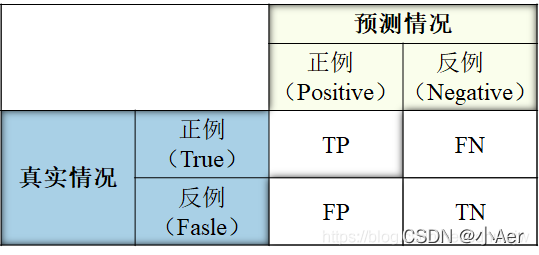

参考:准确率、精确率、召回率 - 知乎 以一个二分类系统来讲,通常情况下我们会将数据分为两类:正确(T),错误(F) ,但是在我们实际操作的运行模型的结果中会出现四种不同的分类结果 P(positive)N(Nagitive) ...

最近在用BiLSTM+CRF做命名实体识别问题。...公式准确率 = 预测正确的实体个数 / 预测的实体总个数召回率 = 预测正确的实体个数 / 标注的实体总个数F1 = 2 *准确率 * 召回率 / (准确率 + 召回率)实现1、获取实体:...

准确率、召回率、F值

标签: python

1、准确率与召回率(Precision & Recall) 准确率和召回率是广泛用于信息检索和统计学分类领域的两个度量值,用来评价结果的质量。其中精度是检索出相关文档数与检索出的文档总数的比率,衡量的是检索系统的查...

理解精确率和召回率

python 精准率和召回率

标签: python

python入门

网格搜索、随机搜索和贝叶斯优化是寻找机器学习模型参数的最佳组合、交叉验证每个组合并确定哪一个提供最佳性能的流行方法... 此示例还将讨论如何根据不同的评估指标(准确度、召回率、精度、F1、F2、F0.5)微调超参数

评估师 在mahout原始码之上,并至少提供了更好的封装,提供评估器功能,包括准确率,召回率等评估方法。

1.1 精确率与召回率 1.1.1 混淆举证 在分类任务下,预测结果(Predicted Condition)与正确标记(True Condition)之间存在四种不同的组合,构成混淆矩阵(适用于多分类) TP:True Positives, 表示实际为正例且被分类...

https://zhuanlan.zhihu.com/p/93586831

识别精度主要是由召回率(recall)和精度(precision)表示的。通过绘制precision-recall 曲线,该曲线下方的面积越大,识别精度也就越高,反之越低。 在说明 recall 和 precision 计算公式之前需要先介绍几个数据...

对于二分类问题,机器预测的和实际的还是会有所偏差,所以我们引入以下几个概念来评价分类器的优良。 一、TP、TN、FP、FN概念 首先有关TP、TN、FP、FN的概念。大体来看,TP与TN都是分对了情况,TP是正类,TN是负类...

sklearn计算准确率和召回率

Precision (精确率) 和 Recall (召回率) 是机器学习中的两个重要指标,用于评估分类模型的性能。精确率指预测为正的样本中真正为正的样本占比,召回率指真正为正的样本中被正确地预测为正的样本占比。其中,TP 表示...

python - sklearn 计算召回率 因为最近写的分类模型需要性能评价 ,常用的分类性能评价有 查准率、召回率、准确率、F1 分类问题的常用的包 sklearn ,下面对召回率所用的方法进行介绍 前提知识 对于我们的二分类问题...

计算微观和宏观平均:精度、召回率、F-score。 从混淆矩阵计算。 如果您有任何问题,请发表评论或给我发电子邮件。

准确率、精确率,召回率,模型拟合

准确率、召回率、覆盖率、新颖度

【机器学习】模型评价指标中的召回率低的原因

阳性(正)样例P和阴性(负)样例N,将正样本预测为正样本的为True positive(TP),正样本预测为负样本的为False negativ(FN),负样本预测为正样本的为False positive(FP),负样本预测为负样本的为True ...

将要给大家介绍的评估指标有:准确率、精准率、召回率、F1、ROC曲线、AUC曲线。 机器学习评估指标大全 所有事情都需要评估好坏,尤其是量化的评估指标。 高考成绩用来评估学生的学习能力 杠铃的重量用来评估...

推荐文章

- Unity3D 导入资源_unity怎么导入压缩包-程序员宅基地

- jqgrid 服务器端验证,javascript – jqgrid服务器端错误消息/验证处理-程序员宅基地

- 白山头讲PV: 用calibre进行layout之间的比对-程序员宅基地

- java exit方法_Java:如何测试调用System.exit()的方法?-程序员宅基地

- 如何在金山云上部署高可用Oracle数据库服务_rman target sys/holyp#ssw0rd2024@gdcamspri auxilia-程序员宅基地

- Spring整合Activemq-程序员宅基地

- 语义分割入门的总结-程序员宅基地

- SpringBoot实践(三十五):JVM信息分析_怎样查看springboot项目的jvm状态-程序员宅基地

- 基于springboot+vue的戒毒所人员管理系统 毕业设计-附源码251514_戒毒所管理系统-程序员宅基地

- 【LeetCode】面试题57 - II. 和为s的连续正数序列_leet code 和为s的正数序列 java-程序员宅基地