准确度、精确率、召回率、F1值作为评估指标,经常用到分类效果的评测上。比较好理解的二分类问题,准确度评估预测正确的比例,精确率评估预测正例的查准率,召回率评估真实正例的查全率。如何把这些评估指标用到多...

”召回率“ 的搜索结果

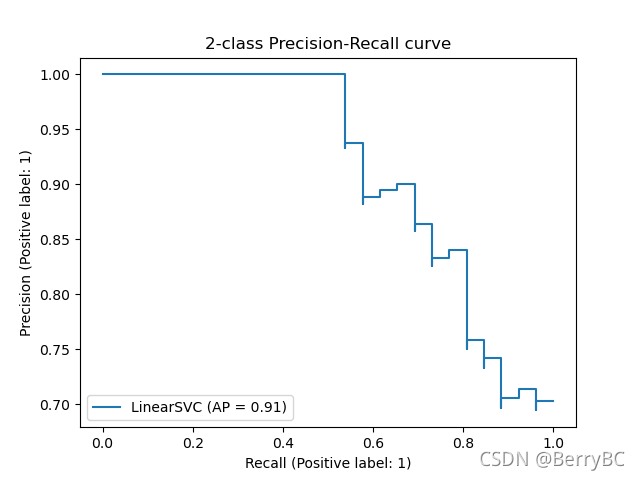

matplotlib.pyplot绘制决策树的准确率,召回率,ROC,特征重要性-附件资源

这是因为召回率和精度的计算方式不同,它们对检索结果中的相关文档和非相关文档的权重不同,因此在不同的场合下需要选择适当的指标来评估检索结果的质量。它反映了检索结果的完备性,即检索结果中包含的相关文档数与...

对于二分类问题,机器预测的和实际的还是会有所偏差,所以我们引入以下几个概念来评价分类器的优良。 首先有关TP、TN、FP、FN的概念。TP与TN都是机器(预测)分类分对了的情况,TP是预测为正类且预测正确,TN是预测...

python实现计算精度、召回率和F1值摘要:在深度学习的分类任务中,对模型的评估或测试时需要计算其在验证集或测试集上的预测精度(prediction/accuracy)、召回率(recall)和F1值。本文首先简要介绍如何计算精度、召回...

目录混淆矩阵准确率精确率召回率 分类是机器学习中比较常见的任务,对于分类任务常见的评价指标有准确率(Accuracy)、精确率(Precision)、召回率(Recall)、F1 score、ROC曲线(Receiver Operating ...

True Positive(真正, TP):将正类预测为636f707962616964757a686964616f31333431356635正类数.True Negative(真负 , TN):将负类预测为负类数.False Positive(假正, FP):将负类预测为正类数→→误报(Type I error)....

是用你查出来的正确的数量除以所有的数量(包含正确和不正确的数量)。就是查出来的正确的数量除以所有正确的数量;

召回率与精确率

在深度学习学习中,有许多常用的评估指标用于衡量模型的性能。下面是一些常见的指标及其定义和说明。关键名字解释:TP表示真正例(True Positive),即模型正确预测为正例的样本数量;TN表示真负例(True Negative)...

提高召回率是为了少漏报;提高精准率是为了少错报。ROC曲线纵轴为真正率,横轴为假正率

模型的召回率(Recall)

标签: 人工智能

在实际应用中,召回率对于那些对错过正例(漏报)比较敏感的场景非常重要,例如在医学领域中,对于一些疾病的诊断,遗漏病例可能导致严重的后果。然而,召回率的提高通常会伴随着假正例(False Positives)的增加,...

总结一句话:精准率 和 召回率——解决**样本不平衡**的情况下 **准确率**的问题

计算常见的分类器衡量指标,包括真阳性,真阴性,假阳性,假阴性,准确率,错误率,特异度和F值

召回率(Recall) 查全率精度(Precise) 查准率是广泛用于信息检索和统计学分类领域的两个度量值,用来评价结果的质量。在信息检索中的解释:系统检索到的相关文档数 系统检索到的相关文档数 A召回率 = ---------------...

精度(precision)和召回率(recall)是衡量机器学习模型性能的重要指标,特别是数据集分布不平衡的案例中。

【概念+实例】一文搞懂机器学习、深度学习中的准确率、精确率、召回率、F1分数

在机器学习和信息检索中,精准率和召回率是用来衡量分类器或检索系统的性能的常用指标。 精准率(Precision)表示的是模型预测为正的样本中实际也是正的样本占比,也就是: Precision = 真正例 / (真正例 + 假正例) ...

计算召回率:真实的正样本数目为3,而模型预测为准确的正样本数目为2,也就是3条有2条被找出来了,召回率=2/3。计算精确率:预测为正样本的数目为5,但其中只有2条是真的正样本,也就是只有2条被成功预测正确了,...

精确率精确率指标尝试回答以下问题:在被识别为正类别的样本中,确实为正类别的比例是多少?精确率的定义如下:Precision = \dfrac{TP}{TP + FP}注意:如果模型的预测结果中没有假正例,则模型的精确率为 1.0 。让...

算法测试中的召回率和精确率详解,有通俗易懂的例子说明

推荐文章

- Android 编译so文件 MP4V2_android下编译mp4v2-程序员宅基地

- 通讯录Contact_02_contact文件内容-程序员宅基地

- Qt笔记(四十二)之QZXing的编译 配置 使用_qzxingfilterrunnable error:-程序员宅基地

- 关于画图软件Dia打开程序始终为英文界面的问题-程序员宅基地

- OpenCV从入门到精通实战(二)——文档OCR识别(tesseract)-程序员宅基地

- 详解avcodec_receive_packet 11_avcodec_receive_packet eagain-程序员宅基地

- OpenGL SuperBible 7th源码编译记录_superbible7-media github-程序员宅基地

- Wireshark简单使用-程序员宅基地

- MXNet 粗糙的使用指南_iou loss mxnet-程序员宅基地

- iOS对ipa包进行代码混淆《二》 ---代码混淆_ipa包混淆-程序员宅基地