在安装完后遇到了这样的问题,我希望知道有关怎么解决,我第一次下载安装Stanfordcorenlp,直接在python中用的setting安装的

”stanfordcorenlp“ 的搜索结果

from stanfordcorenlp import StanfordCoreNLP # Define file paths input_file = 'D:/file document/desktop/语料库大作业/Tweets.csv' output_file = 'D:/file document/desktop/语料库大作业/output2.csv' # ...

我下载的中文的jar文件,明明就躺在对应的文件夹中,但是还是报错,显示找不到,默认的英语的功能已经可以实现了

前几天因为工作需要下载了Stanford Corenlp工具,然后创建相应的实例对象,对文本进行分词、注释等操作。单句测试的时候可以正常运行,很快就出结果,但是写到函数里,就是一直运行,不报错也不出结果,debug发现是...

StanfordCoreNLP 是斯坦福大学发布的 NLP 处理工具,StanfordCoreNLP 的源码使用 Java 编写,目前 Python 可以用两种方法进行调用,一种是使用 StanfordCoreNLP 库,是对 StanfordCoreNLP 进行了 Python 封装。...

这是一行Python代码,使用StanfordCoreNLP库创建了一个名为nlp的对象,指定了Stanford CoreNLP工具的安装路径,并设置了语言为中文。可以使用该对象对中文文本进行自然语言处理(NLP)操作,例如分词、词性标注、...

Jieba, SnowNLP, PkuSeg, THULAC, HanLP》我们选择了5个中文分词开源工具,这次再追加3个,分别是FoolNLTK、哈工大LTP(pyltp, ltp的python封装)、斯坦福大学的CoreNLP(stanfordcorenlp is a Python wrapper for ...

记录stanfordcorenlp发生一直运行不报错相关内容 1.检测方法 nlp处理如何获取发生错误原因的代码 from stanfordcorenlp import StanfordCoreNLP import logging #使用logging来监测错误发生原因 nlp = ...

关于使用stanfordcorenlp一直运行不报错的解决方法

深度学习-自然语言处理(NLP)-文本预处理:分词

Jieba, SnowNLP, PkuSeg, THULAC, HanLP》我们选择了5个中文分词开源工具,这次再追加3个,分别是FoolNLTK、哈工大LTP(pyltp, ltp的python封装)、斯坦福大学的CoreNLP(stanfordcorenlp is a Python wrapper for ...

分词语句五、StanfordCoreNLP1. 安装2. 分词语句 一、Jieba 1. 安装 pip install jieba 2. 分词语句 Jieba支持三种分词模式: ①精确模式:试图将句子最精确地切开,适合文本分析 ②全模式:把句子中所有的可以成...

mac nlp

爸爸们帮我看看吧 关于stanfordcorenlp欢迎使用Markdown编辑器下载中文模型jar包Chinese download 3.9.24)把加压后的stanford-corenlp-full-2018-10-05文件夹和下载的stanford-chinese-corenlp 2018-02-27-models.jar放在同一目录下 ....

自然语言处理(NLP)-第三方库(工具包):Stanford CoreNLP【更适合英文数据集;分词,词性标注,句法分析】

基于 Mac 安装Python模块Stanfordcorenlp + 安装R语言REPPlab包 + Vscode 配置Latex

IDE:Intellij idea 1. 参考了stackoverflow上诸多答案,一般是修改VM,设置_JAVA_OPTIONS,使用idea64.exe等,但仍然报错。 ... 3. 特记录下零三天来的摸索历程,万事开头难,请遇到类似错误的不要...

1)安装stanford nlp自然语言处理包: pip install stanfordcorenlp .2)下载Stanford CoreNLP文件Download CoreNLP 3.9.23)下载中文模型jar包Chinese download 3.9.24)把加压后的stanford-corenlp-full-2018-10-05...

环境:Ubuntu 16.04+anaconda3 一、pyltp 1. 安装 直接用pip安装: pip install pyltp 然后下载语言模型库,网址:...这里我下载的是最新的3.4.0的版...

stanfordcorenlp 在做中文处理是返回值为 ['', '', '', '', ''] [('', 'NR'), ('', 'NN'), ('', 'VV'), ('', 'NR'), ('', 'PU')] [('', 'ORGANIZATION'), ('', 'ORGANIZATION'), ('', 'O'), ('', 'GPE'), ('', 'O...

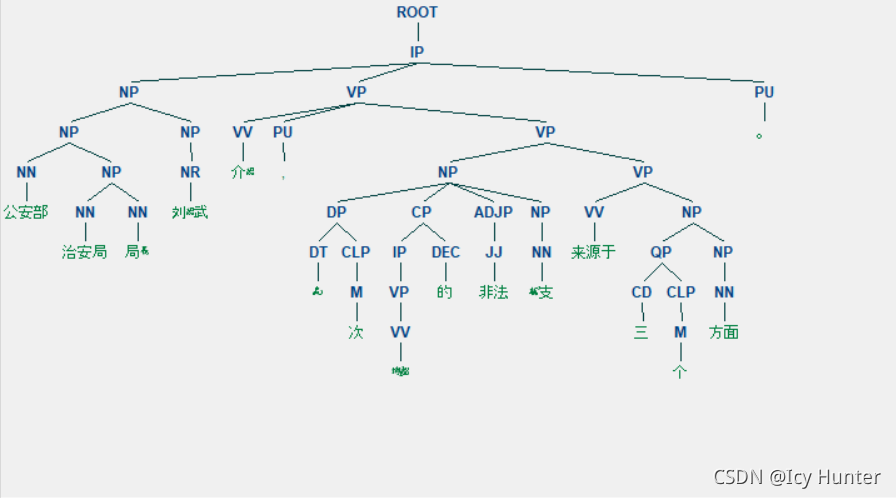

在使用StanfordCoreNLP对文本句子进行分析时,需要先对句子进行分词 nlp.word_tokenize(sentence) 然后对分词后的句子进行句子成分分析 nlp.pos_tag(sentence) 然后继续进行命名实体识别 nlp.ner(sentence) 再之后...

报错描述: Traceback (most recent call last): File “/Library/Frameworks/Python.framework/Versions/3.6/lib/python3.6/site-packages/psutil/_psosx.py”, line 330, in wrapper return fun(self, *args, **...

说明你没装Java或者没配Java环境变量

还好找到了斯坦福的一个开源工具包StanfordCoreNLP。下面就来介绍怎么玩,只针对中文,如果对其它的用法感兴趣,开源访问这里。 开始安装: 首先要下载两个包,这个应该是斯坦福大学训练好的关于处理中文自然...

推荐文章

- YOLO V8车辆行人识别_yolov8 无法识别路边行人-程序员宅基地

- jpa mysql分页_Spring Boot之JPA分页-程序员宅基地

- win10打印图片中间空白以及选择打印机预览重启_win10更新后打印图片中间空白-程序员宅基地

- 【加密】SHA256加盐加密_sha256随机盐加密-程序员宅基地

- cordys 启动流程_cordys服务重启-程序员宅基地

- net中 DLL、GAC-程序员宅基地

- (一看就会)Visual Studio设置字体大小_visual studio怎么调整字体大小-程序员宅基地

- Linux中如何读写硬盘(或Virtual Disk)上指定物理扇区_dd写入确定扇区-程序员宅基地

- python【力扣LeetCode算法题库】面试题 17.16- 按摩师(DP)_一个有名的讲师,预约一小时为单位,每次预约服务之间要有休息时间,给定一个预约请-程序员宅基地

- 进制的转换技巧_10111100b转换为十进制-程序员宅基地