python concurrent.futures 模块线程处理详解-程序员宅基地

python 模块 concurrent.futures 线程处理

文章目录

1. 简介

从Python3.2开始,标准库为我们提供了 concurrent.futures 模块,它提供了 ThreadPoolExecutor (线程池)和ProcessPoolExecutor (进程池)两个类。

相比 threading 等模块,该模块通过 submit 返回的是一个 future 对象,它是一个未来可期的对象,通过它可以获悉线程的状态主线程(或进程)中可以获取某一个线程(进程)执行的状态或者某一个任务执行的状态及返回值:

- 主线程可以获取某一个线程(或者任务的)的状态,以及返回值。

- 当一个线程完成的时候,主线程能够立即知道。

- 让多线程和多进程的编码接口一致。

2. 安装

-

python 3.x中自带了concurrent.futures模块

-

python 2.7需要安装futures模块,使用命令pip install futures安装即可

pypi地址:https://pypi.python.org/pypi/futures/

3. 线程池

# coding: utf-8

from concurrent.futures import ThreadPoolExecutor

import time

def spider(page):

time.sleep(page)

print(f"crawl task{

page} finished")

return page

with ThreadPoolExecutor(max_workers=5) as t: # 创建一个最大容纳数量为5的线程池

task1 = t.submit(spider, 1)

task2 = t.submit(spider, 2) # 通过submit提交执行的函数到线程池中

task3 = t.submit(spider, 3)

print(f"task1: {

task1.done()}") # 通过done来判断线程是否完成

print(f"task2: {

task2.done()}")

print(f"task3: {

task3.done()}")

time.sleep(2.5)

print(f"task1: {

task1.done()}")

print(f"task2: {

task2.done()}")

print(f"task3: {

task3.done()}")

print(task1.result()) # 通过result来获取返回值

执行结果如下:

task1: False

task2: False

task3: False

crawl task1 finished

crawl task2 finished

task1: True

task2: True

task3: False

1

crawl task3 finished

- 使用 with 语句 ,通过 ThreadPoolExecutor 构造实例,同时传入 max_workers参数来设置线程池中最多能同时运行的线程数目。

- 使用 submit 函数来提交线程需要执行的任务到线程池中,并返回该任务的句柄(类于文件、画图),注意 submit()不是阻塞的,而是立即返回。

- 通过使用 done() 方法判断该任务是否结束。上面的例子可以看出,提交任务后立即判断任务状态,显示四个任务都未完成。在延时2.5后,task1 和 task2 执行完毕,task3 仍在执行中。

- 使用 result() 方法可以获取任务的返回值。

4. 方法

4.1 wait

wait(fs, timeout=None, return_when=ALL_COMPLETED)

wait 接受三个参数:

- fs: 表示需要执行的序列

- timeout: 等待的最大时间,如果超过这个时间即使线程未执行完成也将返回

- return_when:表示wait返回结果的条件,默认为 ALL_COMPLETED 全部执行完成再返回

示例:

from concurrent.futures import ThreadPoolExecutor, wait, FIRST_COMPLETED, ALL_COMPLETED

import time

def spider(page):

time.sleep(page)

print(f"crawl task{

page} finished")

return page

with ThreadPoolExecutor(max_workers=5) as t:

all_task = [t.submit(spider, page) for page in range(1, 5)]

wait(all_task, return_when=FIRST_COMPLETED)

print('finished')

print(wait(all_task, timeout=2.5))

输出结果:

crawl task1 finished

finished

crawl task2 finished

crawl task3 finished

DoneAndNotDoneFutures(done={

<Future at 0x28c8710 state=finished returned int>, <Future at 0x2c2bfd0 state=finished returned int>, <Future at 0x2c1b7f0 state=finished returned int>}, not_done={

<Future at 0x2c3a240 state=running>})

crawl task4 finished

- 代码中返回的条件是:当完成第一个任务的时候,就停止等待,继续主线程任务

- 由于设置了延时, 可以看到最后只有 task4 还在运行中

4.2 as_completed

上面虽然提供了判断任务是否结束的方法,但是不能在主线程中一直判断啊。最好的方法是当某个任务结束了,就给主线程返回结果,而不是一直判断每个任务是否结束。

ThreadPoolExecutorThreadPoolExecutor 中 的 as_completed() 就是这样一个方法,当子线程中的任务执行完后,直接用 result() 获取返回结果

# coding: utf-8

from concurrent.futures import ThreadPoolExecutor, as_completed

import time

def spider(page):

time.sleep(page)

print(f"crawl task{

page} finished")

return page

def main():

with ThreadPoolExecutor(max_workers=5) as t:

obj_list = []

for page in range(1, 5):

obj = t.submit(spider, page)

obj_list.append(obj)

for future in as_completed(obj_list):

data = future.result()

print(f"main: {

data}")

if __name__ == "__main__":

main()

执行结果:

crawl task1 finished

main: 1

crawl task2 finished

main: 2

crawl task3 finished

main: 3

crawl task4 finished

main: 4

as_completed() 方法是一个生成器,在没有任务完成的时候,会一直阻塞,除非设置了 timeout。

当有某个任务完成的时候,会 yield 这个任务,就能执行 for 循环下面的语句,然后继续阻塞住,循环到所有的任务结束。同时,先完成的任务会先返回给主线程。

4.3 map

map(fn, *iterables, timeout=None)

参数说明:

- fn: 第一个参数 fn 是需要线程执行的函数;

- iterables:第二个参数接受一个可迭代对象;

- timeout: 第三个参数 timeout 跟 wait() 的 timeout 一样,但由于 map 是返回线程执行的结果,如果

timeout小于线程执行时间会抛异常 TimeoutError。

示例:

import time

from concurrent.futures import ThreadPoolExecutor

def spider(page):

time.sleep(page)

return page

start = time.time()

executor = ThreadPoolExecutor(max_workers=4)

i = 1

for result in executor.map(spider, [2, 3, 1, 4]):

print("task{}:{}".format(i, result))

i += 1

运行结果

task1:2

task2:3

task3:1

task4:4

使用 map 方法,无需提前使用 submit 方法,map 方法与 python 高阶函数 map 的含义相同,都是将序列中的每个元素都执行同一个函数。

上面的代码对列表中的每个元素都执行 spider() 函数,并分配各线程池。

可以看到执行结果与上面的 as_completed() 方法的结果不同,输出顺序和列表的顺序相同,就算 1s 的任务先执行完成,也会先打印前面提交的任务返回的结果。

5. 实战

# coding: utf-8

import requests

from concurrent.futures import ThreadPoolExecutor, as_completed

import time

import json

from requests import adapters

from proxy import get_proxies

headers = {

"Host": "splcgk.court.gov.cn",

"Origin": "https://splcgk.court.gov.cn",

"User-Agent": "Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/71.0.3578.98 Safari/537.36",

"Referer": "https://splcgk.court.gov.cn/gzfwww/ktgg",

}

url = "https://splcgk.court.gov.cn/gzfwww/ktgglist?pageNo=1"

def spider(page):

data = {

"bt": "",

"fydw": "",

"pageNum": page,

}

for _ in range(5):

try:

response = requests.post(url, headers=headers, data=data, proxies=get_proxies())

json_data = response.json()

except (json.JSONDecodeError, adapters.SSLError):

continue

else:

break

else:

return {

}

return json_data

def main():

with ThreadPoolExecutor(max_workers=8) as t:

obj_list = []

begin = time.time()

for page in range(1, 15):

obj = t.submit(spider, page)

obj_list.append(obj)

for future in as_completed(obj_list):

data = future.result()

print(data)

print('*' * 50)

times = time.time() - begin

print(times)

if __name__ == "__main__":

main()

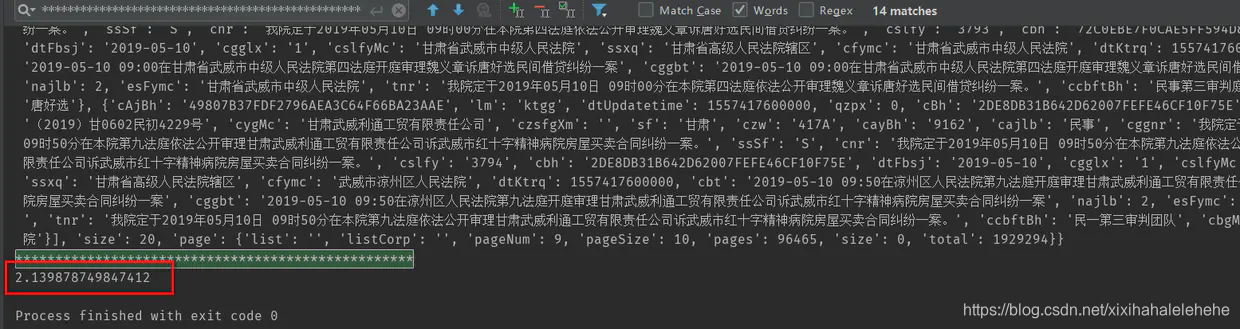

运行结果如下:

可以看到,14 页只花了 2 秒钟就爬完了

下面我们可以使用单线程来爬取,代码基本和上面的一样,加个单线程函数 代码如下:

# coding: utf-8

import requests

from concurrent.futures import ThreadPoolExecutor, as_completed

import time

import json

from requests import adapters

from proxy import get_proxies

headers = {

"Host": "splcgk.court.gov.cn",

"Origin": "https://splcgk.court.gov.cn",

"User-Agent": "Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/71.0.3578.98 Safari/537.36",

"Referer": "https://splcgk.court.gov.cn/gzfwww/ktgg",

}

url = "https://splcgk.court.gov.cn/gzfwww/ktgglist?pageNo=1"

def spider(page):

data = {

"bt": "",

"fydw": "",

"pageNum": page,

}

for _ in range(5):

try:

#response = requests.post(url, headers=headers, data=data, proxies=get_proxies())

json_data = response.json()

except (json.JSONDecodeError, adapters.SSLError):

continue

else:

break

else:

return {

}

return json_data

def single():

begin = time.time()

for page in range(1, 15):

data = spider(page)

print(data)

print('*' * 50)

times = time.time() - begin

print(times)

if __name__ == "__main__":

single()

输出;

{

'pageCheck': True, 'pageNum': '2'}

**************************************************

{

'pageCheck': True, 'pageNum': '3'}

**************************************************

{

'pageCheck': True, 'pageNum': '4'}

**************************************************

{

'pageCheck': True, 'pageNum': '5'}

**************************************************

{

'pageCheck': True, 'pageNum': '6'}

**************************************************

{

'pageCheck': True, 'pageNum': '7'}

**************************************************

{

'pageCheck': True, 'pageNum': '8'}

**************************************************

{

'pageCheck': True, 'pageNum': '9'}

**************************************************

{

'pageCheck': True, 'pageNum': '10'}

**************************************************

{

'pageCheck': True, 'pageNum': '11'}

**************************************************

{

'pageCheck': True, 'pageNum': '12'}

**************************************************

{

'pageCheck': True, 'pageNum': '13'}

**************************************************

{

'pageCheck': True, 'pageNum': '14'}

**************************************************

8.295663595199585

参考:

智能推荐

海康威视网络摄像头开发流程(五)------- 直播页面测试_ezuikit 测试的url-程序员宅基地

文章浏览阅读3.8k次。1、将下载好的萤石js插件,添加到SoringBoot项目中。位置可参考下图所示。(容易出错的地方,在将js插件在html页面引入时,发生路径错误的问题)所以如果对页面中引入js的路径不清楚,可参考下图所示存放路径。2、将ezuikit.js引入到demo-live.html中。(可直接将如下代码复制到你创建的html页面中)<!DOCTYPE html><html lan..._ezuikit 测试的url

如何确定组态王与多动能RTU的通信方式_组态王ua-程序员宅基地

文章浏览阅读322次。第二步,在弹出的对话框选择,设备驱动—>PLC—>莫迪康—>ModbusRTU—>COM,根据配置软件选择的协议选期期,这里以此为例,然后点击“下一步”。第四步,把使用虚拟串口打勾(GPRS设备),根据需要选择要生成虚拟口,这里以选择KVCOM1为例,然后点击“下一步”设备ID即Modbus地址(1-255) 使用DTU时,为下485接口上的设备地址。第六步,Modbus的从机地址,与配置软件相同,这里以1为例,点击“下一步“第五步,Modbus的从机地址,与配置软件相同,这里以1为例,点击“下一步“_组态王ua

npm超详细安装(包括配置环境变量)!!!npm安装教程(node.js安装教程)_npm安装配置-程序员宅基地

文章浏览阅读9.4k次,点赞22次,收藏19次。安装npm相当于安装node.js,Node.js已自带npm,安装Node.js时会一起安装,npm的作用就是对Node.js依赖的包进行管理,也可以理解为用来安装/卸载Node.js需要装的东西_npm安装配置

火车头采集器AI伪原创【php源码】-程序员宅基地

文章浏览阅读748次,点赞21次,收藏26次。大家好,小编来为大家解答以下问题,python基础训练100题,python入门100例题,现在让我们一起来看看吧!宝子们还在新手村练级的时候,不单要吸入基础知识,夯实自己的理论基础,还要去实际操作练练手啊!由于文章篇幅限制,不可能将100道题全部呈现在此除了这些,下面还有我整理好的基础入门学习资料,视频和讲解文案都很齐全,用来入门绝对靠谱,需要的自提。保证100%免费这不,贴心的我爆肝给大家整理了这份今天给大家分享100道Python练习题。大家一定要给我三连啊~

Linux Ubuntu 安装 Sublime Text (无法使用 wget 命令,使用安装包下载)_ubuntu 安装sumlime text打不开-程序员宅基地

文章浏览阅读1k次。 为了在 Linux ( Ubuntu) 上安装sublime,一般大家都会选择常见的教程或是 sublime 官网教程,然而在国内这种方法可能失效。为此,需要用安装包安装。以下就是使用官网安装包安装的教程。打开 sublime 官网后,点击右上角 download, 或是直接访问点击打开链接,即可看到各个平台上的安装包。选择 Linux 64 位版并下载。下载后,打开终端,进入安装..._ubuntu 安装sumlime text打不开

CrossOver for Mac 2024无需安装 Windows 即可以在 Mac 上运行游戏 Mac运行exe程序和游戏 CrossOver虚拟机 crossover运行免安装游戏包-程序员宅基地

文章浏览阅读563次,点赞13次,收藏6次。CrossOver24是一款类虚拟机软件,专为macOS和Linux用户设计。它的核心技术是Wine,这是一种在Linux和macOS等非Windows操作系统上运行Windows应用程序的开源软件。通过CrossOver24,用户可以在不购买Windows授权或使用传统虚拟机的情况下,直接在Mac或Linux系统上运行Windows软件和游戏。该软件还提供了丰富的功能,如自动配置、无缝集成和实时传输等,以实现高效的跨平台操作体验。

随便推点

一个用聊天的方式让ChatGPT写的线程安全的环形List_为什么gpt一写list就卡-程序员宅基地

文章浏览阅读1.7k次。一个用聊天的方式让ChatGPT帮我写的线程安全的环形List_为什么gpt一写list就卡

Tomcat自带的设置编码Filter-程序员宅基地

文章浏览阅读336次。我们在前面的文章里曾写过Web应用中乱码产生的原因和处理方式,旧文回顾:深度揭秘乱码问题背后的原因及解决方式其中我们提到可以通过Filter的方式来设置请求和响应的encoding,来解..._filterconfig selectencoding

javascript中encodeURI和decodeURI方法使用介绍_js encodeur decodeurl-程序员宅基地

文章浏览阅读651次。转自:http://www.jb51.net/article/36480.htmencodeURI和decodeURI是成对来使用的,因为浏览器的地址栏有中文字符的话,可以会出现不可预期的错误,所以可以encodeURI把非英文字符转化为英文编码,decodeURI可以用来把字符还原回来_js encodeur decodeurl

Android开发——打包apk遇到The destination folder does not exist or is not writeable-程序员宅基地

文章浏览阅读1.9w次,点赞6次,收藏3次。前言在日常的Android开发当中,我们肯定要打包apk。但是今天我打包的时候遇到一个很奇怪的问题Android The destination folder does not exist or is not writeable,大意是目标文件夹不存在或不可写。出现问题的原因以及解决办法上面有说报错的中文大意是:目标文件夹不存在或不可写。其实问题就在我们的打包界面当中图中标红的Desti..._the destination folder does not exist or is not writeable

Eclipse配置高大上环境-程序员宅基地

文章浏览阅读94次。一、配置代码编辑区的样式 <1>打开Eclipse,Help —> Install NewSoftware,界面如下: <2>点击add...,按下图所示操作: name:随意填写,Location:http://eclipse-color-th..._ecplise高大上设置

Linux安装MySQL-5.6.24-1.linux_glibc2.5.x86_64.rpm-bundle.tar_linux mysql 安装 mysql-5.6.24-1.linux_glibc2.5.x86_6-程序员宅基地

文章浏览阅读2.8k次。一,下载mysql:http://dev.mysql.com/downloads/mysql/; 打开页面之后,在Select Platform:下选择linux Generic,如果没有出现Linux的选项,请换一个浏览器试试。我用的谷歌版本不可以,换一个别的浏览器就行了,如果还是不行,需要换一个翻墙的浏览器。 二,下载完后解压缩并放到安装文件夹下: 1、MySQL-client-5.6.2_linux mysql 安装 mysql-5.6.24-1.linux_glibc2.5.x86_64.rpm-bundle