Hadoop基础学习---3、HDFS概述、HDFS的Shell操作、HDFS的API操作_hadoop setrep-程序员宅基地

1、HDFS概述

1.1 HDFS产出背景及定义

1、HDFS产生背景

随着数据量越来越大,在一个操作系统存不住所有的数据,那么就分配到更多的操作系统管理的磁盘中,但是不方便管理和维护,迫切需要一种系统来管理多台机器上的文件,这就是分布式文件管理系统。HDFS只是分布式文件管理系统中的一种。

2、HDFS定义

HDFS(Hadoop Distributed File System),是一个文件系统,用于存储文件,通过目录树来定位文件;其次,它是分布式的,由很多服务器联合起来实现其功能,集群中的服务器有各自的角色。

HDFS的使用场景:适合一次写入,多次读出的场景。一个文件经过创建、写入和关闭之后就不需要改变。

1.2 HDFS 优缺点

1、HDFS优点

(1)高容错

数据自动保存多个副本。它通过增加副本的形式提高容错性。

某一个副本丢失以后,它可以自动恢复。

(2)适合处理大数据

数据规模:能够处理数据规模达到GB、TB、甚至PB级别的数据;

文件规模:能够处理百万规模以上的文件数量,数量相当之大。

(3)可构建在廉价机器上,通过多副本机制,提高可靠性。

2、HDFS缺点

(1)不适合低延时数据范围,比如毫秒级的存储数据,是做不到的。

(2)无法高效的对大量小文件进行存储。

存储大量小文件的话,它会占用NameNode大量的内存来存储文件目录和块信息。这样是不可取的,因为NameNode的内存总是有限的;

小文件存储的寻址时间会超过读取时间,它违反了HDFS的设计目标。

(3)不支持并发写入、文件随机修改

一个文件只能有一个写,不允许多个线程同时写。

仅支持数据append(追加),不支持文件的随机修改。

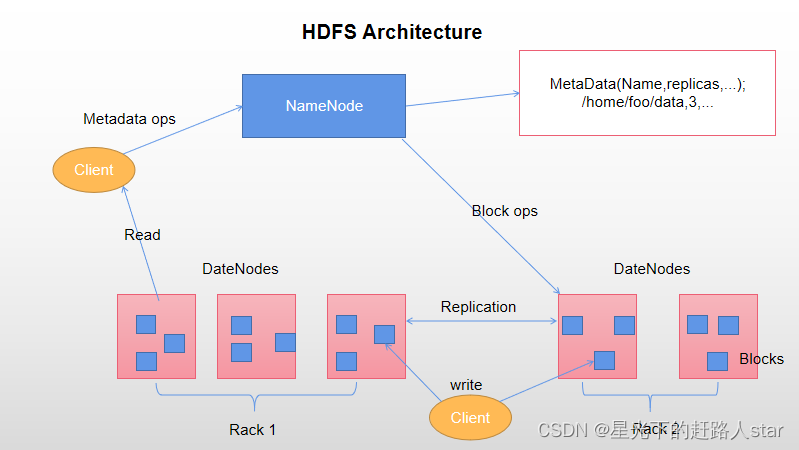

1.3 HDFS组成架构

1、NameNode(nn):就是Master,它是一个主管、管理者。

(1)管理HDFS的名称空间

(2)配置副本策略

(3)管理数据块(Block)映射信息

(4)处理客户端读写请求。

2、DateNode:就是workes(slave)。NameNode下达命令,DataNode执行实际的操作。

(1)存储实际的数据块

(2)执行数据块的读/写操作

3、Client:客户端

(1)文件切分。文件上传HDFS的时候,Client将文件切分成一个一个的Block,然后进行上传;

(2)与NameNode交互,获取文件的位置信息;

(3)与DataNode交互,读取或者写入数据。

(4)Client提供一些命令来管理HDFS,比如NameNode格式化

(5)Client可以通过一些命令来访问HDFS,比如对HDFS增删改查操作。

4、Secondary NameNode:并非NameNode的热备。当NameNode挂掉的时候,它并不是能马上替换NameNode并提供服务。

(1)辅助NameNode,分担其工作量,比如定期合并Fsimage和Edits,并推送给NameNode。

(2)在紧急情况下,可辅助恢复NameNode。

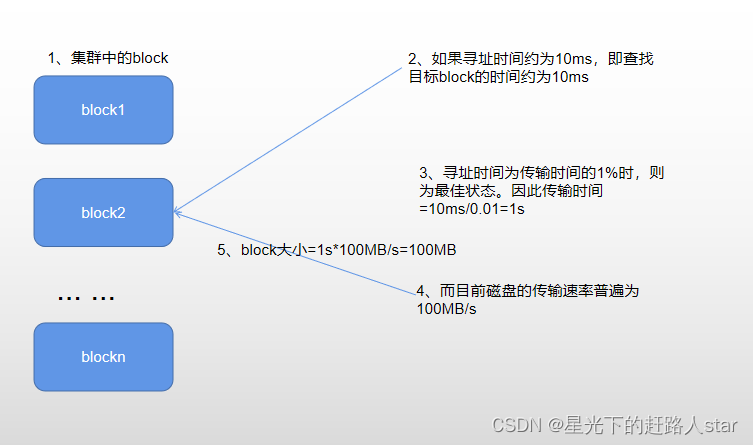

1.4 HDFS文件块大小

HDFS中的文件在物理上是分块存储(Block),块的大小可以通过配置参数(dfs blocksize)来规定,默认大小在hadoop2.x和3.x版本中是128M,1.x是64M。

为什么块的大小不能设置太小也不能太大?

(1)HDFS的块设置太小,会增加寻址时间,程序一直在找块的开始位置;

(2)如果块设置的太大,从磁盘传输速率的时间会明显大于定位这个块开始位置所需的时间。导致程序在处理这块数据时,会非常慢。

总结:HDFS块的大小设置主要取决于磁盘传输速率。

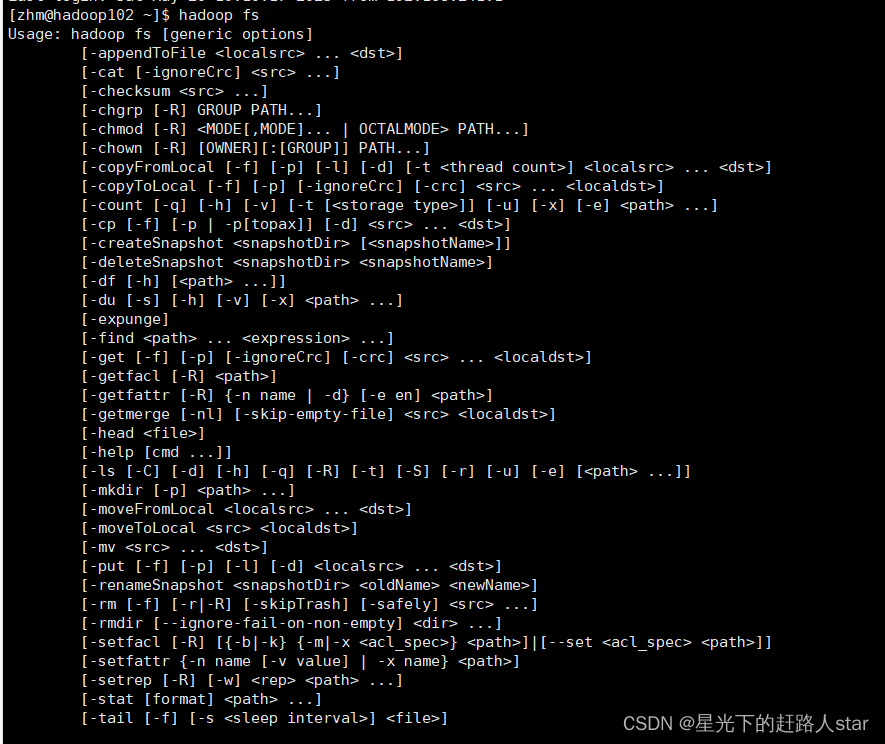

2、HDFS的Shell操作

2.1 基本语法

hadoop fs 具体命令 OR hdfs dfs 具体命令

两个是完全相同的。

2.2 命令大全

2.3 常用命令实操

2.3.1 准备工作

(1)启动hadoop集群

[zhm@hadoop102 hadoop-3.1.3]$ sbin/start-dfs.sh

[zhm@hadoop103 hadoop-3.1.3]$ sbin/start-yarn.sh

(2)- help:输出这个命令参数

hadoop fs -help rm

(3)创建/zhm文件夹

hadoop fs -mkdir /zhm

2.3.2 上传

1、-moveFromLocal:从本地剪切粘贴到HDFS

hadoop fs -moveFromLocal 文件路径 目的路径

2、-copyFromLocal:从本地文件系统中拷贝文件到HDFS路径去

hadoop fs -copyFromLocal 文件路径 目的路径

3、-put:等同于copyFromLocal,生产环境更习惯用put

hadoop fs -put 文件路径 目的路径

4、-appendToFile:追加一个文件到已经存在的文件末尾

hadoop fs -appendToFile 文件路径 目的路径

2.3.3 下载

1、-copyToLocal:从 HDFS 拷贝到本地

hadoop fs -copyToLocal 文件路径 目的路径

2、-get:等同于 copyToLocal,生产环境更习惯用 get

hadoop fs -get 文件路径 目的路径

2.4 HDFS直接操作

1、-ls:显示目录信息

hadoop fs -ls 目录

2、-cat:显示文件内容

hadoop fs -cat 文件路径

3、-chgrp、-chmod、-chown:Linux 文件系统中的用法一样,修改文件所属权限

4、-mkdir:创建路径

hadoop fs -mkdir 目录路径

5、-cp:从 HDFS 的一个路径拷贝到 HDFS 的另一个路径

hadoop fs -cp 文件路径 目的目录

6、-mv:在 HDFS 目录中移动文件

hadoop fs -mv 文件路径 目的路径

7、-tail:显示一个文件的末尾 1kb 的数据

hadoop fs -tail 文件路径

8、-rm:删除文件或文件夹

hadoop fs -rm 文件路径

9、-rm -r:递归删除目录及目录里面内容

hadoop fs -rm -r 文件路径

10、-du 统计文件夹的大小信息

hadoop fs -du 文件路径

11、-setrep:设置 HDFS 中文件的副本数量

hadoop fs -setrep 数量 文件路径

这里设置的副本数只是记录在NameNode的元数据中,是否真的有会有这么多的副本,还得看DataNode的数量、因为目前只有三台DataNode,最多也就是3个副本,只有节点数增加到相应的数量时,副本数才会达到相应的数量。

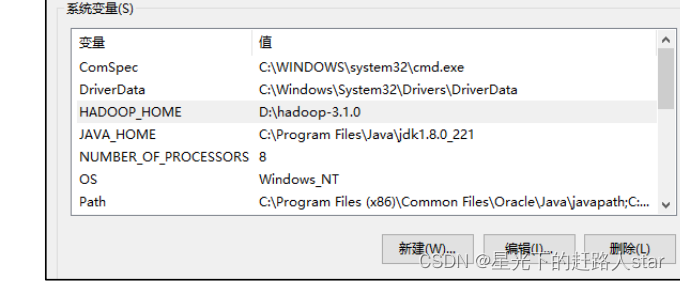

3、HDFS的API操作

3.1 客户端环境准备

1、找到资料包路径下的Windows依赖文件夹,拷贝hadoo-3.1.0到非中文路径(比如 d:\)。

链接:https://pan.baidu.com/s/1wamz5h6P0kyNxD_J6vwi8w

提取码:zhm6

–来自百度网盘超级会员V1的分享

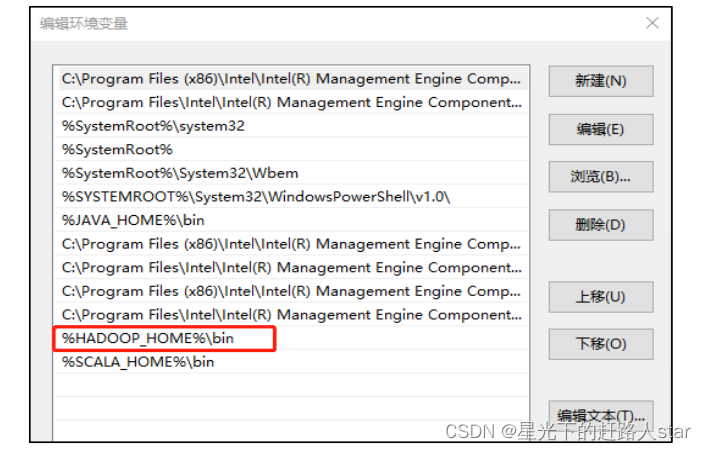

2、配置HADOOP_HOME环境变量

3、配置Path环境变量

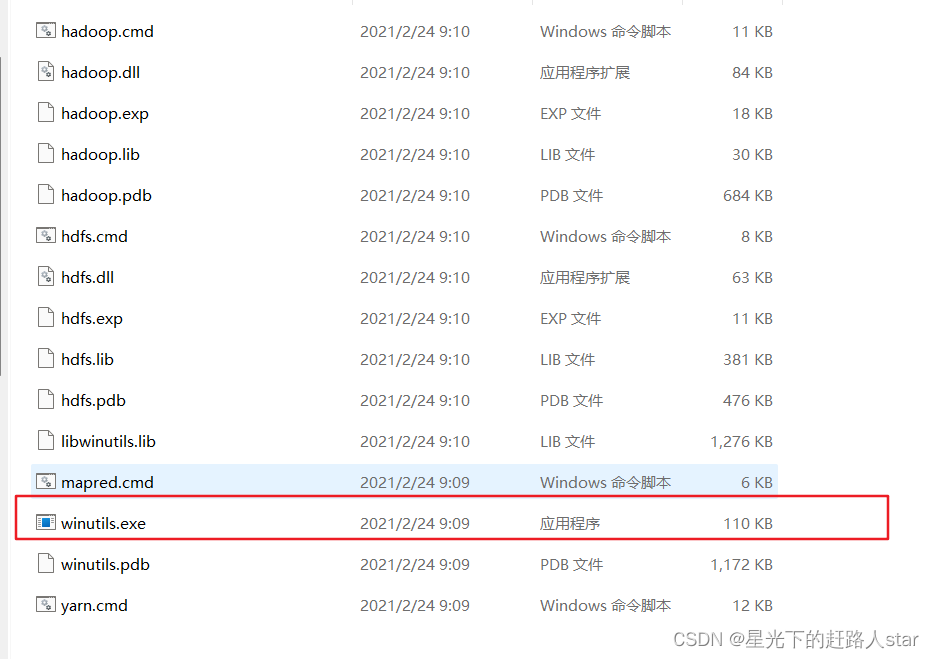

验证Hadoop环境变量是否正常,双击winutils.exe。

4、在IDEA中创建一个Maven工程,并导入相应的依赖坐标+日志添加

<dependencies>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-client</artifactId>

<version>3.1.3</version>

</dependency>

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>4.12</version>

</dependency>

<dependency>

<groupId>org.slf4j</groupId>

<artifactId>slf4j-log4j12</artifactId>

<version>1.7.30</version>

</dependency>

</dependencies>

在项目的 src/main/resources 目录下,新建一个文件,命名为“log4j.properties”,在文件中填入

log4j.rootLogger=INFO, stdout

log4j.appender.stdout=org.apache.log4j.ConsoleAppender

log4j.appender.stdout.layout=org.apache.log4j.PatternLayout

log4j.appender.stdout.layout.ConversionPattern=%d %p [%c] - %m%n

log4j.appender.logfile=org.apache.log4j.FileAppender

log4j.appender.logfile.File=target/spring.log

log4j.appender.logfile.layout=org.apache.log4j.PatternLayout

log4j.appender.logfile.layout.ConversionPattern=%d %p [%c] - %m%n

5、创建包名:com.zhm.hdfs

6、在hdfs包下创建HdfsClient类

public class HdfsClient {

@Test

public void testMkdirs() throws IOException, URISyntaxException,

InterruptedException {

// 1 获取文件系统

Configuration configuration = new Configuration();

// FileSystem fs = FileSystem.get(new

URI("hdfs://hadoop102:8020"), configuration);

FileSystem fs = FileSystem.get(new URI("hdfs://hadoop102:8020"),

configuration,"zhm");

// 2 创建目录

fs.mkdirs(new Path("/xiyou/huaguoshan/"));

// 3 关闭资源

fs.close();

}

}

7、执行程序

3.2 HDFS的API案例实操

3.2.1 HDFS文件上传(测试参数优先级)

1、编写源码

@Test

public void testCopyFromLocalFile() throws IOException,

InterruptedException, URISyntaxException {

// 1 获取文件系统

Configuration configuration = new Configuration();

configuration.set("dfs.replication", "2");

FileSystem fs = FileSystem.get(new URI("hdfs://hadoop102:8020"),

configuration, "zhm");

// 2 上传文件

fs.copyFromLocalFile(new Path("d:/sunwukong.txt"), new

Path("/xiyou/huaguoshan"));

// 3 关闭资源

fs.close();

}

2、将hdfs-site.xml拷贝到项目的resource资源目录下

<?xml version="1.0" encoding="UTF-8"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

</configuration>

3、参数优先级

参数优先级排序:(1)客户端代码中设置的值>(2)Classpath下的用户自定义配置文件>(3)然后就是服务器的自定义配置(xxx-site.xml)>(4)服务器的默认配置(xxx-default.xml)

3.2.2 HDFS文件下载

@Test

public void testCopyToLocalFile() throws IOException,

InterruptedException, URISyntaxException{

// 1 获取文件系统

Configuration configuration = new Configuration();

FileSystem fs = FileSystem.get(new URI("hdfs://hadoop102:8020"),

configuration, "zhm");

// 2 执行下载操作

// boolean delSrc 指是否将原文件删除

// Path src 指要下载的文件路径

// Path dst 指将文件下载到的路径

// boolean useRawLocalFileSystem 是否开启文件校验

fs.copyToLocalFile(false, new

Path("/xiyou/huaguoshan/sunwukong.txt"), new Path("d:/sunwukong2.txt"),

true);

// 3 关闭资源

fs.close();

}

3.2.3 HDFS文件更名和移动

@Test

public void testRename() throws IOException, InterruptedException,

URISyntaxException{

// 1 获取文件系统

Configuration configuration = new Configuration();

FileSystem fs = FileSystem.get(new URI("hdfs://hadoop102:8020"),

configuration, "zhm");

// 2 修改文件名称

fs.rename(new Path("/xiyou/huaguoshan/sunwukong.txt"), new

Path("/xiyou/huaguoshan/meihouwang.txt"));

// 3 关闭资源

fs.close();

}

3.2.4 HDFS删除文件和目录

@Test

public void testDelete() throws IOException, InterruptedException,

URISyntaxException{

// 1 获取文件系统

Configuration configuration = new Configuration();

FileSystem fs = FileSystem.get(new URI("hdfs://hadoop102:8020"),

configuration, "zhm");

// 2 执行删除

fs.delete(new Path("/xiyou"), true);

// 3 关闭资源

fs.close();

}

3.2.5 HDFS文件详情查看

查看文件名称、权限、长度、块信息

@Test

public void testListFiles() throws IOException, InterruptedException,

URISyntaxException {

// 1 获取文件系统

Configuration configuration = new Configuration();

FileSystem fs = FileSystem.get(new URI("hdfs://hadoop102:8020"),

configuration, "zhm");

// 2 获取文件详情

RemoteIterator<LocatedFileStatus> listFiles = fs.listFiles(new Path("/"),

true);

while (listFiles.hasNext()) {

LocatedFileStatus fileStatus = listFiles.next();

System.out.println("========" + fileStatus.getPath() + "=========");

System.out.println(fileStatus.getPermission());

System.out.println(fileStatus.getOwner());

System.out.println(fileStatus.getGroup());

System.out.println(fileStatus.getLen());

System.out.println(fileStatus.getModificationTime());

System.out.println(fileStatus.getReplication());

System.out.println(fileStatus.getBlockSize());

System.out.println(fileStatus.getPath().getName());

// 获取块信息

BlockLocation[] blockLocations = fileStatus.getBlockLocations();

System.out.println(Arrays.toString(blockLocations));

}

// 3 关闭资源

fs.close();

}

3.2.5 HDFS文件详情查看

@Test

public void testListStatus() throws IOException, InterruptedException,

URISyntaxException{

// 1 获取文件配置信息

Configuration configuration = new Configuration();

FileSystem fs = FileSystem.get(new URI("hdfs://hadoop102:8020"),

configuration, "zhm");

// 2 判断是文件还是文件夹

FileStatus[] listStatus = fs.listStatus(new Path("/"));

for (FileStatus fileStatus : listStatus) {

// 如果是文件

if (fileStatus.isFile()) {

System.out.println("f:"+fileStatus.getPath().getName());

}else {

System.out.println("d:"+fileStatus.getPath().getName());

}

}

// 3 关闭资源

fs.close();

}

智能推荐

计算机毕业设计吊打导师Hadoop+Hive+PySpark旅游景点推荐 旅游推荐系统 景区游客满意度预测与优化 Apriori算法 景区客流量预测 旅游大数据 景点规划 知识图谱 机器学习 深度学习-程序员宅基地

文章浏览阅读1.2k次,点赞41次,收藏16次。计算机毕业设计吊打导师Hadoop+Hive+PySpark旅游景点推荐 旅游推荐系统 景区游客满意度预测与优化 Apriori算法 景区客流量预测 旅游大数据 景点规划 知识图谱 机器学习 深度学习 人工智能

Google APK Crash 解决方案-程序员宅基地

文章浏览阅读1.2k次。阅读五分钟,每日十点,和您一起终身学习,这里是程序员Android本篇文章主要介绍开发中我们没有源码的GMS Crash崩溃后的解决方案,通过阅读本篇文章,您将收获以下内容:一、gms.ui Service not registered CrashGMS(GoogleMobile Service)包是出口国外手机中Google限制必须要预制的,如果不预置无法过Google CTS认证,会导致手...

Java多线程(超详细!)-程序员宅基地

文章浏览阅读10w+次,点赞880次,收藏3.9k次。1、什么是进程?什么是线程?进程是:一个应用程序(1个进程是一个软件)。线程是:一个进程中的执行场景/执行单元。注意:一个进程可以启动多个线程。eg.对于java程序来说,当在DOS命令窗口中输入:java HelloWorld 回车之后。会先启动JVM,而JVM就是一个进程。JVM再启动一个主线程调用main方法。同时再启动一个垃圾回收线程负责看护,回收垃圾。最起码,现在的java程序中至少有两个线程并发,一个是垃圾回收线程,一个是执行main方法的主线程。3、进程和线程是什么关系?_java多线程

vue中使用webVideoCtrl播放海康插件_海康威视divplugin 浮层问题-程序员宅基地

文章浏览阅读2.2k次。<template> <div class="video-player"> <div id="divPlugin" class="divPlugin" ref="divPlugin" v-if="plugin"> </div> <!-- <div class="down" v-else> <a href="http://jbfsys.oss-cn-bei.._海康威视divplugin 浮层问题

Android 9 (P)之init进程启动源码分析指南之三_exec_start update_verifier_nonencrypted-程序员宅基地

文章浏览阅读3.6k次,点赞7次,收藏10次。 Android P之init进程启动源码分析指南之三前言 在前面的篇章Android P之init进程启动源码分析指南之一和Android P之init进程启动源码分析指南之二讲解了init进程经过前面两个阶段以后,已经建立了相关的文件系统,属性系统,SELinux安全策略系统。但是我们知道init进程做的远远不止这些,还要启动一些Android的native service系统服务及其其他相关的操作,但是如果都是像属性系统和SELinux系统那样一行行代码去做,显得有点杂乱繁琐,而且_exec_start update_verifier_nonencrypted

关联规则--Apriori算法_apriori关联规则算法-程序员宅基地

文章浏览阅读2w次,点赞17次,收藏199次。啤酒与尿布的故事:在美国,一些年轻的父亲下班后经常要到超市去买婴儿尿布,超市也因此发现了一个规律,在购买婴儿尿布的年轻的父亲们中,有30%~40%的人同时要买一些啤酒。超市随后调整了货架的摆放,将尿布和啤酒放在一起,因此,明显增加了销售额。_apriori关联规则算法

随便推点

【华为机试真题 Python实现】华为机试题整理(已更新211篇)_华为机试垂直矩阵-程序员宅基地

文章浏览阅读2.6w次,点赞26次,收藏269次。拆分输出字符串求n阶方阵里所有数的和合法的三角形个数整型数组求整数对最小和机器人走迷宫【2022 Q1 Q2 |200分】数格子两个超大整型数相加字符串格式化输出【2022 Q1 Q2 |100分】树形目录操作【2022 Q1 Q2 |200分】整型数组按个位值排序奥运会奖牌榜的排名【2022 Q1 | 100分】无重复字符的最长子串最长回文子串两个字符串的最长公共子串括号生成字符串处理一个正整数到 Excel 编号之间的转换字符串压缩搜索矩阵免单统计数组的转换藏宝_华为机试垂直矩阵

HZNUOJ1527_输入两个正整数x,y(其中x<y) 求x到y之间能被3整除的个数。 输入 输入两行,即x和y-程序员宅基地

文章浏览阅读853次。HZNUOJ1527(巨水题题解)Description输入两个正整数X,Y,求出[X,Y]内被除3余1并且被除5余3的整数的和Input输入两个正整数X,YOutput求所有满足条件的数的和对 x到 y进行遍历 并判断同时累计符合要求的个数。#include<stdio.h>int main(){ int x, y,sum=0; scanf("%d %d", &x, &y); for (int i = x; i <= y; i++) { i_输入两个正整数x,y(其中x

前后端分离架构:Web实现前后端分离,前后端解耦-程序员宅基地

文章浏览阅读1.8k次。分享一篇讲得特别详细的blog前后端分离架构:Web实现前后端分离,前后端解耦

工作流Activiti的学习总结(一)安装条件以及各步骤的作用以及不同环境需要lib包_part 1: configure activiti here is an example of c-程序员宅基地

文章浏览阅读770次。工作流activiti的下载地址: http://activiti.org/download.html工作流activiti的必须的软件JDK5+,Ant1.81+,Eclipse3.6.2JDK:查看版本 java –versionANT:查看版本 ant –version运行默认的Demo安装: 1.需要配置JAVA_HOME,ANT_HOME环境变量。_part 1: configure activiti here is an example of configuring activiti with s

华为海思2024春招数字芯片岗机试题(共9套)_华为海思机考题库-程序员宅基地

文章浏览阅读1.1k次,点赞13次,收藏3次。华为海思2024春招数字芯片岗机试题(共9套)_华为海思机考题库

C#调用SAP接口保存数据到SAP_irfctable not support linq-程序员宅基地

文章浏览阅读505次。DataTable dt ; RfcDestination dest = SapManager.getRfcDestination(); RfcRepository rfcrep = dest.Repository; IRfcFunction myfun = null; myfun = rfcrep.CreateFunction("HJJDB_T..._irfctable not support linq